《Introduction to Probability》第8章 变换

第8章 变换

transformations

本章的主题是随机变量和随机向量的变换。在对随机变量 \(X\) 或随机向量 \(\mathbf{X}\) 应用一个函数后,目标是找到变换后的随机变量的分布或变换后的随机向量的联合分布。

随机变量的变换在统计学中无处不在。以下是一些例子,用以预演本章将要探讨的各种变换。

单位换算:在一维情况下,我们已经看到标准化和位置-刻度变换如何成为研究整个分布族的有用工具。位置-刻度变换是线性的,它将随机变量 \(X\) 转换为随机变量 \(Y = aX + b\),其中 \(a\) 和 \(b\) 是常数(且 \(a > 0\))。

在许多情况下,我们也可能对非线性变换感兴趣,例如,将“美元-日元”汇率转换为“日元-美元”汇率;或者将信息(如“珍妮特昨天清醒的时间包括 8 小时工作、4 小时拜访朋友和 4 小时上网”)转换格式(如“珍妮特昨天清醒了 16 小时;其中 \(1/2\) 的时间在工作,\(1/4\) 的时间在拜访朋友,\(1/4\) 的时间在上网”)。本章的首个结论——变量代换公式,展示了当随机向量发生变换时,其分布会如何变化。

作为总结的各项之和与平均值:在统计学中,通常用 \(n\) 个观测值的总和或样本平均值来对其进行总结。将 \(X_1, \dots, X_n\) 转化为总和 \(T = X_1 + \dots + X_n\) 或样本均值 \(\bar{X}_n = T/n\),是一个从 \(\mathbb{R}^n\) 到 \(\mathbb{R}\) 的变换。

独立随机变量之和的术语称为卷积(convolution)。我们已经接触过利用“故事”和矩生成函数(MGF)作为处理卷积的两种技术。在本章中,基于全概率公式的卷积求和与积分,将为我们提供另一种获取随机变量之和分布的方法。

个人注:概率中的卷积和图像识别中的卷积神经网络的区别见文件《卷积(convolution).md》

极端值:在许多背景下,我们可能对最极端观测值的分布感兴趣。为了防灾准备,政府机构可能会关注百年一遇的最极端洪水或地震;在金融领域,注重风险管理的投资组合经理会想了解投资组合回报率最差的 1% 或 5%。在这些应用中,我们关注的是一组观测值的最大值或最小值。将观测值进行排序,把 \(X_1, \dots, X_n\) 转化为次序统计量(order statistics)\(\min(X_1, \dots, X_n), \dots, \max(X_1, \dots, X_n)\) 的过程,是一个从 \(\mathbb{R}^n\) 到 \(\mathbb{R}^n\) 且不可逆的变换。次序统计量将在本章最后一节中讨论。

此外,理解变换对我们而言尤为重要,因为这是我们学习命名分布所采取的方法。从几个基础分布出发,我们将其他分布定义为这些基础构件的变换,以此来理解命名分布之间是如何相互关联的。我们将秉承这一精神,在本章介绍两个新的分布:Beta 分布和 Gamma 分布,它们分别是均匀分布和指数分布的推广。

我们在处理变换方面已经拥有了不少工具,让我们简要回顾一下。首先,如果我们仅仅是寻求 \(g(X)\) 的期望,LOTUS(无意识统计学家法则)为我们指明了方向:它告诉我们,利用 \(X\) 的 PMF 或 PDF 就足以计算 \(E(g(X))\)。正如我们在前一章所学到的,LOTUS 同样适用于多元随机变量的函数。

如果我们不仅需要期望,还需要 \(g(X)\) 的完整分布,我们的方法则取决于 \(X\) 是离散的还是连续的。

在离散情况下,我们通过将事件 \(g(X) = y\) 转化为涉及 \(X\) 的等价事件来获得 \(g(X)\) 的 PMF。为此,我们寻找所有满足 \(g(x) = y\) 的 \(x\) 值;只要 \(X\) 等于这些 \(x\) 中的任何一个,事件 \(g(X) = y\) 就会发生。由此得到公式: \[ P(g(X) = y) = \sum_{x:g(x)=y} P(X = x) \]

对于一一对应(单射)的函数 \(g\),情况尤为简单,因为满足 \(g(x) = y\) 的 \(x\) 值只有一个,即 \(g^{-1}(y)\)。那么我们可以使用: \[ P(g(X) = y) = P(X = g^{-1}(y)) \]

在 \(X\) 和 \(g(X)\) 的 PMF 之间进行转换,正如 3.7 节中所讨论的那样。例如,在几何分布(Geometric)和首成分布(First Success)之间进行转换极其容易。

在连续情况下,一种通用的方法是从 \(g(X)\) 的 CDF 入手,将事件 \(g(X) \leq y\) 转化为涉及 \(X\) 的等价事件。对于一般的 \(g\),我们可能需要仔细思考如何用 \(X\) 来表示 \(g(X) \leq y\),并且没有一个可以直接套用的简单公式。但当 \(g\) 是连续且严格递增时,这种转化非常简单:\(g(X) \leq y\) 等价于 \(X \leq g^{-1}(y)\),因此: \[ F_{g(X)}(y) = P(g(X) \leq y) = P(X \leq g^{-1}(y)) = F_X(g^{-1}(y)) \]

然后我们可以对 \(y\) 求导,从而得到 \(g(X)\) 的 PDF。这给出了一维版本的变量代换公式,该公式可以推广到多维空间中的可逆变换。

8.1 变量代换

Change of variables

定理 8.1.1(一维变量代换)。设 \(X\) 为一个具有 PDF \(f_X\) 的连续随机变量,令 \(Y = g(X)\),其中 \(g\) 是可微且严格递增(或严格递减)的函数。那么 \(Y\) 的 PDF 为: \[ f_Y(y) = f_X(x) \left| \frac{dx}{dy} \right| \]

其中 \(x = g^{-1}(y)\)。\(Y\) 的支撑集(support)是所有满足 \(x\) 在 \(X\) 的支撑集内的 \(g(x)\) 的集合。

证明。设 \(g\) 严格递增。\(Y\) 的 CDF 为: \[ F_Y(y) = P(Y \leq y) = P(g(X) \leq y) = P(X \leq g^{-1}(y)) = F_X(g^{-1}(y)) = F_X(x) \]

根据链式法则,\(Y\) 的 PDF 为: \[ f_Y(y) = f_X(x) \frac{dx}{dy} \]

对于 \(g\) 严格递减的情况,证明过程与之类似。在这种情况下,PDF 最终结果为 \(-f_X(x) \frac{dx}{dy}\),由于 \(g\) 严格递减时 \(\frac{dx}{dy} < 0\),因此该结果是非负的。如定理所述,使用 \(\left| \frac{dx}{dy} \right|\) 可以同时涵盖这两种情况。

在应用变量代换公式时,我们可以选择直接计算 \(\frac{dx}{dy}\),或者先计算 \(\frac{dy}{dx}\) 再取倒数。根据链式法则,两者的结果一致,因此哪种简便就选哪种。

8.1.2。在求 \(Y\) 的分布时,请务必:

- 如果你希望应用变量代换定理,请仔细检查其假设条件(如果不适用,一个好的策略是从 \(Y\) 的 CDF 入手)。

- 将 \(Y\) 的 PDF 最终结果表示为 \(y\) 的函数。

- 指明 \(Y\) 的支撑集。

当变量代换公式(在 \(g\) 严格递增的情况下)写成如下形式时非常容易记忆: \[ f_Y(y)dy = f_X(x)dx \]

这种形式具有一种美学上的对称性。如果我们从单位的角度来考虑,这个公式也是合理的。例如,设 \(X\) 是以英寸(inches)为单位的测量值,\(Y = 2.54X\) 是转换成厘米(cm)的测量值。那么 \(f_X(x)\) 的单位是英寸\(^{-1}\),而 \(f_Y(y)\) 的单位是厘米\(^{-1}\),因此说“\(f_Y(y) = f_X(x)\)”之类的话是荒谬的。但是 \(dx\) 的测量单位是英寸,\(dy\) 的测量单位是厘米,所以 \(f_Y(y)dy\) 和 \(f_X(x)dx\) 是无单位的量,将它们等同起来是有意义的。更确切地说,\(f_X(x)dx\) 和 \(f_Y(y)dy\) 具有概率解释(回想第 5 章,\(f_X(x)dx\) 本质上是 \(X\) 落入以 \(x\) 为中心、长度为 \(dx\) 的极小区间内的概率),这使得我们可以更直观地理解变量代换公式的含义。

接下来的两个例子推导了两个随机变量的 PDF,它们被定义为标准正态随机变量的变换。在第一个例子中,变量代换公式适用;而在第二个例子中则不适用。

例 8.1.3(对数正态分布 PDF)。设 \(X \sim N(0,1)\),\(Y = e^X\)。在第 6 章中,我们将 \(Y\) 的分布命名为对数正态分布(Log-Normal),并利用正态分布的 MGF 找到了它的所有矩。现在我们可以使用变量代换公式来求 \(Y\) 的 PDF,因为 \(g(x) = e^x\) 是严格递增的。令 \(y = e^x\),则 \(x = \log y\) 且 \(dy/dx = e^x\)。那么: \[ f_Y(y) = f_X(x) \left| \frac{dx}{dy} \right| = \varphi(x) \frac{1}{e^x} = \varphi(\log y) \frac{1}{y}, \quad y > 0 \]

注意,在应用变量代换公式后,我们将等号右侧的所有内容都写成关于 \(y\) 的形式,并指明分布的支撑集。为了确定支撑集,我们只需观察到当 \(x\) 的范围从 \(-\infty\) 到 \(\infty\) 时,\(e^x\) 的范围是从 \(0\) 到 \(\infty\)。

我们也可以通过 CDF 的定义得到相同的结果,即将事件 \(Y \le y\) 转化为涉及 \(X\) 的等价事件。对于 \(y > 0\): \[ F_Y(y) = P(Y \le y) = P(e^X \le y) = P(X \le \log y) = \Phi(\log y) \]

因此 PDF 再次为: \[ f_Y(y) = \frac{d}{dy} \Phi(\log y) = \varphi(\log y) \frac{1}{y}, \quad y > 0 \]

例 8.1.4(卡方分布 PDF)。设 \(X \sim N(0,1)\),\(Y = X^2\)。\(Y\) 的分布是卡方分布(Chi-Square)的一个例子,该分布将在第 10 章正式介绍。为了求 \(Y\) 的 PDF,我们不能再应用变量代换公式,因为 \(g(x) = x^2\) 不是一一对应的;相反,我们从 CDF 入手。

通过绘制 \(y = x^2\) 的图形,我们可以看到事件 \(X^2 \le y\) 等价于事件 \(-\sqrt{y} \le X \le \sqrt{y}\)。那么: \[ F_Y(y) = P(X^2 \le y) = P(-\sqrt{y} \le X \le \sqrt{y}) = \Phi(\sqrt{y}) - \Phi(-\sqrt{y}) = 2\Phi(\sqrt{y}) - 1 \]

因此: \[ f_Y(y) = 2\varphi(\sqrt{y}) \cdot \frac{1}{2}y^{-1/2} = \varphi(\sqrt{y})y^{-1/2}, \quad y > 0 \]

接下来的例子揭示了一个明显的非正态分布意外出现的情况。

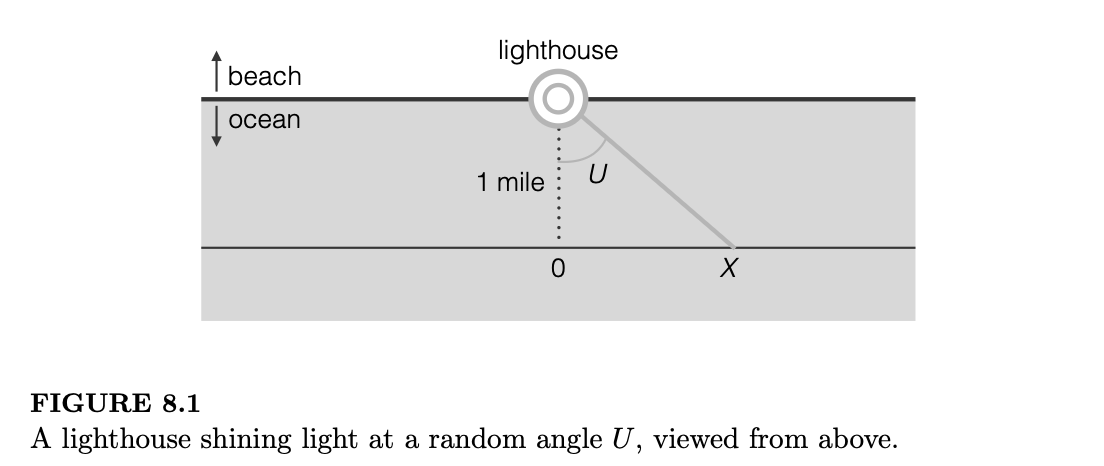

例 8.1.5(灯塔问题)。岸边的一座灯塔以随机角度 \(U\)(以弧度测量)向海洋照射光线,其中: \[ U \sim \text{Unif}\left(-\frac{\pi}{2}, \frac{\pi}{2}\right) \]

考虑一条与海岸平行且距离海岸 1 英里的直线,如图 8.1 所示。角度为 0 意味着光线与海岸垂直,而角度为 \(\pi/2\) 则意味着光线沿海岸线向图中的右侧照射。

令 \(X\) 为光线在直线上照射到的点,直线的原点定义为直线上距离灯塔最近的点。求 \(X\) 的分布。

解:观察图 8.1 中的直角三角形,\(U\) 的对边长度除以 \(U\) 的邻边长度为 \(X/1 = X\),因此: \[ X = \tan(U) \]

(图中展示了 \(U > 0\) 且对应 \(X > 0\) 的情况,但当 \(U \le 0\) 时,同样的比例关系依然成立。)设 \(x\) 为 \(X\) 的一个可能取值,\(u\) 为 \(U\) 对应的可能取值,则: \[ x = \tan(u) \quad \text{且} \quad u = \arctan(x) \]

由于 \(\tan\) 在 \((-\pi/2, \pi/2)\) 上是可微且严格递增的函数,变量代换公式适用: \[ f_X(x) = f_U(u) \left| \frac{du}{dx} \right| = \frac{1}{\pi} \cdot \frac{1}{1+x^2} \]

这表明 \(X\) 服从柯西分布(Cauchy)。特别地,这意味着 \(E|X|\) 是无穷大(因为柯西分布的期望值不存在),所以平均而言,\(X\) 距离直线原点有无限远!

考虑到均匀分布的普适性,\(X\) 服从柯西分布这一事实也是合理的。如例 7.1.25 所示,柯西分布的 CDF 为: \[ F(x) = \frac{1}{\pi} \arctan(x) + 0.5 \]

其反函数为 \(F^{-1}(v) = \tan(\pi(v-0.5))\),因此对于 \(V \sim \text{Unif}(0,1)\),我们有: \[ F^{-1}(V) = \tan(\pi(V-0.5)) \sim \text{Cauchy} \]

这与我们之前的结果一致,因为 \(\pi(V-0.5) \sim \text{Unif}(-\pi/2, \pi/2)\)。

我们还可以使用变量代换公式来推导位置-刻度变换的 PDF。

例 8.1.6(位置-刻度变换的 PDF)。设 \(X\) 的 PDF 为 \(f_X\),令 \(Y = a + bX\),且 \(b \neq 0\)。令 \(y = a + bx\) 以反映 \(Y\) 与 \(X\) 之间的关系。那么 \(\frac{dy}{dx} = b\),因此 \(Y\) 的 PDF 为: \[ f_Y(y) = f_X(x) \left| \frac{dx}{dy} \right| = f_X\left(\frac{y-a}{b}\right) \frac{1}{|b|} \]

变量代换公式可以推广到 \(n\) 维,它告诉我们如何利用随机向量 \(\mathbf{X}\) 的联合 PDF 来获取变换后的随机向量 \(\mathbf{Y} = g(\mathbf{X})\) 的联合 PDF。该公式与一维版本类似,但涉及到一个称为 雅可比矩阵(Jacobian matrix)的多元导数推广;有关雅可比矩阵的更多信息,请参见数学附录的 A.6 和 A.7 节。

定理 8.1.1(变量代换)。设 \(\mathbf{X} = (X_1, \dots, X_n)\) 为具有联合 PDF \(f_{\mathbf{X}}\) 的连续随机向量。设 \(g : A_0 \to B_0\) 为一个可逆函数,其中 \(A_0\) 和 \(B_0\) 是 \(\mathbb{R}^n\) 的开子集,\(A_0\) 包含 \(\mathbf{X}\) 的支撑集,\(B_0\) 是 \(g\) 的值域。

令 \(\mathbf{Y} = g(\mathbf{X})\),并对应地令 \(\mathbf{y} = g(\mathbf{x})\)。由于 \(g\) 是可逆的,我们也有 \(\mathbf{X} = g^{-1}(\mathbf{Y})\) 且 \(\mathbf{x} = g^{-1}(\mathbf{y})\)。

假设所有的偏导数 \(\frac{\partial x_i}{\partial y_j}\) 均存在且连续,因此我们可以构造雅可比矩阵(Jacobian matrix): \[ \frac{\partial \mathbf{x}}{\partial \mathbf{y}} = \begin{pmatrix} \frac{\partial x_1}{\partial y_1} & \frac{\partial x_1}{\partial y_2} & \cdots & \frac{\partial x_1}{\partial y_n} \\ \frac{\partial x_2}{\partial y_1} & \frac{\partial x_2}{\partial y_2} & \cdots & \frac{\partial x_2}{\partial y_n} \\ \vdots & \vdots & \ddots & \vdots \\ \frac{\partial x_n}{\partial y_1} & \frac{\partial x_n}{\partial y_2} & \cdots & \frac{\partial x_n}{\partial y_n} \end{pmatrix} \]

并假设该雅可比矩阵的行列式始终不为 0。那么 \(\mathbf{Y}\) 的联合 PDF 为: \[ f_{\mathbf{Y}}(\mathbf{y}) = f_{\mathbf{X}}(g^{-1}(\mathbf{y})) \cdot | \left| \frac{\partial \mathbf{x}}{\partial \mathbf{y}} \right||, \quad \mathbf{y} \in B_0 \]

否则为 0。(雅可比矩阵符号两端的内层竖线表示取行列式,外层竖线表示取绝对值。)

也就是说,为了将 \(f_{\mathbf{X}}(\mathbf{x})\) 转换为 \(f_{\mathbf{Y}}(\mathbf{y})\),我们将 \(f_{\mathbf{X}}(\mathbf{x})\) 中的 \(\mathbf{x}\) 用 \(\mathbf{y}\) 来表示,然后乘以雅可比行列式 \(\frac{\partial \mathbf{x}}{\partial \mathbf{y}}\) 的绝对值。

与一维情况类似: \[ \frac{\partial \mathbf{x}}{\partial \mathbf{y}} = \left( \frac{\partial \mathbf{y}}{\partial \mathbf{x}} \right)^{-1} \]

因此我们可以计算两个雅可比矩阵中较容易的一个,最后将 \(\mathbf{Y}\) 的联合 PDF 表示为 \(\mathbf{y}\) 的函数。

我们在此不证明变量代换公式,其核心思想是应用多元微积分中的变量代换公式,以及这样一个事实:如果 \(A\) 是 \(A_0\) 中的一个区域,而 \(B = \{g(\mathbf{x}) : \mathbf{x} \in A\}\) 是 \(B_0\) 中对应的区域,那么 \(\mathbf{X} \in A\) 等价于 \(\mathbf{Y} \in B\)——它们是同一个事件。因此 \(P(\mathbf{X} \in A) = P(\mathbf{Y} \in B)\),这表明: \[ \int_A f_{\mathbf{X}}(\mathbf{x})d\mathbf{x} = \int_B f_{\mathbf{Y}}(\mathbf{y})d\mathbf{y} \]

随后可以将多元微积分的变量代换公式(在数学附录中有所回顾)应用于左侧积分,并进行代换 \(\mathbf{x} = g^{-1}(\mathbf{y})\)。

8.1.8。离散随机变量变换与连续随机变量变换之间的一个关键概念区别在于:离散随机变量不需要雅可比行列式,而连续随机变量则需要。例如,设 \(X\) 为一个正随机变量,且 \(Y = X^3\)。如果 \(X\) 是离散的,那么: \[ P(Y = y) = P(X = y^{1/3}) \]

即可在 PMF 之间进行转换。但如果 \(X\) 是连续的,我们需要雅可比行列式(在一维中即为导数)来在 PDF 之间进行转换: \[ f_Y(y) = f_X(x) \left| \frac{dx}{dy} \right| = f_X(y^{1/3}) \frac{1}{3y^{2/3}} \]

练习 23 讲述了一个关于某人在需要使用雅可比行列式时却未能使用的警示故事。

接下来的两个例子应用了二维变量代换公式。

例 8.1.9(Box-Muller 变换)。设 \(U \sim \text{Unif}(0, 2\pi)\),且 \(T \sim \text{Expo}(1)\) 独立于 \(U\)。定义: \[ X = \sqrt{2T} \cos U \quad \text{且} \quad Y = \sqrt{2T} \sin U \]

求 \((X, Y)\) 的联合 PDF。它们是否独立?它们的边缘分布分别是什么?

解:

\(U\) 和 \(T\) 的联合 PDF 为: \[ f_{U,T}(u,t) = \frac{1}{2\pi} e^{-t} \]

其中 \(u \in (0, 2\pi)\),\(t > 0\)。将 \((X, Y)\) 视为平面上的一个点, \[ X^2 + Y^2 = 2T(\cos^2 U + \sin^2 U) = 2T \]

是到原点距离的平方,而 \(U\) 是角度;也就是说,\((\sqrt{2T}, U)\) 是以极坐标形式表达的 \((X, Y)\)。

由于我们可以从 \((X, Y)\) 还原出 \((U, T)\),该变换是可逆的。雅可比矩阵: \[ \frac{\partial(x,y)}{\partial(u,t)} = \begin{pmatrix} -\sqrt{2t}\sin u & \frac{1}{\sqrt{2t}}\cos u \\ \sqrt{2t}\cos u & \frac{1}{\sqrt{2t}}\sin u \end{pmatrix} \]

存在且条目连续,其行列式的绝对值为: \[ |-\sin^2 u - \cos^2 u| = 1 \]

(该值始终不为 0)。对应于从 \((U, T)\) 到 \((X, Y)\) 的变换,令 \(x = \sqrt{2t}\cos u\),\(y = \sqrt{2t}\sin u\),我们有: \[ f_{X,Y}(x,y) = f_{U,T}(u,t) \cdot \left| \frac{\partial(u,t)}{\partial(x,y)} \right| \] \[ = \frac{1}{2\pi} e^{-t} \cdot 1 \] \[ = \frac{1}{2\pi} e^{-\frac{1}{2}(x^2 + y^2)} \] \[ = \frac{1}{\sqrt{2\pi}} e^{-x^2/2} \cdot \frac{1}{\sqrt{2\pi}} e^{-y^2/2} \]

对于所有实数 \(x\) 和 \(y\) 均成立。

联合 PDF \(f_{X,Y}\) 可以分解为关于 \(x\) 的函数与关于 \(y\) 的函数的乘积,因此 \(X\) 和 \(Y\) 相互独立。此外,我们认出该联合 PDF 是两个标准正态分布 PDF 的乘积,所以 \(X\) 和 \(Y\) 是独立同分布(i.i.d.)的 \(N(0,1)\) 随机变量!这一结果被称为生成正态随机变量的 Box-Muller 方法。

例 8.1.10(二元正态分布联合 PDF)。在第 7 章中,我们看到了二元正态分布的一些性质并找到了其联合 MGF。现在让我们来推导它的联合 PDF。

设 \((Z, W)\) 为边缘分布为 \(N(0, 1)\) 且相关系数为 \(\text{Corr}(Z, W) = \rho\) 的二元正态分布。(如果我们想要得到边缘分布不是标准正态分布时的联合 PDF,可以分别对两个分量进行标准化并使用下面的结论。)假设 \(-1 < \rho < 1\),因为否则分布会发生退化(即 \(Z\) 与 \(W\) 完全相关)。

如例 7.5.10 所示,我们可以将 \((Z, W)\) 构造为: \[ Z = X \] \[ W = \rho X + \tau Y \]

其中 \(\tau = \sqrt{1 - \rho^2}\),且 \(X, Y \overset{i.i.d.}{\sim} N(0, 1)\)。我们还需要逆变换。由 \(Z = X\) 解得 \(X = Z\)。将其代入 \(W = \rho X + \tau Y\) 并解出 \(Y\),我们有: \[ X = Z \] \[ Y = -\frac{\rho}{\tau} Z + \frac{1}{\tau} W \]

其雅可比矩阵为: \[ \frac{\partial(x, y)}{\partial(z, w)} = \begin{pmatrix} 1 & 0 \\ -\frac{\rho}{\tau} & \frac{1}{\tau} \end{pmatrix} \]

该行列式的绝对值为 \(1/\tau\)。因此,根据变量代换公式: \[ f_{Z,W}(z, w) = f_{X,Y}(x, y) \cdot \left| \frac{\partial(x, y)}{\partial(z, w)} \right| \] \[ = \frac{1}{2\pi} \exp \left( -\frac{1}{2}(x^2 + y^2) \right) \cdot \frac{1}{\tau} \] \[ = \frac{1}{2\pi\tau} \exp \left( -\frac{1}{2}\left(z^2 + \left(-\frac{\rho}{\tau} z + \frac{1}{\tau} w\right)^2\right) \right) \] \[ = \frac{1}{2\pi\tau} \exp \left( -\frac{1}{2\tau^2}(z^2 + w^2 - 2\rho zw) \right), \quad \text{对所有实数 } z, w \text{ 均成立。} \]

在最后一步中,我们展开了各项并利用了 \(\rho^2 + \tau^2 = 1\) 这一事实。

8.2 卷积

Convolutions

卷积是指独立随机变量之和。正如我们之前提到的,我们经常将独立的随机变量相加,因为总和是对实验的一种有用总结(在 \(n\) 次伯努利试验中,我们可能只关心成功的总次数),而且总和可以导出平均值,平均值同样非常有用(在 \(n\) 次伯努利试验中,指成功的比例)。

本节的主要任务是确定 \(T = X + Y\) 的分布,其中 \(X\) 和 \(Y\) 是分布已知的独立随机变量。在之前的章节中,我们已经看到“故事”和矩生成函数(MGF)如何帮助我们完成这一任务。例如,我们利用故事证明了具有相同成功概率的独立二项分布之和仍为二项分布,且独立同分布的几何分布之和为负二项分布。我们利用 MGF 证明了独立正态分布之和仍为正态分布。

获取 \(T\) 分布的第三种方法是使用卷积和或卷积积分。下述定理给出了相关公式。正如我们将看到的,卷积和不过是全概率公式(LOTP),即对 \(X\) 或 \(Y\) 的取值进行条件化;卷积积分与之类似。

定理 8.2.1(卷积和与卷积积分 Convolution sums and integrals)。设 \(X\) 和 \(Y\) 为独立随机变量,\(T = X + Y\) 为它们的和。如果 \(X\) 和 \(Y\) 是离散的,则 \(T\) 的 PMF 为: \[ P(T = t) = \sum_{x} P(Y = t - x)P(X = x) = \sum_{y} P(X = t - y)P(Y = y) \]

如果 \(X\) 和 \(Y\) 是连续的,则 \(T\) 的 PDF 为: \[ f_T(t) = \int_{-\infty}^{\infty} f_Y(t - x)f_X(x)dx = \int_{-\infty}^{\infty} f_X(t - y)f_Y(y)dy \]

证明。对于离散情况,我们使用全概率公式,对 \(X\) 进行条件化: \[ P(T = t) = \sum_{x} P(X + Y = t \mid X = x)P(X = x) \] \[ = \sum_{x} P(Y = t - x \mid X = x)P(X = x) \] \[ = \sum_{x} P(Y = t - x)P(X = x) \]

若改为对 \(Y\) 进行条件化,则可得到 \(T\) 的 PMF 的第二个公式。

8.2.2。在最后一步中,我们利用 \(X\) 和 \(Y\) 独立的假设,将 \(P(Y = t - x \mid X = x)\) 转化为 \(P(Y = t - x)\)。只有当 \(Y\) 在给定 \(X = x\) 时的条件分布与 \(Y\) 的边缘分布相同时(即 \(X\) 和 \(Y\) 独立),我们才有理由去掉条件 \(X = x\)。一个常见的错误是认为在将 \(x\) 代入 \(X\) 后,我们就“已经利用了” \(X = x\) 这一信息,而事实上我们需要独立性假设才能去掉该条件。否则,我们就是在没有正当理由的情况下破坏了信息。

在连续情况下,由于 PDF 在某一点的值并不是概率,我们先求 CDF,然后通过求导得到 PDF。根据全概率公式(LOTP): \[ F_T(t) = P(X + Y \leq t) = \int_{-\infty}^{\infty} P(X + Y \leq t \mid X = x) f_X(x) dx \] \[ = \int_{-\infty}^{\infty} P(Y \leq t - x) f_X(x) dx = \int_{-\infty}^{\infty} F_Y(t - x) f_X(x) dx \]

同样地,我们需要独立性来去掉条件 \(X = x\)。为了得到 PDF,我们对 \(t\) 求导,并交换积分和求导的顺序。这得到: \[ f_T(t) = \int_{-\infty}^{\infty} f_Y(t - x) f_X(x) dx \]

若改为对 \(Y\) 进行条件化,则可得到 \(f_T\) 的第二个公式。

另一种推导方法是使用二维变量代换公式。唯一的障碍是变量代换公式要求从 \(\mathbb{R}^2\) 到 \(\mathbb{R}^2\) 的变换是可逆的,但 \((X, Y) \to X + Y\) 是从 \(\mathbb{R}^2\) 映射到 \(\mathbb{R}\),且不可逆。我们可以通过在变换中添加一个冗余分量来使其可逆。因此,我们考虑可逆变换 \((X, Y) \to (X + Y, X)\)(使用 \((X, Y) \to (X + Y, Y)\) 同样有效)。一旦我们得到了 \(X + Y\) 和 \(X\) 的联合 PDF,就可以对 \(X\) 进行积分以求得 \(X + Y\) 的边缘 PDF。

令 \(T = X + Y\),\(W = X\),且 \(t = x + y\),\(w = x\)。给 \(X\) 起个新名字“\(W\)”似乎有些多余,但这样做可以更容易区分变换前后的变量:我们正在进行变换 \((X, Y) \to (T, W)\)。那么: \[ \frac{\partial(t, w)}{\partial(x, y)} = \begin{pmatrix} 1 & 1 \\ 1 & 0 \end{pmatrix} \]

其行列式的绝对值等于 1,因此 \(\left| \frac{\partial(x, y)}{\partial(t, w)} \right|\) 也是 1。于是,\(T\) 和 \(W\) 的联合 PDF 为: \[ f_{T,W}(t, w) = f_{X,Y}(x, y) = f_X(x) f_Y(y) = f_X(w) f_Y(t - w) \]

而 \(T\) 的边缘 PDF 为: \[ f_T(t) = \int_{-\infty}^{\infty} f_{T,W}(t, w) dw = \int_{-\infty}^{\infty} f_X(x) f_Y(t - x) dx \]

这与我们上面的结果一致。

8.2.3。通过类比,从离散形式: \[ P(T=t) = \sum_{x} P(Y=t-x)P(X=x) \]

推导到连续形式: \[ f_T(t) = \int_{-\infty}^{\infty} f_Y(t-x)f_X(x)dx \]

记忆卷积积分公式并不难。但仍需谨慎。例如,练习 23 表明,对于两个独立连续随机变量之积的 PDF,类比得到的公式是错误的:在这种情况下需要雅可比行列式(对于卷积,雅可比行列式的绝对值为 1,因此在卷积积分公式中并不显著)。

由于卷积和只是全概率公式的应用,我们在之前的章节中已经在未提及“卷积”一词的情况下使用过它们;例如,参见定理 3.8.9(独立二项分布之和)的首个也是最冗长的证明,以及定理 4.8.1(独立泊松分布之和)的证明。

在接下来的例子中,我们将使用卷积积分求指数分布之和以及均匀分布之和的分布。

例 8.2.4(指数分布卷积)。设 \(X, Y \overset{i.i.d.}{\sim} \text{Expo}(\lambda)\)。求 \(T = X + Y\) 的分布。

解:

对于 \(t > 0\),卷积公式给出: \[ f_T(t) = \int_{-\infty}^{\infty} f_Y(t-x)f_X(x)dx = \int_{0}^{t} \lambda e^{-\lambda(t-x)} \lambda e^{-\lambda x}dx \]

这里我们将积分限制在 \(0\) 到 \(t\) 之间,因为我们需要 \(t-x > 0\) 且 \(x > 0\) 才能使积分号内的 PDF 不为零。化简得: \[ f_T(t) = \lambda^2 \int_{0}^{t} e^{-\lambda t}dx = \lambda^2 t e^{-\lambda t}, \quad t > 0 \]

这被称为 \(\text{Gamma}(2, \lambda)\) 分布。我们将在 8.4 节详细介绍 Gamma 分布。

例 8.2.5(均匀分布卷积)。设 \(X, Y \overset{i.i.d.}{\sim} \text{Unif}(0, 1)\)。求 \(T = X + Y\) 的分布。

解:

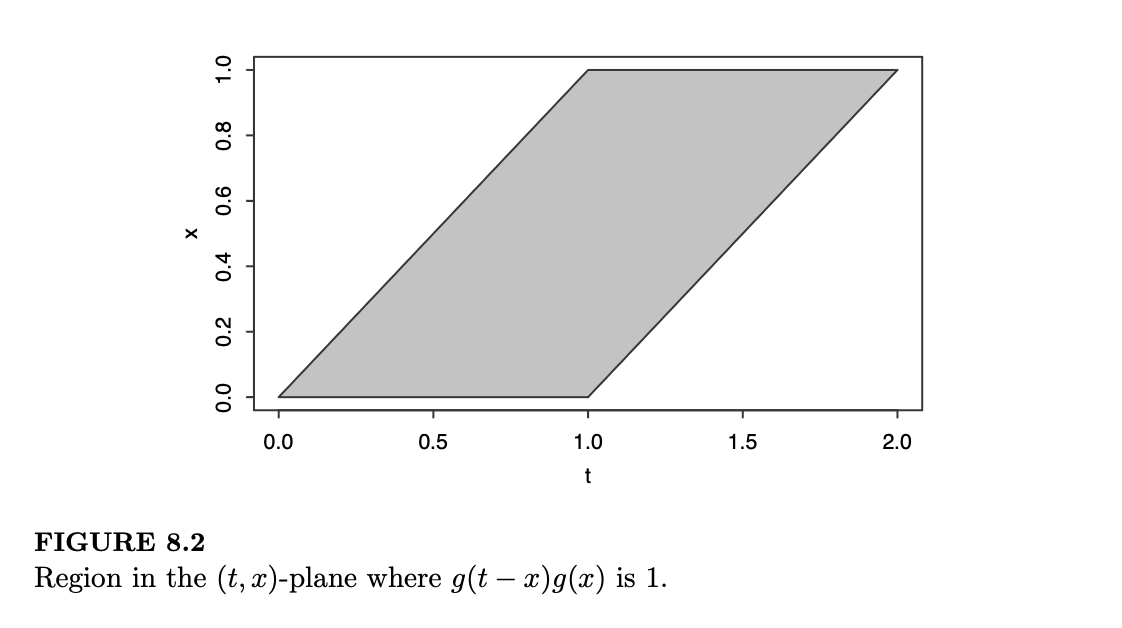

\(X\)(以及 \(Y\))的 PDF 为: \[ g(x) = \begin{cases} 1, & x \in (0,1) \\ 0, & \text{其他} \end{cases} \]

卷积公式给出: \[ f_T(t) = \int_{-\infty}^{\infty} f_Y(t-x)f_X(x)dx = \int_{-\infty}^{\infty} g(t-x)g(x)dx \]

当且仅当 \(0 < t-x < 1\) 且 \(0 < x < 1\) 时,被积函数为 1;这是一个平行四边形形状的约束。等价地,约束条件为 \(\max(0, t-1) < x < \min(t, 1)\)。

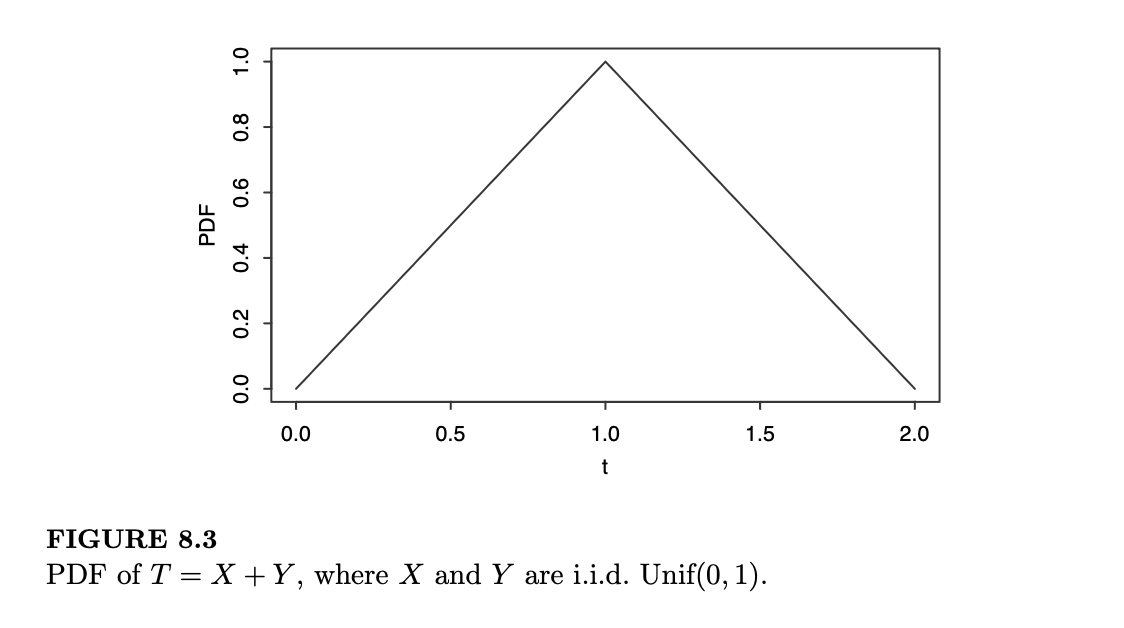

从图 8.2 可以看出,对于 \(0 < t \le 1\),\(x\) 被限制在 \((0, t)\) 内;对于 \(1 < t < 2\),\(x\) 被限制在 \((t-1, 1)\) 内。因此,\(T\) 的 PDF 是一个分段线性函数: \[ f_T(t) = \begin{cases} \int_{0}^{t} dx = t, & 0 < t \le 1 \\ \int_{t-1}^{1} dx = 2-t, & 1 < t < 2 \end{cases} \]

图 8.3 绘制了 \(T\) 的 PDF。它的形状像一个顶点在 0、1 和 2 的三角形,因此被称为 \(\text{Triangle}(0, 1, 2)\)(三角形)分布。

从启发式角度来看,\(T\) 在中间取值的可能性比在两端取值的可能性大是有道理的:如果 \(X\) 和 \(Y\) 都是中等大小,或者 \(X\) 大而 \(Y\) 小,或者 \(Y\) 大而 \(X\) 小,都可以得到接近 1 的值。相比之下,只有当 \(X\) 和 \(Y\) 都很大时,才可能得到接近 2 的值。回想例 3.2.5,两次掷骰子之和的 PMF 也是三角形的。单次掷骰子在整数 1 到 6 上服从离散均匀分布,因此在那个问题中我们观察的是两个离散均匀分布的卷积。我们在这里得到的 PDF 在形状上与之相似是合理的。

8.3 Beta 分布

Beta

在本节和下一节中,我们将介绍两个连续分布:Beta 分布和 Gamma 分布。它们与我们已经研究过的几个命名分布相关,并且通过一个共同的“故事”彼此关联。这虽然是变换主题的一个插曲,但我们最终需要使用变量代换法将 Beta 和 Gamma 分布联系起来。

Beta 分布是定义在区间 \((0,1)\) 上的连续分布。它是 \(\text{Unif}(0,1)\) 分布的推广,允许 PDF 在 \((0,1)\) 上不是常数。

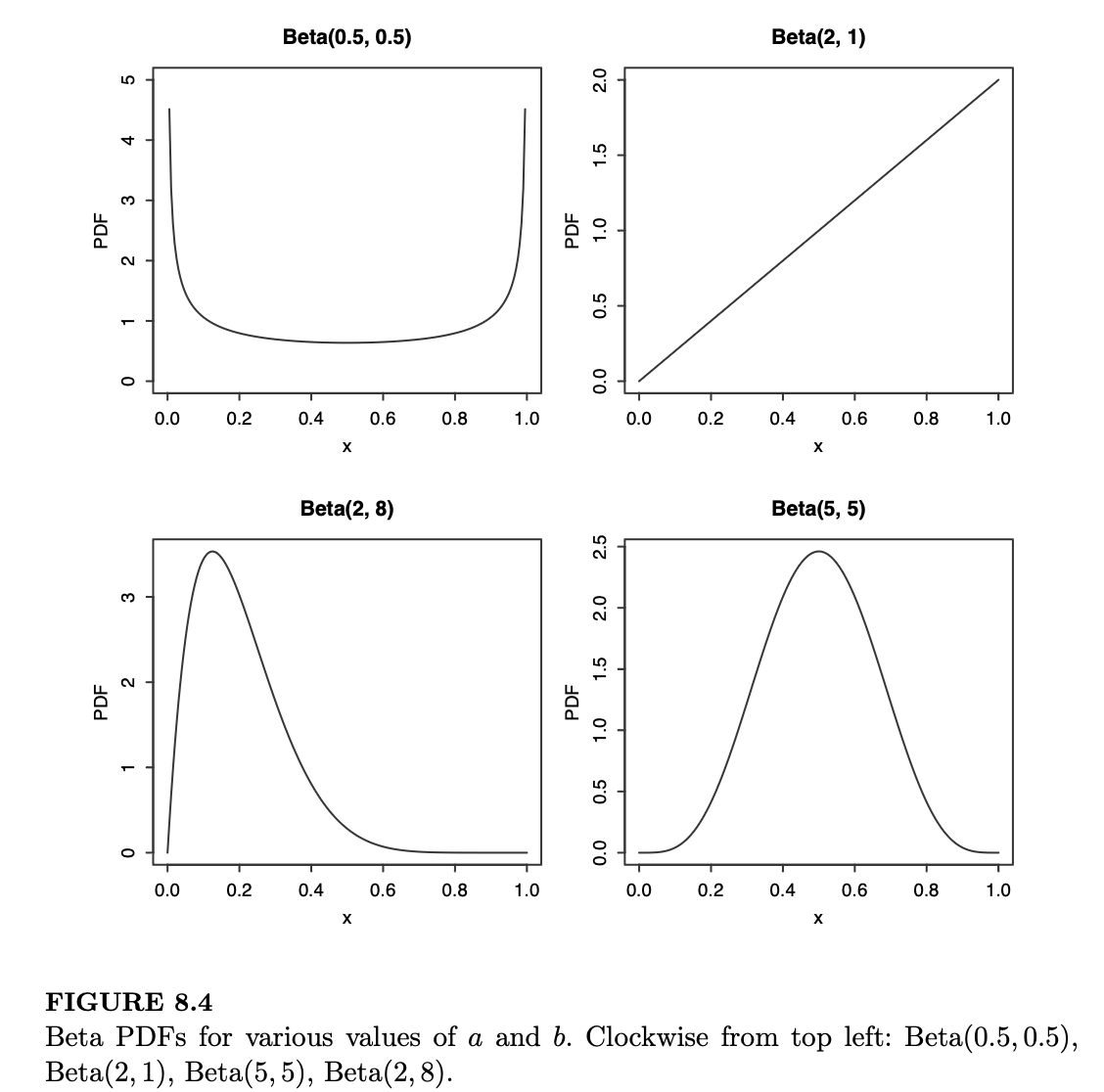

定义 8.3.1(Beta 分布)。如果一个随机变量 \(X\) 的 PDF 为: \[ f(x) = \frac{1}{\beta(a,b)}x^{a-1}(1-x)^{b-1}, \quad 0 < x < 1 \]

其中 \(a>0\) 且 \(b>0\),常数 \(\beta(a,b)\) 用于确保 PDF 的积分为 1,则称 \(X\) 服从参数为 \(a\) 和 \(b\) 的 Beta 分布。我们记作 \(X \sim \text{Beta}(a,b)\)。

若取 \(a = b = 1\),\(\text{Beta}(1,1)\) 的 PDF 在 \((0,1)\) 上为常数,因此 \(\text{Beta}(1,1)\) 与 \(\text{Unif}(0,1)\) 分布是相同的。通过改变 \(a\) 和 \(b\) 的值,我们可以得到各种形状的 PDF。图8.4 展示了四个例子。

.

.

以下是一些通用的规律:

- 如果 \(a<1\) 且 \(b<1\),PDF 呈 U 形且开口向上。如果 \(a>1\) 且 \(b>1\),PDF 开口向下。

- 如果 \(a=b\),PDF 关于 \(1/2\) 对称。如果 \(a>b\),PDF 更倾向于大于 \(1/2\) 的值;如果 \(a<b\),PDF 更倾向于小于 \(1/2\) 的值。

根据定义,常数 \(\beta(a,b)\) 满足: \[ \beta(a,b) = \int_{0}^{1} x^{a-1}(1-x)^{b-1}dx \]

这种形式的积分被称为 Beta 积分。我们需要一些微积分知识来推导 \(\beta(a,b)\) 的通式。但在 \(a\) 和 \(b\) 为正整数的特殊情况下,托马斯·贝叶斯(Thomas Bayes)想出了如何通过“故事证明”而非微积分来完成这个积分!

故事 8.3.2(贝叶斯的台球)。证明对于任何满足 \(0 \le k \le n\) 的整数 \(k\) 和 \(n\): \[ \int_{0}^{1} \binom{n}{k} x^k(1-x)^{n-k}dx = \frac{1}{n+1} \]

解:

通过讲述两个故事,我们将证明左式和右式都等于概率 \(P(X=k)\),其中 \(X\) 是我们将要构造的一个随机变量。

故事 1:准备 \(n+1\) 个球,其中 \(n\) 个白球,\(1\) 个灰球。随机地将每个球投掷到单位区间 \([0,1]\) 上,使得球的位置是独立同分布(i.i.d.)的 \(\text{Unif}(0,1)\)。设 \(X\) 是落在灰球左侧的白球数量;\(X\) 是一个离散随机变量,可能取值为 \(0, 1, \dots, n\)。

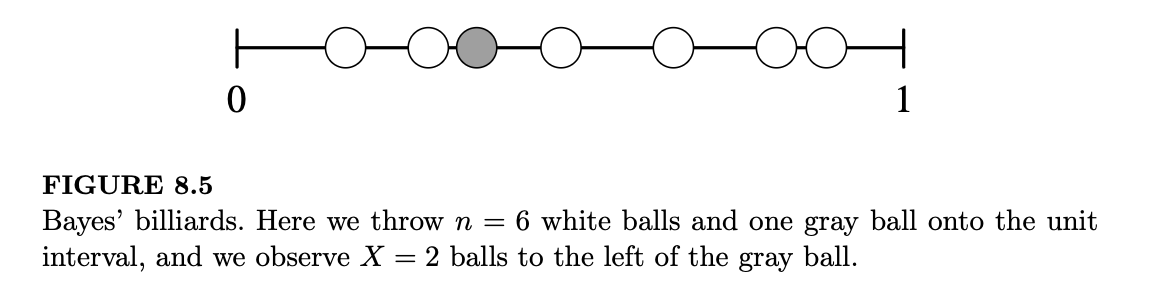

图8.5展示了我们实验的设置。

为了得到事件 \(X=k\) 的概率,我们使用全概率公式(LOTP),对灰球的位置进行条件化,记灰球位置为 \(B\)。已知 \(B=p\) 的条件下,落在 \(p\) 左侧的白球数量服从 \(\text{Bin}(n,p)\) 分布,因为我们可以将每个白球视为一次独立的伯努利试验,成功定义为落在 \(p\) 的左侧。设 \(f\) 为 \(B\) 的 PDF;由于 \(B \sim \text{Unif}(0,1)\),故 \(f(p)=1\)。因此: \[ P(X=k) = \int_{0}^{1} P(X=k|B=p)f(p)dp = \int_{0}^{1} \binom{n}{k} p^k(1-p)^{n-k}dp \]

个人注:直观理解

当你固定了灰球的位置 \(p\) 后,单位区间 \([0, 1]\) 就被分成了两部分:左边长度为 \(p\),右边长度为 \(1-p\)。

现在你扔下 \(n\) 个白球。对于每一个白球,它就像是一个“硬币”,有 \(p\) 的概率翻到“左边”(成功),有 \(1-p\) 的概率翻到“右边”(失败)。

你数一数翻到左边的次数,这个过程在数学定义上完全等同于二项分布的产生过程。

故事 2:开始时有 \(n+1\) 个球,全部为白色。随机地将每个球投掷到单位区间上;然后随机选择其中一个球并将其涂成灰色。同样地,设 \(X\) 为落在灰球左侧的白球数量。根据对称性,\(n+1\) 个球中的任何一个被涂成灰色的概率都是相等的,因此: \[ P(X=k) = \frac{1}{n+1}, \quad k=0,1,\dots,n \]

关键点在于:\(X\) 在这两个故事中具有相同的分布!先涂灰球再投掷,还是先投掷再涂灰球,这并不重要。因此,故事 1 和故事 2 中的 \(P(X=k)\) 是相同的,即: \[ \int_{0}^{1} \binom{n}{k} p^k(1-p)^{n-k}dp = \frac{1}{n+1} \]

对于 \(k=0,1,\dots,n\) 均成立。尽管被积函数中含有 \(k\),但积分的结果并不依赖于 \(k\)。令 \(a-1\) 代替 \(k\),\(b-1\) 代替 \(n-k\),这表明对于正整数值的 \(a\) 和 \(b\): \[ \beta(a, b) = \frac{1}{(a+b-1) \binom{a+b-2}{a-1}} = \frac{(a-1)!(b-1)!}{(a+b-1)!} \]

在本章稍后部分,我们将学习一般 \(a\) 和 \(b\) 下 \(\beta(a, b)\) 的定义。

Beta 分布是 \((0,1)\) 区间上一族灵活的分布,并且有许多故事。其中一个故事是:Beta 随机变量常被用来表示一个未知的概率。也就是说,我们可以使用 Beta 分布来对“未知的概率”赋予概率!

故事 8.3.3(Beta-二项共轭性)。我们有一枚硬币,投掷出正面的概率为 \(p\),但我们不知道 \(p\) 的具体值。我们的目标是在观察 \(n\) 次投掷结果后推断 \(p\) 的值。\(n\) 越大,我们对 \(p\) 的估计就越准确。

有几种方法可以实现这一点。一种主要的方法是贝叶斯推断(Bayesian inference),它将所有未知量视为随机变量。在贝叶斯方法中,我们会将未知的概率 \(p\) 视为一个随机变量并赋予其一个分布。这被称为先验分布(prior distribution),它反映了在观察硬币投掷之前,我们对 \(p\) 真实值的不确定性。在进行实验并收集数据后,使用贝叶斯法则更新先验分布;这将产生后验分布(posterior distribution),反映了我们对 \(p\) 的新信念。

让我们看看如果 \(p\) 的先验分布是 Beta 分布会发生什么。设 \(p \sim \text{Beta}(a,b)\)(其中 \(a\) 和 \(b\) 为已知常数),并设 \(X\) 为 \(n\) 次硬币投掷中正面的次数。在已知 \(p\) 真实值的条件下,投掷过程仅仅是成功概率为 \(p\) 的独立伯努利试验,因此: \[ X|p \sim \text{Bin}(n,p) \]

请注意,\(X\) 的边缘分布并非二项分布;在给定 \(p\) 的条件下,它是条件二项分布。\(X\) 的边缘分布被称为Beta-二项分布(Beta-Binomial distribution)。为了得到 \(p\) 的后验分布,我们使用贝叶斯法则(采用混合形式,因为 \(X\) 是离散的而 \(p\) 是连续的)。设 \(f(p)\) 为先验分布,\(f(p|X=k)\) 为观察到 \(k\) 次正面后的后验分布: \[ f(p|X=k) = \frac{P(X=k|p)f(p)}{P(X=k)} = \frac{\binom{n}{k} p^k(1-p)^{n-k} \cdot \frac{1}{\beta(a,b)}p^{a-1}(1-p)^{b-1}}{P(X=k)} \]

分母即 \(X\) 的边缘 PMF,由下式给出: \[ P(X=k) = \int_{0}^{1} P(X=k|p)f(p)dp = \int_{0}^{1} \binom{n}{k} p^k(1-p)^{n-k}f(p)dp \]

对于 \(a=b=1\)(这赋予 \(p\) 一个 \(\text{Unif}(0,1)\) 先验),我们在“贝叶斯台球”故事中证明了 \(P(X=k) = 1/(n+1)\),即 \(X\) 在 \(\{0,1,\dots,n\}\) 上服从离散均匀分布。对于任何正整数 \(a\) 和 \(b\),我们同样可以使用贝叶斯台球故事找到 \(P(X=k)\);有趣的是,\(X\) 此时服从负超几何分布(其故事和 PMF 见例 4.4.7)。

但是,对于一般的实数 \(a, b\),寻找 \(P(X=k)\) 似乎并不容易。与之相关的是,我们仍然没有求出一般情况下的 \(\beta(a,b)\)。我们被困住了吗?

实际上,计算比最初看起来要简单得多。条件 PDF \(f(p|X=k)\) 是关于 \(p\) 的函数,这意味着任何不依赖于 \(p\) 的项都只是常数。我们可以舍弃所有这些常数,找到与 PDF 成比例的表达式(然后归一化常数就是为了使 PDF 积分为 1 而需要的任何值)。这得到: \[ f(p|X=k) \propto p^{a+k-1}(1-p)^{b+n-k-1} \]

在不计乘法常数的情况下,这就是 \(\text{Beta}(a+k, b+n-k)\) 的 PDF。因此,\(p\) 的后验分布为: \[ p|X=k \sim \text{Beta}(a+k, b+n-k) \]

在观察到 \(X=k\) 后,\(p\) 的后验分布仍然是一个 Beta 分布!这是 Beta 分布与二项分布之间一种特殊的关系,称为共轭性(conjugacy):如果我们对 \(p\) 使用 Beta 先验分布,且数据在给定 \(p\) 的条件下是二项分布的,那么从先验到后验的过程中,我们不会脱离 Beta 分布族。我们称 Beta 分布是二项分布的共轭先验。

此外,注意更新 \(p\) 的分布的公式非常简单。我们只需将观察到的成功次数 \(k\) 加到 Beta 分布的第一个参数上,将观察到的失败次数 \(n-k\) 加到第二个参数上。因此,在此背景下,\(a\) 和 \(b\) 具有具体的解释(至少当 \(a\) 和 \(b\) 为正整数时):将 \(a-1\) 视为早期实验中先验的成功次数,将 \(b-1\) 视为早期实验中先验的失败次数(这些早期实验可以是真实的也可以是虚构的)。加上当前实验中的 \(k\) 次成功和 \(n-k\) 次失败,我们总共有 \(a+k-1\) 次成功和 \(b+n-k-1\) 次失败,于是 \(\text{Beta}(a,b)\) 先验就更新为了 \(\text{Beta}(a+k, b+n-k)\) 后验。

正如第 2.6 节所述,随着我们获得越来越多的证据,我们可以循序渐进地更新我们的信念:我们从一个先验分布开始,更新它得到后验分布,而这个后验分布又成为新的先验分布,我们再通过更新得到新的后验分布,以此类推。这里的妙处在于,所有这些过程都可以在 Beta 分布族内完成,只需根据观察到的成功和失败次数对参数进行简单的更新即可。

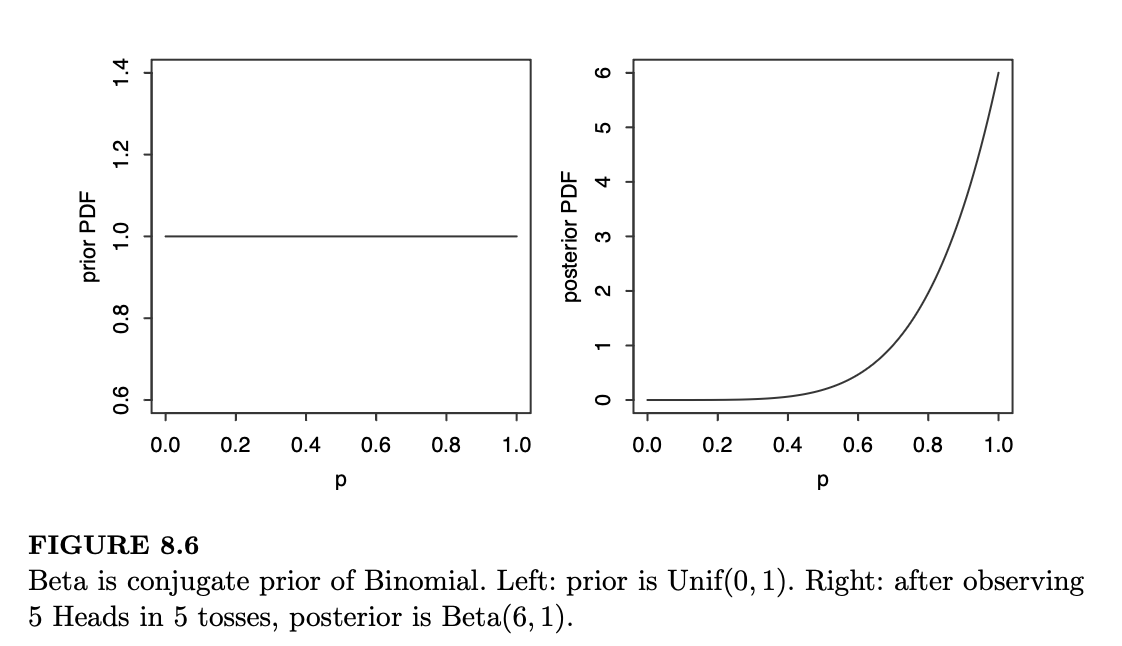

为了具体起见,图 8.6 展示了一个案例:先验分布是 \(\text{Beta}(1,1)\)(如前所述,等价于 \(\text{Unif}(0,1)\)),我们观察到 \(n=5\) 次硬币投掷,且恰好结果全是正面。此时后验分布为 \(\text{Beta}(6,1)\),如图 8.6 的右半部分所示。请注意后验分布是如何融入硬币投掷证据的:较大的 \(p\) 值具有更高的密度,这与我们观察到全是正面的事实是一致的。

这个模型是例 2.3.7 的连续模拟,例 2.3.7 是我们学习贝叶斯法则的第一个例子。在那个例子中,我们也有一枚正面概率 \(p\) 未知的硬币,但我们的先验信息使我们相信 \(p\) 只能取两个可能值中的一个:\(1/2\) 或 \(3/4\)。出于这个原因,我们对 \(p\) 的先验分布是离散的——尽管我们当时没有这么称呼它!具体来说,我们的先验 PMF 为: \[ P(p = 1/2) = 1/2, \] \[ P(p = 3/4) = 1/2. \]

在观察到连续三次正面后,我们更新了这个 PMF 得到后验 PMF,它赋予 \(p=1/2\) 的概率为 0.23,赋予 \(p=3/4\) 的概率为 0.77。相同的逻辑也适用于本章的例子,区别仅在于我们现在赋予 \(p\) 一个连续的先验分布,如果我们认为 \(p\) 可能取 0 到 1 之间的任何值,那么这样做是合适的。

在本节结束之际,这里有两个例子,说明了 Beta-二项共轭性和“贝叶斯台球”故事如何让一些看似复杂的问题变得简单得多。

例 8.3.4(贝叶斯血清 Bayes’ serum)。一种名为“贝叶斯血清”的新疗法刚刚被研发出来,用于治疗“条件性炎”。临床试验即将进行,以研究该疗法的有效性。贝叶斯血清将应用于 \(n\) 名患有“条件性炎”的患者。在给定 \(p\) 的条件下,患者的治疗结果是独立的,每位患者被该疗法治愈的概率均为 \(p\)。但 \(p\) 是未知的。为了量化我们对 \(p\) 的不确定性,我们将 \(p\) 建模为一个随机变量,其先验分布为 \(p \sim \text{Unif}(0,1)\)。

求 \(n\) 名患者中恰好有 \(k\) 名被治愈的概率(无条件的,非给定 \(p\))。

现假设该疗法在临床试验中极其有效:所有 \(n\) 名患者都被治愈了!给定这一信息,求 \(p\) 超过 \(1/2\) 的概率。你的答案应该是完全简化的,并且仅用 \(n\) 表示。

解:

根据全概率公式(LOTP),随后应用“贝叶斯台球”故事或与 Beta 分布的 PDF 进行模式匹配,该概率为: \[ \int_{0}^{1} \binom{n}{k} p^k(1-p)^{n-k}dp = \frac{1}{n+1}. \]

根据 Beta-二项共轭性,给定数据后 \(p\) 的后验分布为 \(\text{Beta}(1+n, 1)\),其 PDF 为 \(f(p) = (n+1)p^n\)(对于 \(0 < p < 1\))。因此: \[ P\left(p > \frac{1}{2}\right) = \int_{1/2}^{1} (n+1)p^n dp = p^{n+1} \Big|_{1/2}^{1} = 1 - \frac{1}{2^{n+1}}. \]

例 8.3.5。一名篮球运动员在明天的比赛中将进行 \(N \sim \text{Pois}(\lambda)\) 次罚球。令 \(X_j\) 为她第 \(j\) 次罚球命中的指示变量,而 \(X = X_1 + \dots + X_N\) 为她在比赛中命中的罚球总数(若 \(N=0\),则 \(X=0\))。为了对该运动员罚球水平的不确定性进行建模,设 \(p \sim \text{Beta}(a, b)\)。在给定 \(p\) 的条件下,运动员每次罚球命中的概率为 \(p\),不命中的概率为 \(q = 1-p\)。假设在给定 \(p\) 的条件下,\(X_1, X_2, \dots\) 是条件独立的,且 \(N\) 与 \(p, X_1, X_2, \dots\) 均独立。

求在给定 \(N, p\) 的条件下 \(X\) 的条件分布。

求在给定 \(p\) 的条件下 \(X\) 的条件分布。

在 \(a=b=1\) 的情况下,求在给定 \(N\) 的条件下 \(X\) 的条件分布。

求在给定 \(X, N\) 的条件下 \(p\) 的条件分布。

解:

根据二项分布的故事,在给定 \(N\) 和 \(p\) 时,命中次数是 \(N\) 次独立试验中成功的次数,故: \[ X|(N, p) \sim \text{Bin}(N, p) \]

根据“鸡生蛋”故事(即泊松过程的分流性质),如果总尝试次数服从泊松分布,且每次尝试以概率 \(p\) 独立成功,那么成功次数服从参数为速率乘以成功概率的泊松分布: \[ X|p \sim \text{Pois}(\lambda p) \]

对于 \(k = 0, 1, \dots, n\),根据全概率公式(LOTP)和“贝叶斯台球”故事: \[ P(X=k|N=n) = \int_{0}^{1} \binom{n}{k} p^k(1-p)^{n-k} dp = \frac{1}{n+1} \]

因此,在给定 \(N\) 的条件下,\(X\) 的条件分布是在 \(\{0, 1, \dots, N\}\) 上的离散均匀分布。

- 根据 Beta-二项共轭性,既然先验是 Beta 分布,且在给定 \(p\) 的条件下 \(X\) 是二项分布的(观察到 \(N\) 次试验中 \(X\) 次成功),后验分布只需在参数上分别累加成功和失败的次数: \[ p|(X, N) \sim \text{Beta}(a + X, b + N - X) \]

8.4 Gamma 分布

Gamma

Gamma 分布是定义在正实数轴上的连续分布;它是指数分布(Exponential distribution)的推广。虽然指数随机变量表示在无记忆性条件下等待第一次成功所需的时间,但我们将看到,Gamma 随机变量可以表示等待多次成功所需的总时间。

在给出 PDF 之前,我们首先介绍 Gamma 函数。这是数学中一个非常著名的函数,它将阶乘函数的概念扩展到了非负整数以外的领域。

定义 8.4.1(Gamma 函数)。对于实数 \(a > 0\),Gamma 函数 \(\Gamma\) 定义为: \[ \Gamma(a) = \int_{0}^{\infty} x^a e^{-x} \frac{dx}{x} \]

我们也可以消去一个 \(x\),将被积函数写成 \(x^{a-1}e^{-x}\),但保留 \(\frac{dx}{x}\) 形式在进行诸如 \(u = cx\) 的变换时非常方便,因为此时有 \(\frac{du}{u} = \frac{dx}{x}\)。以下是 Gamma 函数的两个重要性质:

\(\Gamma(a+1) = a\Gamma(a)\)(对所有 \(a > 0\) 成立)。这可以通过分部积分法证明: \[ \Gamma(a+1) = \int_{0}^{\infty} x^a e^{-x} dx = -x^a e^{-x} \Big|_{0}^{\infty} + a \int_{0}^{\infty} x^{a-1} e^{-x} dx = 0 + a\Gamma(a) \]

如果 \(n\) 是正整数,则 \(\Gamma(n) = (n-1)!\)。这可以通过归纳法证明,从 \(n=1\) 开始并利用递推关系 \(\Gamma(a+1) = a\Gamma(a)\)。因此,当我们在正整数处计算 Gamma 函数时,我们找回了阶乘函数(尽管偏移了 1)。

现在假设我们心血来潮,决定将上述定义的两边同时除以 \(\Gamma(a)\)。我们得到: \[ 1 = \int_{0}^{\infty} \frac{1}{\Gamma(a)} x^a e^{-x} \frac{dx}{x} \]

因此,积分号下的函数是一个定义在 \((0, \infty)\) 上的有效 PDF。这就是 Gamma 分布 PDF 的定义。具体来说,如果随机变量 \(X\) 的 PDF 为: \[ f_X(x) = \frac{1}{\Gamma(a)} x^a e^{-x} \frac{1}{x}, \quad x > 0 \]

则称 \(X\) 服从参数为 \(a\) 和 \(1\) 的 Gamma 分布,记作 \(X \sim \text{Gamma}(a, 1)\)。

从 \(\text{Gamma}(a, 1)\) 分布出发,我们可以通过尺度变换(scale transformation)获得通用的 Gamma 分布:如果 \(X \sim \text{Gamma}(a, 1)\) 且 \(\lambda > 0\),那么 \(Y = X/\lambda\) 的分布被称为 \(\text{Gamma}(a, \lambda)\) 分布。根据变量代换公式,令 \(x = \lambda y\) 且 \(dx/dy = \lambda\),得到 \(Y\) 的 PDF 为: \[ f_Y(y) = f_X(x) \left| \frac{dx}{dy} \right| = \frac{1}{\Gamma(a)} (\lambda y)^a e^{-\lambda y} \frac{1}{\lambda y} \lambda = \frac{1}{\Gamma(a)} (\lambda y)^a e^{-\lambda y} \frac{1}{y}, \quad y > 0 \]

这一结果总结在以下定义中。

定义 8.4.2(Gamma 分布)。如果随机变量 \(Y\) 的 PDF 为: \[ f(y) = \frac{1}{\Gamma(a)}(\lambda y)^a e^{-\lambda y} \frac{1}{y}, \quad y > 0 \]

其中 \(a > 0\) 且 \(\lambda > 0\),则称 \(Y\) 服从参数为 \(a\) 和 \(\lambda\) 的 Gamma 分布。我们记作 \(Y \sim \text{Gamma}(a, \lambda)\)。

若取 \(a = 1\),\(\text{Gamma}(1, \lambda)\) 的 PDF 为 \(f(y) = \lambda e^{-\lambda y}\) (\(y > 0\)),因此 \(\text{Gamma}(1, \lambda)\) 与 \(\text{Expo}(\lambda)\)(指数分布)是相同的。额外的参数 \(a\) 使得 Gamma 分布的 PDF 具有更丰富的形状。

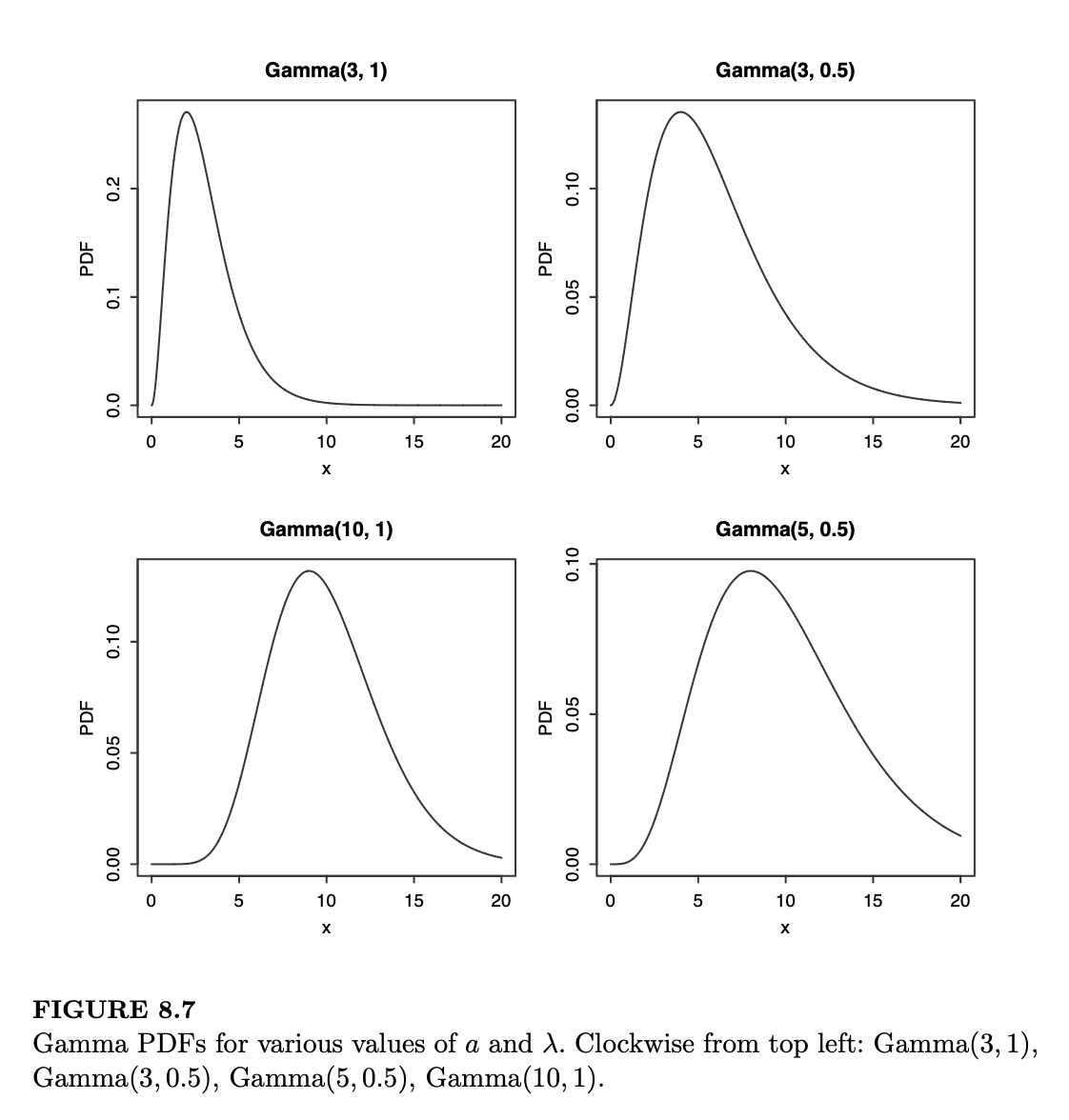

如图 8.7 所示,对于较小的 \(a\) 值,PDF 是偏态的;但随着 \(a\) 的增加,PDF 开始显得更加对称且呈钟形(我们将在第 10 章学习其原因)。增加 \(\lambda\) 会将 PDF 向较小的值压缩,这可以通过对比 \(\text{Gamma}(3, 1)\) 和 \(\text{Gamma}(3, 0.5)\) 的 PDF 观察到。

让我们先从 \(X \sim \text{Gamma}(a, 1)\) 开始计算 Gamma 分布的均值、方差和其他矩。我们将利用 Gamma 函数的性质以及“模式识别”积分法。

对于均值,我们写出 \(E(X)\) 的定义: \[ E(X) = \int_{0}^{\infty} \frac{1}{\Gamma(a)} x^{a+1} e^{-x} \frac{dx}{x} \]

我们无需进行繁琐的分部积分,只需注意到提取出 \(1/\Gamma(a)\) 后,剩下的部分正是 \(a+1\) 处的 Gamma 函数定义。因此: \[ E(X) = \frac{\Gamma(a+1)}{\Gamma(a)} = \frac{a\Gamma(a)}{\Gamma(a)} = a \]

同理,利用 LOTUS,二阶矩的积分表达式为: \[ E(X^2) = \int_{0}^{\infty} \frac{1}{\Gamma(a)} x^{a+2} e^{-x} \frac{dx}{x} \]

这对应于 \(a+2\) 处的 Gamma 函数。因此: \[ E(X^2) = \frac{\Gamma(a+2)}{\Gamma(a)} = \frac{(a+1)a\Gamma(a)}{\Gamma(a)} = (a+1)a \]

进而得到方差: \[ \text{Var}(X) = (a+1)a - a^2 = a \]

所以对于 \(X \sim \text{Gamma}(a, 1)\),有 \(E(X) = \text{Var}(X) = a\)。

计算 \(c\) 阶矩也不难;只需利用 LOTUS 并识别 \(\Gamma(a+c)\) 的定义。对于所有使积分收敛的实数 \(c\)(即 \(c > -a\)): \[ E(X^c) = \frac{\Gamma(a+c)}{\Gamma(a)} \]

现在通过变换 \(Y = X/\lambda \sim \text{Gamma}(a, \lambda)\) 得到:

- 均值:\(E(Y) = \frac{1}{\lambda} E(X) = \frac{a}{\lambda}\)

- 方差:\(\text{Var}(Y) = \frac{1}{\lambda^2} \text{Var}(X) = \frac{a}{\lambda^2}\)

- \(c\) 阶矩:\(E(Y^c) = \frac{1}{\lambda^c} E(X^c) = \frac{1}{\lambda^c} \frac{\Gamma(a+c)}{\Gamma(a)}, \quad c > -a\)

回顾 PDF 图象,这与我们发现的“均值和方差随 \(a\) 增加而增加,随 \(\lambda\) 增加而减小”是一致的。

到目前为止,我们一直在通过 PDF 学习 Gamma 分布。虽然这有助于我们观察一般模式并推导矩,但 PDF 并没有告诉我们为什么要使用 Gamma 分布,也没有给出参数 \(a\) 和 \(\lambda\) 的直观解释。为此,我们需要通过“故事”将 Gamma 分布与其他命名分布联系起来。

在 \(a\) 为整数的特殊情况下,我们可以将 \(\text{Gamma}(a, \lambda)\) 随机变量表示为 \(a\) 个独立同分布的 \(\text{Expo}(\lambda)\) 随机变量之和(卷积)。

定理 8.4.3。设 \(X_1, \dots, X_n\) 为独立同分布(i.i.d.)的 \(\text{Expo}(\lambda)\) 随机变量,则: \[ X_1 + \dots + X_n \sim \text{Gamma}(n, \lambda) \]

证明。\(\text{Expo}(\lambda)\) 的 MGF(矩生成函数)为 \(\frac{\lambda}{\lambda - t}\)(对于 \(t < \lambda\)),因此 \(X_1 + \dots + X_n\) 的 MGF 为: \[ M_n(t) = \left( \frac{\lambda}{\lambda - t} \right)^n, \quad t < \lambda \]

设 \(Y \sim \text{Gamma}(n, \lambda)\);我们将证明 \(Y\) 的 MGF 与 \(X_1 + \dots + X_n\) 的相同。根据 LOTUS: \[ E(e^{tY}) = \int_{0}^{\infty} e^{ty} \frac{1}{\Gamma(n)} (\lambda y)^n e^{-\lambda y} \frac{dy}{y} \]

我们再次使用“模式识别”法来处理这个积分。我们只需进行代数变形,直到积分号内部呈现出可辨认的 Gamma PDF: \[ E(e^{tY}) = \frac{\lambda^n}{(\lambda - t)^n} \int_{0}^{\infty} \frac{1}{\Gamma(n)} e^{-(\lambda - t)y} ((\lambda - t)y)^n \frac{dy}{y} \]

我们将 \(\lambda^n\) 提至积分外,在积分内乘以 \((\lambda - t)^n\) 的同时也从积分外除以它。现在,假设 \(t < \lambda\),积分号内部的表达式正是 \(\text{Gamma}(n, \lambda - t)\) 的 PDF。由于 PDF 的积分为 1,我们得到: \[ E(e^{tY}) = \left( \frac{\lambda}{\lambda - t} \right)^n, \quad t < \lambda \]

若 \(t \ge \lambda\),积分发散。既然 MGF 决定了分布,那么 \(X_1 + \dots + X_n \sim \text{Gamma}(n, \lambda)\)。

或者,我们可以通过归纳法计算卷积积分。只需考虑 \(\lambda = 1\) 的情况(之后可以通过尺度变换推广)。设 \(T_n = X_1 + \dots + X_n\)。

基础步:\(n=1\) 时,\(T_1 = X_1 \sim \text{Expo}(1)\),即 \(\text{Gamma}(1, 1)\),成立。

归纳步:假设 \(T_n \sim \text{Gamma}(n, 1)\)。则 \(T_{n+1} = T_n + X_{n+1}\) 的 PDF 为: \[ f_{T_{n+1}}(t) = \int_{0}^{t} \frac{1}{\Gamma(n)} x^{n-1} e^{-x} e^{-(t-x)} dx = \frac{e^{-t}}{\Gamma(n)} \int_{0}^{t} x^{n-1} dx = \frac{e^{-t} t^n}{n \cdot \Gamma(n)} = \frac{1}{\Gamma(n+1)} t^n e^{-t} \]

对于 \(t > 0\) 成立,归纳完成。

因此,如果 \(Y \sim \text{Gamma}(a, \lambda)\) 且 \(a\) 为整数,我们可以将 \(Y\) 表示为 \(a\) 个独立同分布的 \(\text{Expo}(\lambda)\) 随机变量之和 \(X_1 + \dots + X_a\),并立即得到均值和方差: \[ E(Y) = E(X_1 + \dots + X_a) = aE(X_1) = \frac{a}{\lambda} \] \[ \text{Var}(Y) = \text{Var}(X_1 + \dots + X_a) = a\text{Var}(X_1) = \frac{a}{\lambda^2} \]

这与我们之前为一般情形下的 \(a\) 推导出的结果一致。

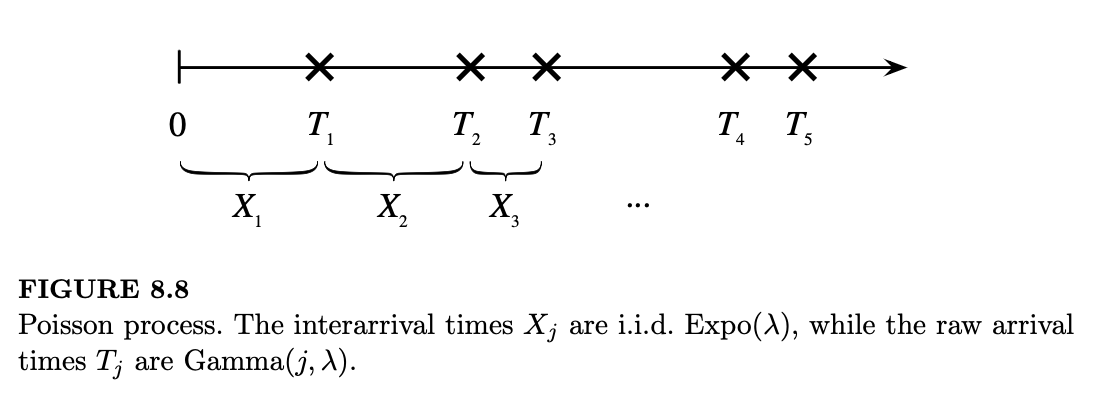

定理 8.4.3 还允许我们将伽马分布与泊松过程的故事联系起来。我们在第 5 章中展示了在速率为 \(\lambda\) 的泊松过程中,到达间隔时间是独立同分布的 \(\text{Expo}(\lambda)\) 随机变量。而第 \(n\) 次到达的总等待时间 \(T_n\) 是前 \(n\) 个到达间隔时间的总和;例如,图 8.8 展示了 \(T_3\) 是 3 个到达间隔时间 \(X_1, X_2, X_3\) 的总和。因此,根据该定理,\(T_n \sim \text{Gamma}(n, \lambda)\)。泊松过程中的到达间隔时间是指数随机变量,而原始到达时间则是伽马随机变量。

这些 \(T_j\) 服从 \(\text{Gamma}(j, \lambda)\) 分布。

8.4.4. 与 \(X_j\) 不同,\(T_j\) 并不是独立的,因为它们被约束为递增的;它们也不是同分布的。

终于,我们对 \(\text{Gamma}(a, \lambda)\) 分布的参数有了直观解释。在泊松过程的故事中,\(a\) 是我们等待的成功次数,而 \(\lambda\) 是成功发生的速率;\(Y \sim \text{Gamma}(a, \lambda)\) 是速率为 \(\lambda\) 的泊松过程中第 \(a\) 次到达所需的总等待时间。

这个故事的一个推论是,具有相同 \(\lambda\) 的伽马分布的卷积仍然是伽马分布。习题 29 从多个角度探讨了这一事实。

当我们引入指数分布时,将其视为几何分布的连续模拟:几何分布在离散时间内等待第一次成功,而指数分布在连续时间内等待第一次成功。同样地,我们现在可以说伽马分布是负二项分布的连续模拟:负二项分布是几何等待时间的总和,而伽马分布是指数等待时间的总和。在习题 54 中,你将使用矩生成函数(MGF)来证明伽马分布可以作为负二项分布的连续极限而得到。

关于伽马分布的最后一个故事是,它与泊松分布共享一种特殊的对应关系,正如贝塔分布与二项分布的关系一样:伽马分布是泊松分布的共轭先验。之前我们看到贝塔分布可以表示一个未知的成功概率,因为它的支撑集是 \((0, 1)\)。另一方面,伽马分布可以表示泊松过程中的未知速率,因为它的支撑集是 \((0, \infty)\)。

为了进行研究,我们将回到布洛奇维尔(Blotchville),那里的公交车按照速率为 \(\lambda\) 的泊松过程到达。此前假设 \(\lambda = 1/10\),因此公交车之间的间隔时间是均值为 10 分钟的独立同分布指数随机变量,但现在我们将假设弗雷德(Fred)不知道公交车到达的速率 \(\lambda\),并且需要计算出它。弗雷德将采用贝叶斯方法,将未知的速率视为一个随机变量。

故事 8.4.5(伽马-泊松共轭性)。在布洛奇维尔,公交车按照速率为 \(\lambda\)(辆/小时)的泊松过程到达某个车站,其中 \(\lambda\) 是未知的。基于他在布洛奇维尔那些非常令人难忘的经历,弗雷德使用先验分布 \(\lambda \sim \text{Gamma}(r_0, b_0)\) 来量化他对 \(\lambda\) 的不确定性,其中 \(r_0\) 和 \(b_0\) 是已知的正常数,且 \(r_0\) 为整数。

为了更好地了解公交系统,弗雷德想要进一步了解 \(\lambda\)。他是一个非常有耐心的人,决定在车站坐 \(t\) 小时,并计算这段时间内有多少辆公交车到达。令 \(Y\) 为这段时间内的公交车数量,并假设弗雷德观察到 \(Y = y\)。

求弗雷德关于 \(Y\) 和 \(\lambda\) 的混合联合分布。

求弗雷德关于 \(Y\) 的边缘分布。

求弗雷德关于 \(\lambda\) 的后验分布,即给定观测数据 \(y\) 时 \(\lambda\) 的条件分布。

求弗雷德的后验均值 \(E(\lambda|Y=y)\) 和后验方差 \(\text{Var}(\lambda|Y=y)\)。

解答:注意此问题的结构与示例 7.1.26 中的混合联合分布的相似性。我们已知 \(\lambda\) 的边缘分布是 \(\text{Gamma}(r_0, b_0)\),且根据泊松过程的定义,在已知真实速率 \(\lambda\) 的条件下,长度为 \(t\) 的区间内的公交车数量服从 \(\text{Pois}(\lambda t)\)。换句话说,已知条件是: \[ \lambda \sim \text{Gamma}(r_0, b_0) \] \[ Y|\lambda \sim \text{Pois}(\lambda t) \]

然后我们被要求将其反转:求 \(Y\) 的边缘分布,以及给定 \(Y = y\) 时 \(\lambda\) 的条件分布(即后验分布)。这是贝叶斯统计推断的典型特征:我们拥有未知参数的先验分布(在本例中是 \(\lambda\) 的伽马分布),以及给定未知参数时数据的模型(在本例中是给定 \(\lambda\) 时 \(Y\) 的泊松分布),然后我们利用贝叶斯法则来获得给定观测数据时未知参数的分布。那么我们开始吧。

- 令 \(f_0\) 为 \(\lambda\) 的先验概率密度函数(PDF)。\(Y\) 和 \(\lambda\) 的混合联合分布为: \[ f(y, \lambda) = P(Y=y|\lambda)f_0(\lambda) = \frac{e^{-\lambda t}(\lambda t)^y}{y!} \frac{(b_0 \lambda)^{r_0} e^{-b_0 \lambda}}{\lambda \Gamma(r_0)} \]

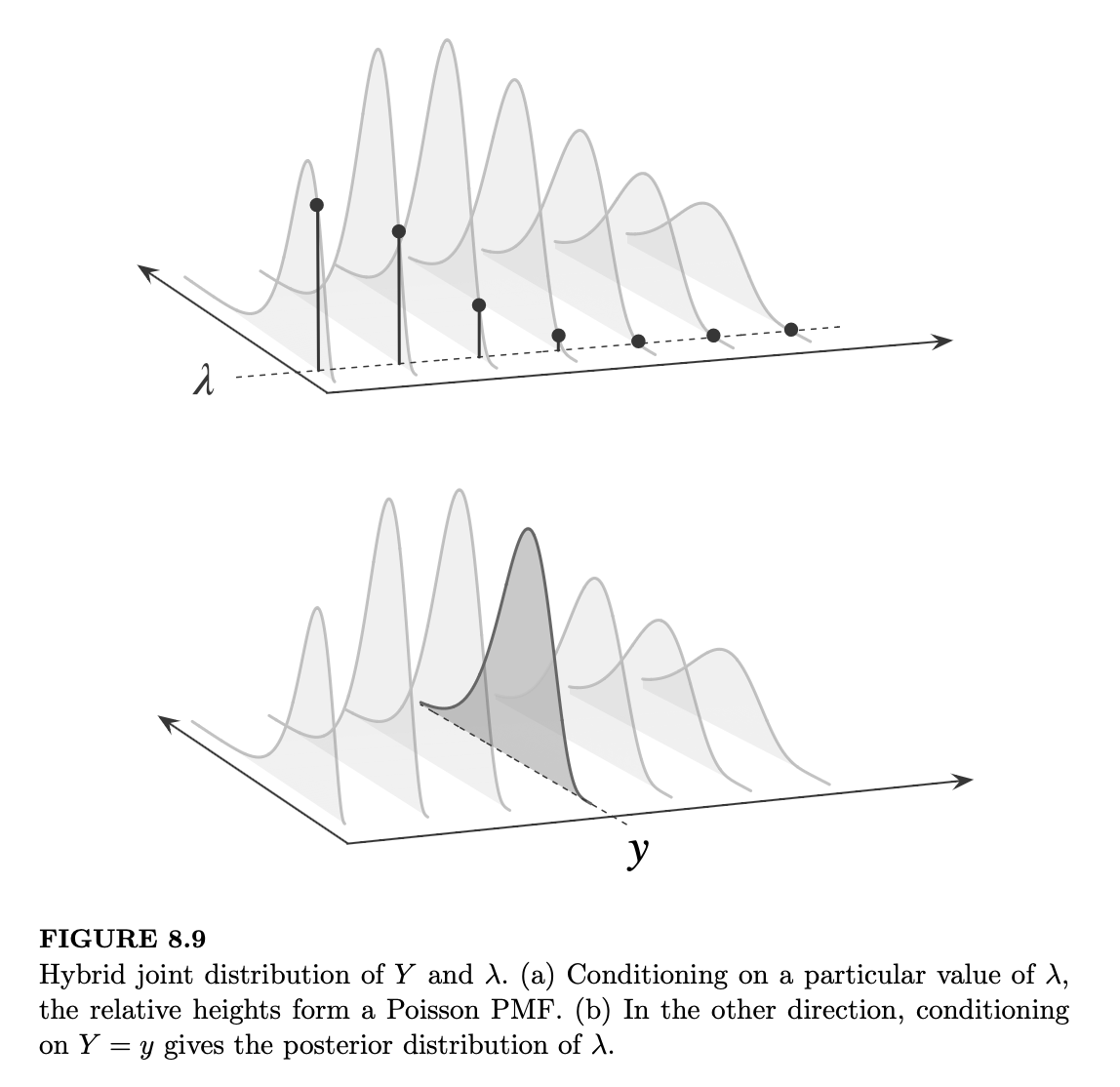

其中 \(y = 0, 1, 2, \dots\) 且 \(\lambda > 0\)。混合联合分布如图 8.9 所示;对于 \(\lambda\) 的每一个值都有一个 \(Y\) 的条件概率质量函数(PMF),对于 \(Y\) 的每一个值都有一个 \(\lambda\) 的条件概率密度函数(PDF)。

- 为了得到 \(Y\) 的边缘 PMF,我们从混合联合分布中对 \(\lambda\) 进行积分;这也是全概率公式(LOTP)的一种形式。这得到: \[ P(Y=y) = \int_{0}^{\infty} P(Y=y|\lambda)f_0(\lambda)d\lambda = \int_{0}^{\infty} \frac{e^{-\lambda t}(\lambda t)^y}{y!} \frac{(b_0 \lambda)^{r_0} e^{-b_0 \lambda}}{\Gamma(r_0)} \frac{d\lambda}{\lambda} \]

让我们通过模式识别来计算这个积分,重点关注涉及 \(\lambda\) 的项。我们在被积函数中发现了 \(\lambda^{r_0+y}\) 和 \(e^{-(b_0+t)\lambda}\),这表明可以匹配 \(\text{Gamma}(r_0 + y, b_0 + t)\) 的 PDF 模式。提取出所有不依赖于 \(\lambda\) 的项,然后在积分内乘以构造目标 PDF 所需的系数,同时记得在积分外乘以其倒数: \[ P(Y=y) = \frac{t^y b_0^{r_0}}{y! \Gamma(r_0)} \int_{0}^{\infty} e^{-(b_0+t)\lambda} \lambda^{r_0+y} \frac{d\lambda}{\lambda} \] \[ = \frac{t^y b_0^{r_0}}{y! \Gamma(r_0)} \frac{\Gamma(r_0+y)}{(b_0+t)^{r_0+y}} \int_{0}^{\infty} \frac{(b_0+t)^{r_0+y} e^{-(b_0+t)\lambda} \lambda^{r_0+y}}{\Gamma(r_0+y)} \frac{d\lambda}{\lambda} \] \[ = \frac{(r_0+y-1)!}{(r_0-1)!y!} \left(\frac{t}{b_0+t}\right)^y \left(\frac{b_0}{b_0+t}\right)^{r_0} \]

在最后一步中,我们使用了性质 \(\Gamma(n) = (n-1)!\),这适用于 \(r_0\) 为整数的情况。这是 \(\text{NBin}(r_0, b_0/(b_0 + t))\) 的 PMF,因此 \(Y\) 的边缘分布是参数为 \(r_0\) 和 \(b_0/(b_0 + t)\) 的负二项分布。

- 根据贝叶斯法则,\(\lambda\) 的后验 PDF 为: \[ f_1(\lambda|y) = \frac{P(Y=y|\lambda)f_0(\lambda)}{P(Y=y)} \]

我们在前一部分求得了 \(P(Y=y)\),但由于它不依赖于 \(\lambda\),我们可以直接将其视为归一化常数的一部分。将此项和其他不依赖于 \(\lambda\) 的乘法因子并入归一化常数中: \[ f_1(\lambda|y) \propto e^{-\lambda t} \lambda^y \lambda^{r_0} e^{-b_0 \lambda} \frac{1}{\lambda} = e^{-(b_0+t)\lambda} \lambda^{r_0+y} \frac{1}{\lambda} \]

这表明 \(\lambda\) 的后验分布是 \(\text{Gamma}(r_0 + y, b_0 + t)\)。

当从先验转变为后验时,\(\lambda\) 的分布保持在伽马分布族中,因此伽马分布确实是泊松分布的共轭先验。

现在我们有了 \(\lambda\) 的后验 PDF,我们可以用一种更优雅的方法来解决 (b)。重排贝叶斯法则,\(Y\) 的边缘 PMF 为: \[ P(Y=y) = \frac{P(Y=y|\lambda)f_0(\lambda)}{f_1(\lambda|y)} \]

我们从题目叙述中已知分子,从刚才的计算中已知分母。带入这些成分并再次化简可得: \[ Y \sim \text{NBin}(r_0, b_0/(b_0 + t)) \]

- 由于条件 PDF 也是 PDF,因此根据后验分布计算 \(\lambda\) 的期望和方差是完全合理的。\(\text{Gamma}(r_0 + y, b_0 + t)\) 分布的均值和方差给出了: \[ E(\lambda|Y=y) = \frac{r_0 + y}{b_0 + t} \quad \text{和} \quad \text{Var}(\lambda|Y=y) = \frac{r_0 + y}{(b_0 + t)^2} \]

这个例子为伽马分布作为共轭先验时的参数提供了另一种解释。弗雷德的 \(\text{Gamma}(r_0, b_0)\) 先验在观察到 \(t\) 小时内有 \(y\) 次到达后,更新为了 \(\text{Gamma}(r_0 + y, b_0 + t)\) 后验。我们可以想象,在过去,弗雷德观察到有 \(r_0\) 辆公交车在 \(b_0\) 小时内到达;那么在得到新数据后,他共观察到了 \(r_0 + y\) 辆公交车在 \(b_0 + t\) 小时内到达。因此,我们可以将 \(r_0\) 解释为先验到达次数,将 \(b_0\) 解释为这些先验到达所需的总时间。

8.5 贝塔-伽马的联系

Beta-Gamma connections

在本节中,我们将通过一个共同的故事将贝塔分布和伽马分布联系起来。作为额外的收获,这个故事将为我们提供一个用伽马函数表示的 \(\text{Beta}(a,b)\) 概率密度函数(PDF)的归一化常数表达式,并使我们能够轻松地求出 \(\text{Beta}(a,b)\) 分布的期望。

故事 8.5.1(银行-邮局)在办事时,你需要先去银行,再去邮局。令 \(X \sim \text{Gamma}(a,\lambda)\) 为你在银行排队等候的时间,令 \(Y \sim \text{Gamma}(b,\lambda)\) 为你在邮局排队等候的时间(两者的 \(\lambda\) 相同)。假设 \(X\) 和 \(Y\) 相互独立。那么 \(T = X + Y\)(你在银行和邮局的总等候时间)与 \(W = \frac{X}{X+Y}\)(你在银行花费的时间占总等候时间的比例)的联合分布是什么?

个人注:\(a\) 和 \(b\) 的直觉意义:等待的“人数”或“步骤”

在伽马分布的故事中,我们将总等待时间看作是多个独立且速率相同的指数分布(等待第一个人的时间)之和。

- \(a\) 的直觉意义:你在银行排队时,排在你前面的总人数(或者你需要等待完成的业务步骤数)。

- 如果你前面有 \(a\) 个人,每个人办理业务的时间都服从 \(\text{Exp}(\lambda)\),那么你等待的总时间 \(X\) 自然就服从 \(\text{Gamma}(a, \lambda)\)。

- \(b\) 的直觉意义:你在邮局排队时,排在你前面的总人数。

为什么 \(\lambda\) 必须相同?

在这个故事里,\(\lambda\) 代表的是办事效率(平均每分钟能处理多少人)。

公式成立的前提是假设银行柜员和邮局柜员的办事速度是一样快的。只有这样,你才能把总时间 \(T = X+Y\) 看作是在一个统一的泊松流中等待了 \(a+b\) 个人。

解答:

我们将进行二维变量代换来求 \(T\) 和 \(W\) 的联合 PDF。

令 \(t = x + y, w = \frac{x}{x+y}\)。则 \(x = tw, y = t(1-w)\),且雅可比矩阵为: \[ \frac{\partial(x,y)}{\partial(t,w)} = \begin{pmatrix} w & t \\ 1-w & -t \end{pmatrix} \]

其行列式的绝对值为 \(t\)。因此: \[ f_{T,W}(t,w) = f_{X,Y}(x,y) \cdot \left| \frac{\partial(x,y)}{\partial(t,w)} \right| \] \[ = f_X(x)f_Y(y) \cdot t \] \[ = \frac{1}{\Gamma(a)}(\lambda x)^a e^{-\lambda x} \frac{1}{x} \cdot \frac{1}{\Gamma(b)}(\lambda y)^b e^{-\lambda y} \frac{1}{y} \cdot t \] \[ = \frac{1}{\Gamma(a)}(\lambda tw)^a e^{-\lambda tw} \frac{1}{tw} \cdot \frac{1}{\Gamma(b)}(\lambda t(1-w))^b e^{-\lambda t(1-w)} \frac{1}{t(1-w)} \cdot t \]

让我们将所有涉及 \(w\) 的项归为一类,将所有涉及 \(t\) 的项归为一类: \[ f_{T,W}(t,w) = \frac{1}{\Gamma(a)\Gamma(b)} w^{a-1}(1-w)^{b-1} (\lambda t)^{a+b} e^{-\lambda t} \frac{1}{t} \] \[ = \frac{\Gamma(a+b)}{\Gamma(a)\Gamma(b)} w^{a-1}(1-w)^{b-1} \cdot \frac{1}{\Gamma(a+b)} (\lambda t)^{a+b} e^{-\lambda t} \frac{1}{t} \]

其中 \(0 < w < 1\) 且 \(t > 0\)。联合 PDF 的形式结合命题 7.1.21 告诉了我们几件事:

由于联合 PDF 可以分解为关于 \(t\) 的函数与关于 \(w\) 的函数的乘积,我们得出 \(T\) 和 \(W\) 是相互独立的:总等待时间与在银行度过的时间比例是独立的。

我们识别出 \(T\) 的边缘 PDF,并推导出 \(T \sim \text{Gamma}(a+b, \lambda)\)。

\(W\) 的概率密度函数为: \[ f_W(w) = \frac{\Gamma(a+b)}{\Gamma(a)\Gamma(b)} w^{a-1}(1-w)^{b-1}, \quad 0 < w < 1 \]

这可以通过命题 7.1.21 得到,或者直接通过对联合 PDF 中的 \(T\) 进行积分得到。由于该 PDF 与 \(\text{Beta}(a,b)\) 的 PDF 成正比,因此它就是 \(\text{Beta}(a,b)\) 的 PDF!

注意,作为我们刚才计算的副产品,我们已经找到了贝塔分布的归一化常数: \[ \frac{1}{\beta(a,b)} = \frac{\Gamma(a+b)}{\Gamma(a)\Gamma(b)} \]

即置于 \(\text{Beta}(a,b)\) 概率密度函数前面的常数。

总而言之,“银行-邮局”故事告诉我们:当我们将具有相同速率 \(\lambda\) 的独立伽马随机变量 \(X\) 和 \(Y\) 相加时,总量 \(X+Y\) 服从伽马分布,比例 \(X/(X+Y)\) 服从贝塔分布,且总量与比例相互独立。

我们可以利用这一结果,在不使用任何微积分的情况下求出 \(W \sim \text{Beta}(a,b)\) 的均值。

示例 8.5.2(贝塔分布的期望)使用上述符号,注意由于 \(T\) 和 \(W\) 相互独立,它们是不相关的:\(E(TW) = E(T)E(W)\)。用 \(X\) 和 \(Y\) 来表示,即: \[ E\left( (X+Y) \cdot \frac{X}{X+Y} \right) = E(X+Y)E\left( \frac{X}{X+Y} \right) \] \[ E(X) = E(X+Y)E\left( \frac{X}{X+Y} \right) \] \[ \frac{E(X)}{E(X+Y)} = E\left( \frac{X}{X+Y} \right) \]

通常情况下,最后一个等式将是一个可怕的错误:面对像 \(E(X/(X+Y))\) 这样的期望,我们一般不允许随意将 \(E\) 移入分子和分母。然而,在这种情况下,“银行-邮局”故事证明了这一操作的合理性,因此求 \(W\) 的期望便愉快地简化为求 \(X\) 和 \(X+Y\) 的期望: \[ E(W) = E\left( \frac{X}{X+Y} \right) = \frac{E(X)}{E(X+Y)} = \frac{a/\lambda}{a/\lambda + b/\lambda} = \frac{a}{a+b} \]

另一种方法是从期望的定义出发: \[ E(W) = \int_0^1 w \frac{\Gamma(a+b)}{\Gamma(a)\Gamma(b)} w^{a-1}(1-w)^{b-1} dw = \int_0^1 \frac{\Gamma(a+b)}{\Gamma(a)\Gamma(b)} w^a(1-w)^{b-1} dw \]

通过模式识别,被积函数在差一个归一化常数的情况下是 \(\text{Beta}(a+1, b)\) 的 PDF。在通过配凑完全匹配 PDF 后,我们应用伽马函数的性质: \[ E(W) = \frac{\Gamma(a+b)}{\Gamma(a)\Gamma(b)} \frac{\Gamma(a+1)\Gamma(b)}{\Gamma(a+1+b)} = \frac{\Gamma(a+b)}{\Gamma(a)} \frac{a\Gamma(a)}{(a+b)\Gamma(a+b)} = \frac{a}{a+b} \]

在习题 30 中,你将使用这种方法来求贝塔分布的方差和其他阶矩。

既然我们已经知道了贝塔分布的归一化常数,我们也可以迅速得出贝塔-二项分布(Beta-Binomial)的 PMF。

示例 8.5.3(贝塔-二项分布 PMF)令 \(X|p \sim \text{Bin}(n,p)\),其中 \(p \sim \text{Beta}(a,b)\)。

正如故事 8.3.3 中提到的,\(X\) 服从贝塔-二项分布。求 \(X\) 的边缘分布。

解答:

令 \(f(p)\) 为 \(\text{Beta}(a,b)\) 的概率密度函数(PDF)。那么: \[ P(X=k) = \int_0^1 P(X=k|p)f(p)dp \] \[ = \int_0^1 \binom{n}{k} p^k(1-p)^{n-k} \frac{1}{\beta(a,b)} p^{a-1}(1-p)^{b-1} dp \] \[ = \binom{n}{k} \frac{1}{\beta(a,b)} \int_0^1 p^{a+k-1}(1-p)^{b+n-k-1} dp \] \[ = \binom{n}{k} \frac{\beta(a+k, b+n-k)}{\beta(a,b)} \]

对于 \(k = 0, 1, \dots, n\)。

8.6 次序统计量

Order statistics

本章我们将考虑的最后一种变换是将 \(n\) 个随机变量 \(X_1, \dots, X_n\) 按大小顺序进行排列,生成变换后的随机变量 \(\min(X_1, \dots, X_n), \dots, \max(X_1, \dots, X_n)\)。这些变换后的随机变量被称为次序统计量(order statistics)。正如我们之前提到的,当我们关注极值的分布时,它们通常非常有用。

此外,与样本均值 \(\bar{X}_n\) 类似,次序统计量也是实验中有用的汇总信息,因为我们可以利用它们来确定观测值中表现最差的 5%、最差的 25%、最好的 25% 等等(这些临界值被称为样本的分位数 the quantiles of the sample)。

定义 8.6.1(次序统计量)。对于随机变量 \(X_1, X_2, \dots, X_n\),次序统计量是随机变量 \(X_{(1)}, X_{(2)}, \dots, X_{(n)}\),其中:

\(X_{(1)} = \min(X_1, \dots, X_n)\),

\(X_{(2)}\) 是 \(X_1, \dots, X_n\) 中的第二小值,

\(\dots\)

\(X_{(n-1)}\) 是 \(X_1, \dots, X_n\) 中的第二大值,

\(X_{(n)} = \max(X_1, \dots, X_n)\)。

根据定义,有 \(X_{(1)} \le X_{(2)} \le \dots \le X_{(n)}\)。我们称 \(X_{(j)}\) 为第 \(j\) 个次序统计量。如果 \(n\) 为奇数,则 \(X_{((n+1)/2)}\) 被称为 \(X_1, \dots, X_n\) 的样本中位数。

8.6.2. 次序统计量 \(X_{(1)}, \dots, X_{(n)}\) 都是随机变量,且每个 \(X_{(j)}\) 都是 \(X_1, \dots, X_n\) 的函数。即使原始随机变量是相互独立的,次序统计量也是相关的:如果我们知道 \(X_{(1)} = 100\),那么 \(X_{(n)}\) 必然至少为 100。

我们将重点关注 \(X_1, \dots, X_n\) 是独立同分布(i.i.d.)连续随机变量的情况。原因是对于离散随机变量,观测值相等的概率大于 0;而对于连续随机变量,取值相等的概率恰好为 0,这使问题变得简单得多。因此,在本节的剩余部分,假设 \(X_1, \dots, X_n\) 是独立同分布且连续的,其累积分布函数(CDF)为 \(F\),概率密度函数(PDF)为 \(f\)。我们将推导每个单独次序统计量 \(X_{(j)}\) 的边缘 CDF 和 PDF,以及 \((X_{(1)}, \dots, X_{(n)})\) 的联合 PDF。

我们立刻会遇到的一个复杂问题是,向次序统计量的变换是不可逆的:从 \(\min(X, Y) = 3\) 且 \(\max(X, Y) = 5\) 出发,我们无法判断 \(X\) 和 \(Y\) 的原始值分别是 3 和 5,还是 5 和 3。因此,从 \(\mathbb{R}^n\) 到 \(\mathbb{R}^n\) 的变量代换公式并不适用。相反,我们将采取直接的方法,必要时辅以图形引导。

让我们从 \(X_{(n)} = \max(X_1, \dots, X_n)\) 的 CDF 开始。由于 \(X_{(n)}\) 小于 \(x\) 当且仅当所有的 \(X_j\) 都小于 \(x\),因此 \(X_{(n)}\) 的 CDF 为: \[ F_{X_{(n)}}(x) = P(\max(X_1, \dots, X_n) \le x) \] \[ = P(X_1 \le x, \dots, X_n \le x) \] \[ = P(X_1 \le x) \dots P(X_n \le x) \] \[ = (F(x))^n \]

其中 \(F\) 是单个 \(X_i\) 的 CDF。类似地,\(X_{(1)} = \min(X_1, \dots, X_n)\) 大于 \(x\) 当且仅当所有的 \(X_j\) 都大于 \(x\),因此 \(X_{(1)}\) 的 CDF 为: \[ F_{X_{(1)}}(x) = 1 - P(\min(X_1, \dots, X_n) > x) \] \[ = 1 - P(X_1 > x, \dots, X_n > x) \] \[ = 1 - (1 - F(x))^n \]

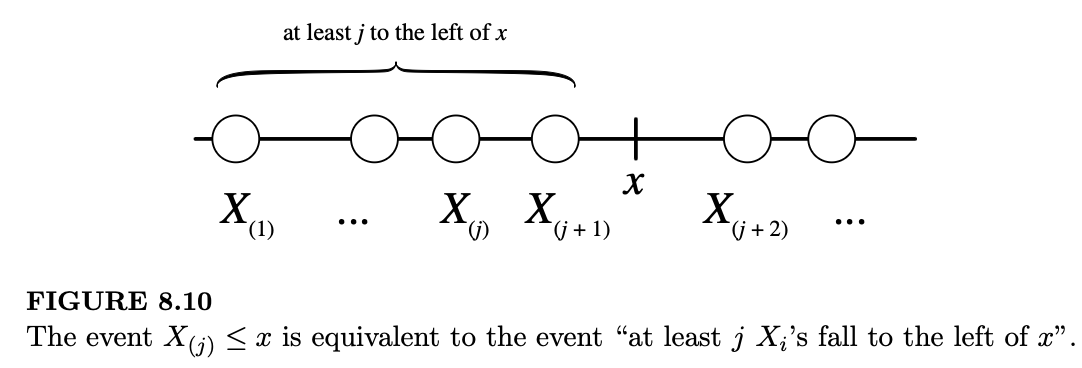

同样的逻辑可以让我们找到 \(X_{(j)}\) 的 CDF。为了使事件 \(X_{(j)} \le x\) 发生,我们需要至少有 \(j\) 个 \(X_i\) 落到 \(x\) 的左侧。如图 8.10 所示。

由于落到 \(x\) 左侧的 \(X_i\) 的数量对我们很重要,让我们定义一个新的随机变量 \(N\) 来记录它:定义 \(N\) 为落到 \(x\) 左侧的 \(X_i\) 的个数。每个 \(X_i\) 独立地以概率 \(F(x)\) 落到 \(x\) 左侧。如果我们将“落到 \(x\) 左侧”定义为成功,那么我们就有了 \(n\) 次独立的伯努利试验,成功概率为 \(F(x)\),因此 \(N \sim \text{Bin}(n, F(x))\)。那么,根据二项分布的 PMF: \[ P(X_{(j)} \le x) = P(\text{至少有 } j \text{ 个 } X_i \text{ 在 } x \text{ 的左侧}) \] \[ = P(N \ge j) \] \[ = \sum_{k=j}^{n} \binom{n}{k} F(x)^k (1-F(x))^{n-k} \]

因此,我们得到了关于 \(X_{(j)}\) 累积分布函数(CDF)的如下结果。

定理 8.6.3(次序统计量的 CDF)。令 \(X_1, \dots, X_n\) 为独立同分布的连续随机变量,其 CDF 为 \(F\)。则第 \(j\) 个次序统计量 \(X_{(j)}\) 的 CDF 为: \[ P(X_{(j)} \le x) = \sum_{k=j}^{n} \binom{n}{k} F(x)^k (1-F(x))^{n-k} \]

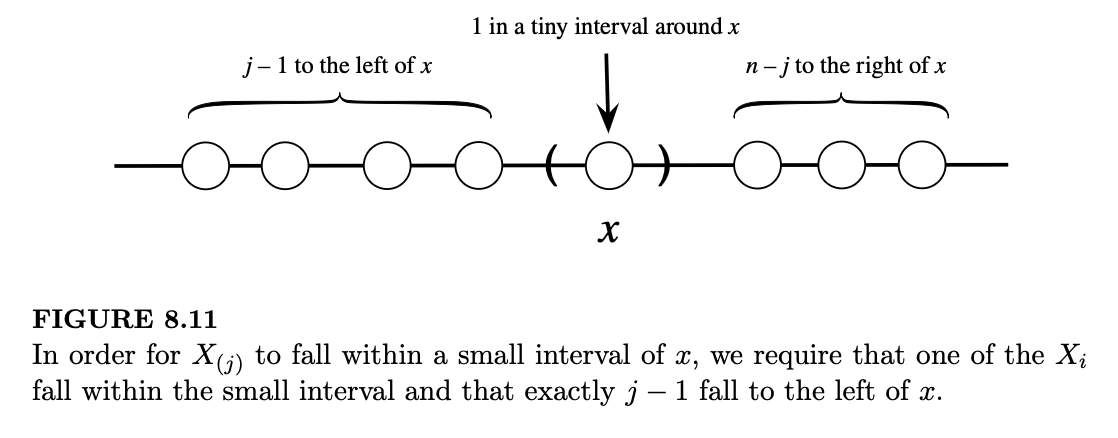

为了得到 \(X_{(j)}\) 的 PDF,我们可以对 CDF 关于 \(x\) 求导,但得到的结果会很丑陋(尽管可以化简)。相反,我们将采用一种更直接的方法。考虑 \(f_{X_{(j)}}(x)dx\),即第 \(j\) 个次序统计量落在 \(x\) 附近长度为 \(dx\) 的无穷小区间内的概率。这种情况发生的唯一方式如图 8.11 所示。我们需要其中一个 \(X_i\) 落在 \(x\) 附近的无穷小区间内,并且需要恰好有 \(j-1\) 个 \(X_i\) 落在 \(x\) 的左侧,剩下的 \(n-j\) 个落到 \(x\) 的右侧。

这个极其特定事件的概率是多少?让我们把实验分解为几个阶段:

- 首先,我们选择 \(X_i\) 中的哪一个将落在 \(x\) 附近的无穷小区间内。有 \(n\) 种这样的选择,每种情况发生的概率为 \(f(x)dx\),其中 \(f\) 是 \(X_i\) 的 PDF。

- 接着,我们从剩下的 \(n-1\) 个变量中选出恰好 \(j-1\) 个落到 \(x\) 的左侧。有 \(\binom{n-1}{j-1}\) 种选择方式,根据 \(\text{Bin}(n, F(x))\) 的 PMF,每种方式的概率为 \(F(x)^{j-1}(1-F(x))^{n-j}\)。

我们将这两个阶段的概率相乘得到: \[ f_{X_{(j)}}(x)dx = n f(x)dx \binom{n-1}{j-1} F(x)^{j-1} (1-F(x))^{n-j} \]

两边消去 \(dx\) 就得到了我们想要的 PDF。

定理 8.6.4(次序统计量的 PDF)。令 \(X_1, \dots, X_n\) 为独立同分布的连续随机变量,其 CDF 为 \(F\),PDF 为 \(f\)。则第 \(j\) 个次序统计量 \(X_{(j)}\) 的边缘 PDF 为: \[ f_{X_{(j)}}(x) = n \binom{n-1}{j-1} f(x) F(x)^{j-1} (1-F(x))^{n-j} \]

通常情况下,\(X_1, \dots, X_n\) 的次序统计量不属于任何有名称的分布,但标准均匀分布的次序统计量是一个例外。

示例 8.6.5(均匀分布的次序统计量)。令 \(U_1, \dots, U_n\) 独立同分布于 \(\text{Unif}(0,1)\)。那么对于 \(0 \le x \le 1\),\(f(x) = 1\) 且 \(F(x) = x\),因此 \(U_{(j)}\) 的 PDF 为: \[ f_{U_{(j)}}(x) = n \binom{n-1}{j-1} x^{j-1} (1-x)^{n-j} \]

这就是 \(\text{Beta}(j, n-j+1)\) 的 PDF!所以 \(U_{(j)} \sim \text{Beta}(j, n-j+1)\),且 \(E(U_{(j)}) = \frac{j}{n+1}\)。

\(n=2\) 的简单情形与示例 7.2.2 一致,当时我们使用二维 LOTUS 证明了对于独立同分布的 \(U_1, U_2 \sim \text{Unif}(0,1)\): \[ E(\max(U_1, U_2)) = 2/3, \quad E(\min(U_1, U_2)) = 1/3 \]

既然我们现在知道 \(\max(U_1, U_2)\) 和 \(\min(U_1, U_2)\) 服从贝塔分布,贝塔分布的期望公式验证了我们之前的发现。

8.7 小结

在本章中,我们讨论了三大类变换:

- 连续随机向量的可逆变换 \(Y = g(X)\):可以在满足某些技术假设(最显著的是偏导数 \(\partial x_i / \partial y_j\) 存在且连续)的情况下,使用变量代换公式进行处理;

- 卷积:我们可以使用(按偏好程度递减排序)故事、矩生成函数(MGF)或卷积和/卷积积分来确定其分布;

- 独立同分布连续随机变量向其次序统计量的变换。

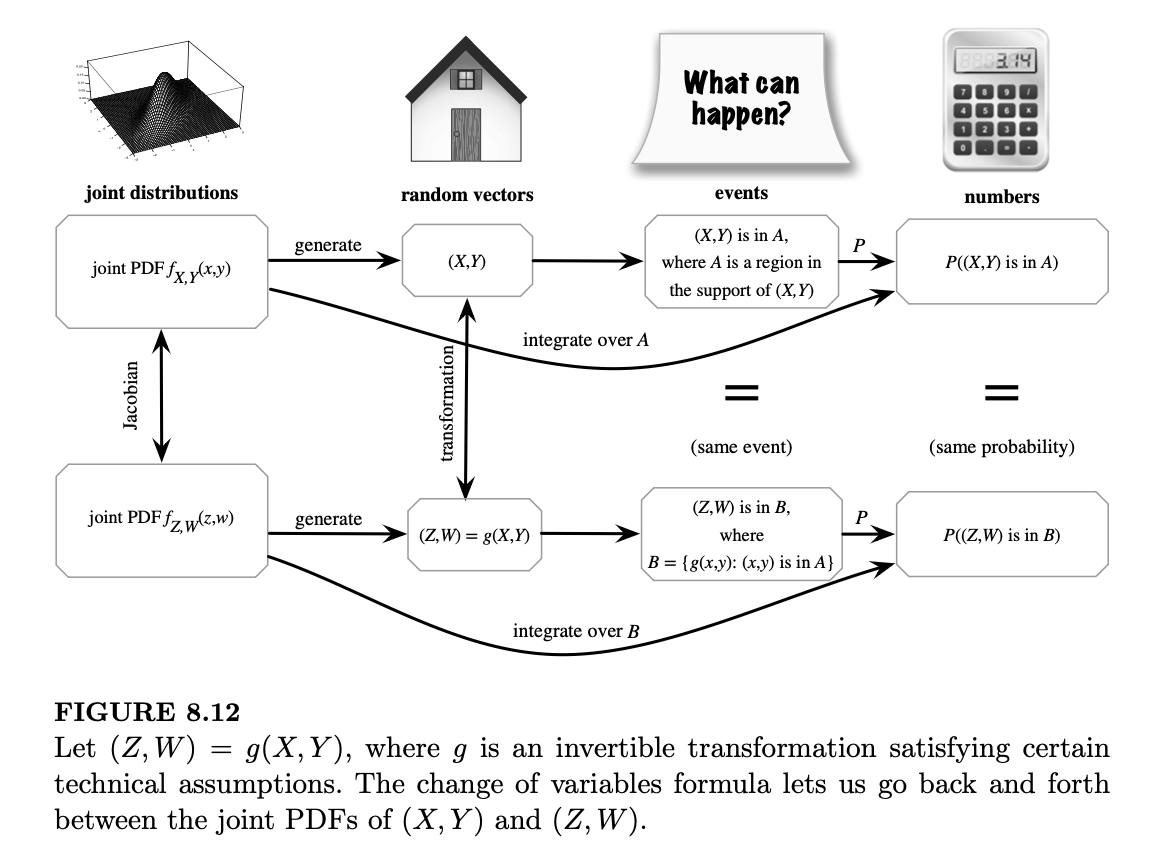

图 8.12 展示了原始随机向量 \((X, Y)\) 与变换后的随机向量 \((Z, W) = g(X, Y)\) 之间的联系,其中 \(g\) 是满足某些技术假设的可逆变换。变量代换公式使用雅可比行列式(Jacobians)让我们在 \((X, Y)\) 的联合 PDF 与 \((Z, W)\) 的联合 PDF 之间来回转换。

设 \(A\) 是 \((X, Y)\) 支撑集中的一个区域,\(B = \{g(x, y) : (x, y) \in A\}\) 是 \((Z, W)\) 支撑集中对应的区域。那么 \((X, Y) \in A\) 与 \((Z, W) \in B\) 是同一个事件,因此: \[ P((X, Y) \in A) = P((Z, W) \in B) \]

为了求这个概率,我们既可以将 \((X, Y)\) 的联合 PDF 在 \(A\) 上进行积分,也可以将 \((Z, W)\) 的联合 PDF 在 \(B\) 上进行积分。

在本章以及其他许多章节中,我们广泛使用了贝叶斯法则和全概率公式(LOTP),特别是它们的连续形式或混合形式。我们还经常使用“通过模式识别进行积分”的策略。由于任何有效的 PDF 的积分必须为 1,而现在我们已经知道了很多有效的 PDF,因此我们经常可以利用概率论来辅助计算微积分,而不仅仅是利用微积分来辅助计算概率!

我们引入的两种新分布是贝塔分布(Beta)和伽马分布(Gamma),它们充满了故事以及与其他分布的联系。

贝塔分布是 \(\text{Unif}(0, 1)\) 分布的推广,它具有以下故事:

- 均匀分布的次序统计量:\(n\) 个独立同分布的 \(\text{Unif}(0, 1)\) 随机变量的第 \(j\) 个次序统计量服从 \(\text{Beta}(j, n-j+1)\)。

- 未知概率,二项分布的共轭先验:如果 \(p \sim \text{Beta}(a, b)\) 且 \(X|p \sim \text{Bin}(n, p)\),那么 \(p|X=k \sim \text{Beta}(a+k, b+n-k)\)。在根据二项分布数据进行更新后,\(p\) 的后验分布仍保持在贝塔分布族中,这一性质称为共轭性。参数 \(a\) 和 \(b\) 分别可以解释为先验的成功次数和失败次数。

伽马分布是指数分布的推广,它具有以下故事:

- 泊松过程:在速率为 \(\lambda\) 的泊松过程中,\(n\) 次到达的总等待时间服从 \(\text{Gamma}(n, \lambda)\)。因此,伽马分布是负二项分布的连续模拟。

- 未知速率,泊松分布的共轭先验:如果 \(\lambda \sim \text{Gamma}(r_0, b_0)\) 且 \(Y|\lambda \sim \text{Pois}(\lambda t)\),那么 \(\lambda|Y=y \sim \text{Gamma}(r_0+y, b_0+t)\)。在根据泊松分布数据进行更新后,\(\lambda\) 的后验分布仍然保持在伽马分布族中。参数 \(r_0\) 和 \(b_0\) 分别可以解释为先验观测到的成功次数和这些成功所需的总等待时间。

贝塔分布和伽马分布通过“银行-邮局”故事联系在一起,该故事指出:如果 \(X \sim \text{Gamma}(a, \lambda)\) 和 \(Y \sim \text{Gamma}(b, \lambda)\) 是相互独立的,那么 \(X+Y \sim \text{Gamma}(a+b, \lambda)\),\(\frac{X}{X+Y} \sim \text{Beta}(a, b)\),且 \(X+Y\) 与 \(\frac{X}{X+Y}\) 相互独立。

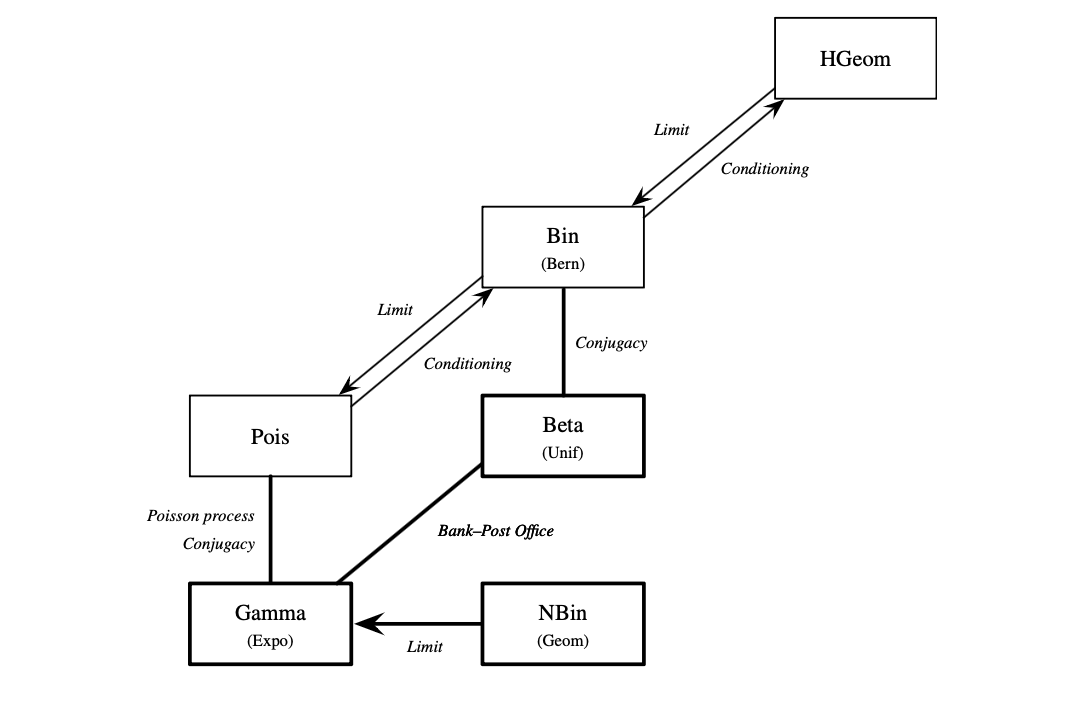

我们在第 5 章中最后见到的分布联系图在此处进行了更新,将贝塔分布和伽马分布包含在内。括号中列出的分布是括号外分布的特例。

8.8 R 语言实现

贝塔分布与伽马分布

贝塔分布和伽马分布已内置在 R 中。

- dbeta, pbeta, rbeta:要在 \(x\) 处计算 \(\text{Beta}(a,b)\) 的 PDF 或 CDF,我们使用

dbeta(x,a,b)和pbeta(x,a,b)。要从 \(\text{Beta}(a,b)\) 分布中生成 \(n\) 个实现值,我们使用rbeta(n,a,b)。 - dgamma, pgamma, rgamma:要在 \(x\)处计算 \(\text{Gamma}(a,\lambda)\) 的 PDF 或 CDF,我们使用

dgamma(x,a,lambda)或pgamma(x,a,lambda)。要从 \(\text{Gamma}(a,\lambda)\) 分布中生成 \(n\) 个实现值,我们使用rgamma(n,a,lambda)。

例如,我们可以验证 \(\text{Gamma}(3,2)\) 分布的均值为 \(3/2\),方差为 \(3/4\)。为此,我们使用 rgamma 生成大量的 \(\text{Gamma}(3,2)\) 随机变量,然后计算它们的均值和方差:

R

1 | y <- rgamma(10^5,3,2) |

你得到的数值是否分别接近 1.5 和 0.75?

均匀分布的卷积

使用 R,我们可以快速验证:对于独立同分布的 \(X, Y \sim \text{Unif}(0,1)\),\(T = X + Y\) 的分布呈现三角形:

R

1 | x <- runif(10^5) |

直方图看起来像先上升后下降的阶梯,这是对三角形的离散逼近。

贝叶斯台球

在贝叶斯台球的故事中,我们有 \(n\) 个白球和 1 个灰球,将它们完全随机地投掷到单位区间上,并计算灰球左侧的白球数量。令 \(p\) 为灰球的位置,\(X\) 为灰球左侧的白球数量,我们有: \[ p \sim \text{Unif}(0,1) \] \[ X|p \sim \text{Bin}(n,p) \]

通过进行大量次数的实验,我们可以验证本章推导出的关于 \(X\) 的边缘 PMF 和给定 \(X=x\) 时 \(p\) 的后验 PDF 的结果。我们将模拟次数称为 nsim,以避免与白球数量 \(n\)(我们将其设为 10)发生名称冲突:

R

1 | nsim <- 10^5 |

我们模拟 \(10^5\) 个 \(p\) 的值,然后从给定 \(p\) 的 \(X\) 的条件分布中模拟 \(10^5\) 个值:

R

1 | p <- runif(nsim) |

注意我们将整个向量 p 传入了 rbinom。这意味着 x 的第一个元素是使用 p 的第一个元素生成的,x 的第二个元素是使用 p 的第二个元素生成的,依此类推。因此,以 p 的特定元素为条件,x 的对应元素服从二项分布,而 p 的元素本身服从均匀分布,这完全符合模型的设定。

根据贝叶斯台球的论证,\(X\) 的边缘分布应该是整数 \(0\) 到 \(n\) 上的离散均匀分布。事实是否确实如此?我们可以制作 x 的直方图来检查!由于 \(X\) 的分布是离散的,我们让 R 在 \(-0.5, 0.5, 1.5, \dots\) 处设置直方图分界点,以便每个条形都以整数值为中心:

R

1 | hist(x,breaks=seq(-0.5,n+0.5,1)) |

确实,所有直方图条形的高度大致相等,这与离散均匀分布一致。

现在来看给定 \(X=x\) 时 \(p\) 的后验分布。在 R 中进行条件筛选非常简单。为了仅考虑 \(X\) 值为 3 时模拟的 \(p\) 值,我们使用方括号,像这样:p[x==3]。特别地,我们可以为这些值创建一个直方图,看看给定 \(X=3\) 时 \(p\) 的后验分布长什么样;尝试输入 hist(p[x==3])。

根据贝塔-二项共轭性结果,真实的后验分布是 \(p|X=3 \sim \text{Beta}(4,8)\)。我们可以将 p[x==3] 的直方图与 \(\text{Beta}(4,8)\) 分布模拟值的直方图并排绘制,以确认它们看起来很相似:

R

1 | par(mfrow=c(1,2)) |

第一行代码告诉 R 我们想要两个并排的图,第二行和第三行创建直方图。

模拟次序统计量

在 R 中模拟次序统计量很简单:我们只需模拟独立同分布的随机变量,并使用 sort 对它们进行升序排列。例如:

R

1 | sort(rnorm(10)) |

会产生 \(X_{(1)}, \dots, X_{(10)}\) 的一次实现,其中 \(X_1, \dots, X_{10}\) 是独立同分布的 \(N(0,1)\)。

如果我们想绘制例如 \(X_{(9)}\) 的实现值的直方图,我们需要使用 replicate:

R

1 | order_stats <- replicate(10^4, sort(rnorm(10))) |

这创建了一个有 10 行的矩阵 order_stats。矩阵的第 \(i\) 行包含 \(X_{(i)}\) 的 \(10^4\) 个实现值。现在我们可以通过选择矩阵的第 9 行来创建 \(X_{(9)}\) 的直方图:

R

1 | x9 <- order_stats[9,] |

我们还可以计算均值 mean(x9) 和方差 var(x9) 等汇总统计量。

书籍各章的机翻md文件:

《Introduction to Probability》前言

《Introduction to Probability》第1章 概率与计数

《Introduction to Probability》第 2 章 条件概率

《Introduction to Probability》第3章 随机变量及其分布

《Introduction to Probability》第4章 期望

《Introduction to Probability》第5章 连续随机变量

《Introduction to Probability》第 6 章 矩

《Introduction to Probability》第7 章 联合分布

《Introduction to Probability》第8章 变换

《Introduction to Probability》第9章 条件期望

《Introduction to Probability》第10章 不等式与极限理论

《Introduction to Probability》第11章 马尔可夫链

《Introduction to Probability》第12章 马尔可夫链蒙特卡罗

《Introduction to Probability》第13章 泊松过程