《Introduction to Probability》第 6 章 矩

第 6 章 矩

Moments

随机变量 \(X\) 的第 \(n\) 阶矩是 \(E(X^n)\)。在本章中,我们将探讨随机变量的矩如何揭示其分布的特征。我们已经看到前两阶矩非常有用,因为它们提供了均值 \(E(X)\) 和方差 \(E(X^2) - (EX)^2\),这些是关于 \(X\) 的平均值及其分布离散程度的重要汇总信息。但分布的含义远不止于其均值和方差。

我们将看到,第三阶和第四阶矩告诉我们分布的非对称性以及尾部或极端值的行为,这两个性质是均值和方差无法捕捉到的。在介绍矩之后,我们将讨论矩生成函数 (MGF),它不仅能帮助我们计算矩,还提供了一种有用的替代方法来指定一个分布。

6.1 分布的汇总信息

Summaries of a distribution

均值被称为中心趋势 (central tendency) 的一种度量,因为它告诉我们关于分布中心的一些信息,特别是其质量中心。统计学中常用的其他中心趋势度量包括中位数和众数,我们现在给出它们的定义。

定义 6.1.1(中位数):如果随机变量 \(X\) 满足 \(P(X \leq c) \geq 1/2\) 且 \(P(X \geq c) \geq 1/2\),我们称 \(c\) 是 \(X\) 的一个中位数 (median)。(最简单的情况是 \(X\) 的 CDF 在 \(c\) 处恰好达到 1/2,但我们知道有些 CDF 存在跳变。)

定义 6.1.2(众数):对于离散随机变量 \(X\),如果 \(c\) 使 PMF 达到最大值,即对所有 \(x\) 都有 \(P(X = c) \geq P(X = x)\),则称 \(c\) 是 \(X\) 的一个众数 (mode)。对于具有 PDF \(f\) 的连续随机变量 \(X\),如果 \(c\) 使 PDF 达到最大值,即对所有 \(x\) 都有 \(f(c) \geq f(x)\),则称 \(c\) 是众数。

与均值一样,随机变量的中位数和众数仅取决于其分布,因此我们可以讨论一个分布的均值、中位数或众数,而无需指代具有该分布的任何特定随机变量。例如,如果 \(Z \sim N(0,1)\),那么 \(Z\) 的中位数是 0(因为由对称性可知 \(\Phi(0) = 1/2\)),我们也说标准正态分布的中位数是 0。

直观地看,中位数是一个值 \(c\),使得分布的一半质量落在 \(c\) 的任一侧(对于离散随机变量,则尽可能接近一半);而众数是在 \(X\) 的支撑集中具有最大质量或密度的值。如果 CDF \(F\) 是一个连续且严格单调递增的函数,那么 \(F^{-1}(1/2)\) 就是中位数(且是唯一的)。

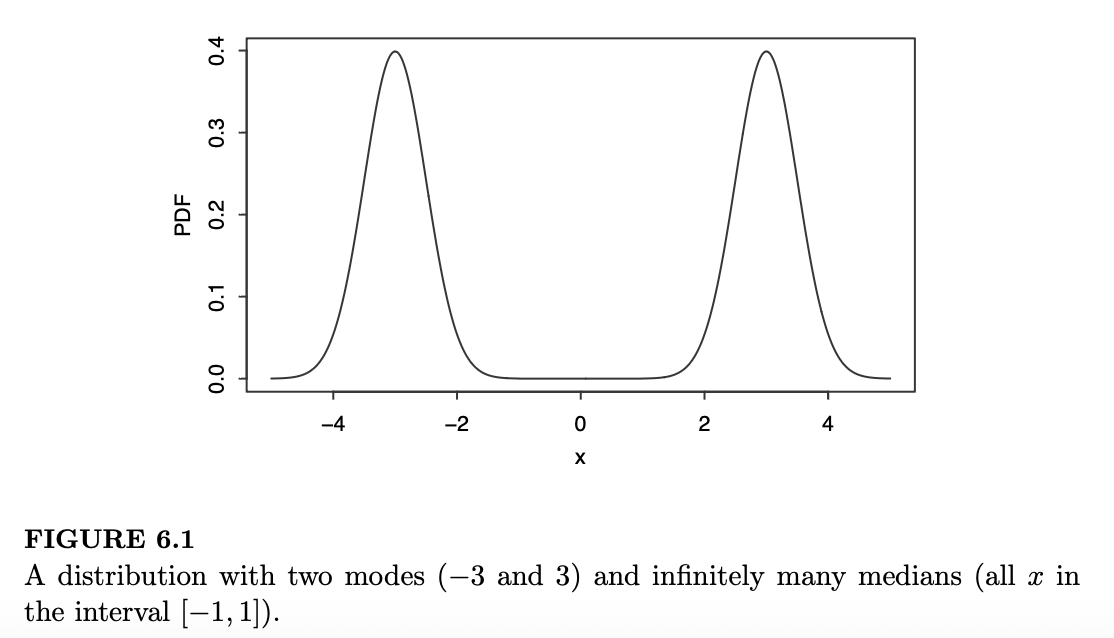

注意,一个分布可以有多个中位数和多个众数。中位数必须并排出现;而众数可以出现在分布的各个位置。在图 6.1 中,我们展示了一个支撑在 \([-5, -1] \cup [1, 5]\) 上的分布,它有两个众数和无限多个中位数。在 \(-1\) 和 \(1\) 之间 PDF 为 0,因此 \(-1\) 到 \(1\) 之间的所有值都是该分布的中位数,因为一半的质量落在每一侧。两个众数分别位于 \(-3\) 和 \(3\)。

例 6.1.3(薪资的均值、中位数和众数)。某公司有 100 名员工。令 \(s_1, s_2, \dots, s_{100}\) 为他们的薪资,按递增顺序排列(即使有些薪资出现多次也可以这样排序)。令 \(X\) 为随机选择的一名员工(均匀随机选择)的薪资。该数据集 \(s_1, s_2, \dots, s_{100}\) 的均值、中位数和众数被定义为 \(X\) 的对应指标。

什么是“典型”的薪资?薪资数据中最有用的单一数字汇总是什么?答案通常取决于目标。不同的汇总指标揭示了数据的不同特征,因此很难只选一个数字——而且通常也没必要,因为我们通常可以提供多个汇总指标(并绘制数据图表)。在此我们简要比较均值、中位数和众数,尽管通常同时报告三者(及其他汇总指标)更有意义。

如果所有薪资都互不相同,众数就不是一个有用的总结指标,因为会有 100 个众数。如果公司里只有几种可能的薪资水平,众数会变得更有用。但即便如此,也可能出现例如:34 人领取薪资 \(a\),33 人领取 \(b\),33 人领取 \(c\)。此时 \(a\) 是唯一的众数,但如果只报告 \(a\),我们就忽略了 \(b\) 和 \(c\),它们仅以微小差距落选众数,且两者合计占了数据的近 2/3。

接下来考虑中位数。此时有两名员工在“中间位置”,即 \(s_{50}\) 和 \(s_{51}\)。事实上,任何满足 \(s_{50} \leq m \leq s_{51}\) 的数字 \(m\) 都是中位数,因为随机员工的薪资在 \(\{s_1, \dots, s_{50}\}\) 集合中(此时不大于 \(m\))的概率至少为 50%,且在 \(\{s_{51}, \dots, s_{100}\}\) 集合中(此时不小于 \(m\))的概率也至少为 50%。通常的惯例是选择 \(m = (s_{50} + s_{51})/2\),即中间两个数的平均值。如果员工人数是奇数,就不会出现这个问题;那种情况下存在唯一的中位数,即薪资按递增顺序排列时正中间的那个数。

与均值相比,中位数对极端值(离群值)的敏感度要低得多。例如,如果 CEO 的薪资从比其他人稍微多一点变为比其他人多出极多,这可能会对均值产生巨大影响,但对中位数没有影响。这种稳健性(robustness)是中位数在描述“典型”薪资时可能比均值更合理的原因。另一方面,假设我们想知道公司支付员工薪资的总成本,如果我们只知道众数或中位数,无法提取此信息;但如果我们知道均值,只需将其乘以 100 即可。

假设我们试图通过给出一个预测值 \(c\) 来猜测一个尚未观测到的随机变量 \(X\)。均值和中位数似乎都是 \(c\) 的自然选择,但哪个更好呢?这取决于如何定义“更好”。评价 \(c\) 好坏的两种自然方式是均方误差 \(E(X-c)^2\) 和平均绝对误差 \(E|X-c|\)。以下结论说明了在这两种情况下的最佳猜测分别是什么。

定理 6.1.4。令 \(X\) 为一个期望为 \(\mu\) 的随机变量,令 \(m\) 为 \(X\) 的一个中位数。

• 使均方误差 \(E(X-c)^2\) 最小化的 \(c\) 值为 \(c = \mu\)。

• 使平均绝对误差 \(E|X-c|\) 最小化的 \(c\) 值为 \(c = m\)。

证明。我们首先证明一个有用的恒等式: \[ E(X-c)^2 = \text{Var}(X) + (\mu-c)^2 \]

这可以通过展开所有项来验证,但更快捷的方法是利用“加上一个常数不影响方差”这一事实: \[ \text{Var}(X) = \text{Var}(X-c) = E(X-c)^2 - (E(X-c))^2 = E(X-c)^2 - (\mu-c)^2 \]

由此可见,\(c = \mu\) 是使 \(E(X-c)^2\) 最小化的唯一选择,因为该选择使得 \((\mu-c)^2 = 0\),而任何其他选择都会使 \((\mu-c)^2 > 0\)。

接下来,让我们考虑平均绝对误差。令 \(a \neq m\)。我们需要证明 \(E|X-m| \leq E|X-a|\),这等价于 \(E(|X-a| - |X-m|) \geq 0\)。假设 \(m < a\)(\(m > a\) 的情况可以用类似方法处理)。如果 \(X \leq m\),那么: \[ |X-a| - |X-m| = a-X - (m-X) = a-m \]

如果 \(X > m\),那么: \[ |X-a| - |X-m| \geq X-a - (X-m) = m-a \]

令 \(Y = |X-a| - |X-m|\)。我们可以利用指示随机变量,根据 \(X \leq m\) 是否发生将 \(E(Y)\) 的定义分为两部分。令 \(I\) 为 \(X \leq m\) 的指示随机变量,则 \(1-I\) 为 \(X > m\) 的指示随机变量。那么: \[ E(Y) = E(YI) + E(Y(1-I)) \]

\[ \geq (a-m)E(I) + (m-a)E(1-I) \]

\[ = (a-m)P(X \leq m) + (m-a)P(X > m) \]

\[ = (a-m)P(X \leq m) - (a-m)(1 - P(X \leq m)) \]

\[ = (a-m)(2P(X \leq m) - 1) \]

根据中位数的定义,我们有 \(2P(X \leq m) - 1 \geq 0\)。因此,\(E(Y) \geq 0\),这意味着 \(E|X-m| \leq E|X-a|\)。

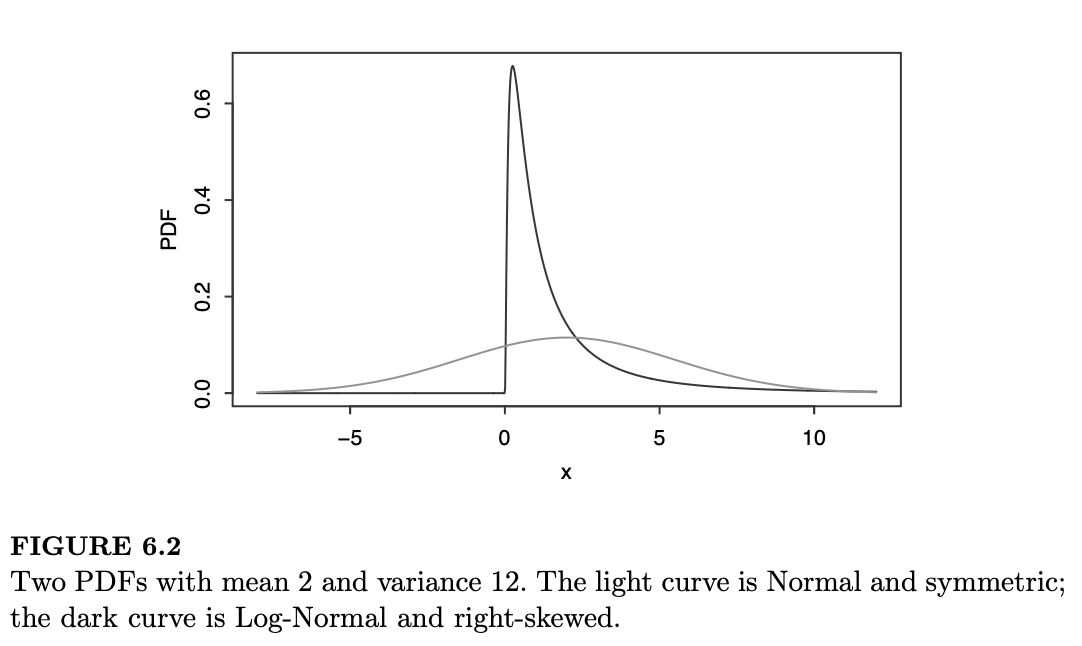

无论我们在特定应用中使用哪种集中趋势的度量,了解分布的离散程度(例如通过方差衡量)通常也很重要。然而,分布还有一些主要特征是均值和方差无法捕捉到的。例如,图 6.2 中的两条概率密度函数(PDF)曲线的均值均为 2,方差均为 12。浅色曲线是 \(N(2, 12)\) 的 PDF,深色曲线属于对数正态(Log-Normal)分布族(对数正态分布将在本章稍后部分定义)。正态曲线关于 2 对称,因此其均值、中位数和众数均为 2。相比之下,对数正态分布严重右偏;这意味着与其左尾相比,其右尾非常长。它的均值为 2,但中位数为 1,众数为 0.25。仅凭均值和方差,我们将无法捕捉到对数正态分布的非对称性与正态分布的对称性之间的区别。

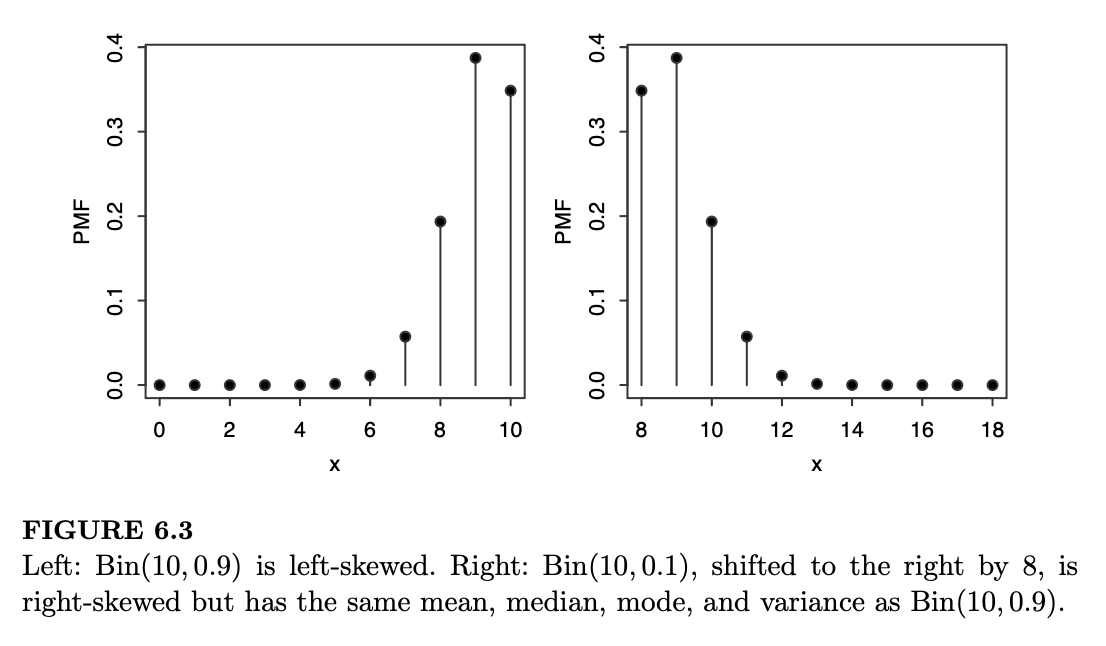

现在请看图 6.3,左侧显示的是 \(Bin(10, 0.9)\) 随机变量的 PMF,右侧显示的是 \(8\) 加上一个 \(Bin(10, 0.1)\) 随机变量的 PMF。这两个分布的均值、中位数和众数都等于 9,方差都等于 0.9,但它们看起来截然不同。我们称左侧的 PMF 为左偏(left-skewed),右侧的 PMF 为右偏(right-skewed)。在本章中,我们将学习衡量分布不对称性的标准度量是基于三阶矩的。

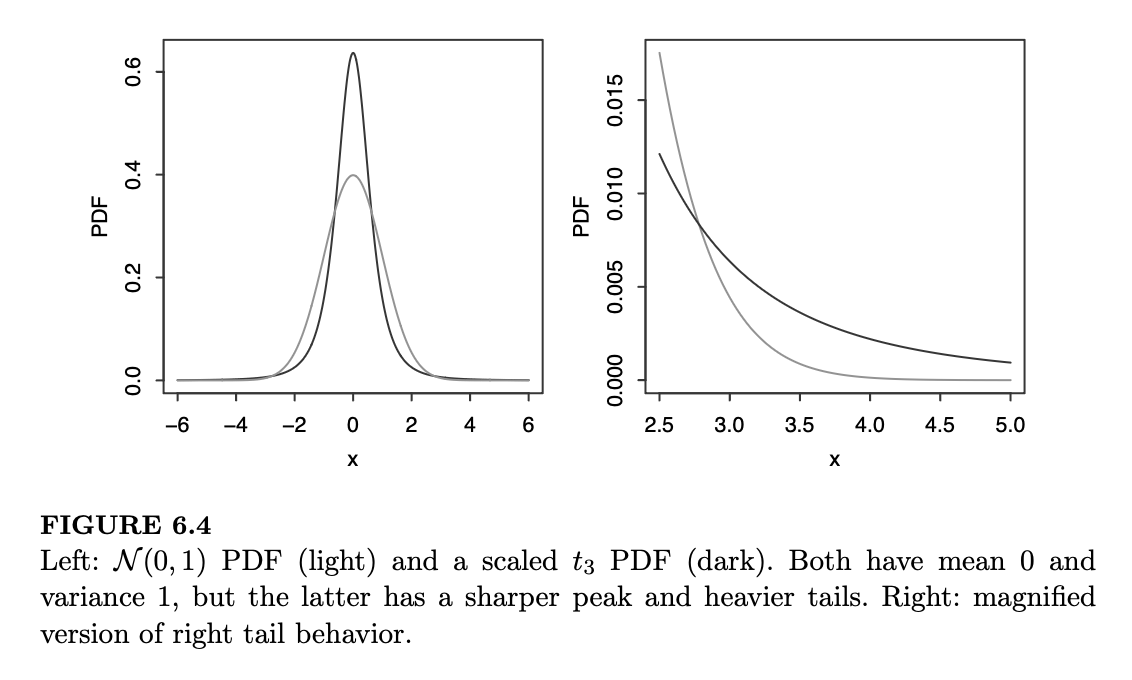

前两个例子考虑了不对称分布,但具有相同均值和方差的对称分布看起来也可以非常不同。图 6.4 的左图显示了两个均值为 0、方差为 1 的对称 PDF。浅色曲线是 \(N(0, 1)\) 的 PDF,深色曲线是 \(t_3\) 的 PDF(将其缩放至方差为 1,我们将在第 10 章定义 \(t_3\) 分布)。深色曲线比浅色曲线具有更尖的峰和更厚的尾部。尾部行为在右图中被放大,从中可以很容易地看出深色曲线衰减到 0 的速度要慢得多,这使得尾部远端的观测值比浅色曲线更有可能出现。正如我们将在本章学到的,衡量分布尾部厚度的标准度量是基于四阶矩的。

在下一节中,我们将进一步详细探讨如何解释矩,特别是前四阶矩。

6.2 矩的解释

Interpreting moments

定义 6.2.1(矩的种类)。令 \(X\) 为均值为 \(\mu\)、方差为 \(\sigma^2\) 的随机变量。对于任何正整数 \(n\),\(X\) 的第 \(n\) 阶矩为 \(E(X^n)\),第 \(n\) 阶中心矩为 \(E((X-\mu)^n)\),第 \(n\) 阶标准化矩为 \(E\left(\left(\frac{X-\mu}{\sigma}\right)^n\right)\)。在上述句子中,“如果存在”这一条件是隐含的。

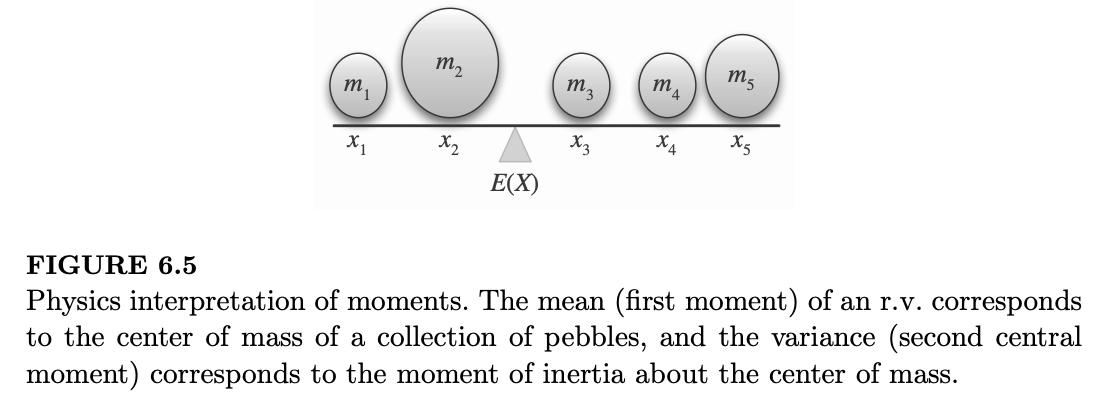

特别地,均值是一阶矩,方差是二阶中心矩。“矩”(moment)一词借用自物理学。设 \(X\) 是一个离散随机变量,其可能的取值为互不相同的 \(x_1, \dots, x_n\),想象在数轴上的每个 \(x_j\) 处放置一个质量为 \(m_j = P(X = x_j)\) 的小球(如图 6.5 所示)。在物理学中: \[ E(X) = \sum_{j=1}^n m_j x_j \]

被称为系统的质心(center of mass),而 \[ \text{Var}(X) = \sum_{j=1}^n m_j (x_j - E(X))^2 \]

被称为关于质心的转动惯量(moment of inertia)。

现在我们将定义偏度(skewness),它是衡量不对称性的单数值总结,如前所述,它是基于三阶矩的。事实上,偏度被定义为三阶标准化矩。

定义 6.2.2(偏度)。均值为 \(\mu\)、方差为 \(\sigma^2\) 的随机变量 \(X\) 的偏度是 \(X\) 的三阶标准化矩: \[ \text{Skew}(X) = E\left[\left(\frac{X-\mu}{\sigma}\right)^3\right] \]

通过先进行标准化,我们使得 \(\text{Skew}(X)\) 的定义不依赖于 \(X\) 的位置或尺度,这是合理的,因为我们已经有了 \(\mu\) 和 \(\sigma\) 来提供关于位置和尺度的信息。此外,先进行标准化带来了一个很好的性质:测量 \(X\) 的单位(例如英寸与米)不会影响偏度。

为了理解偏度如何衡量不对称性,我们首先需要讨论随机变量对称意味着什么。

定义 6.2.3(随机变量的对称性)。如果 \(X-\mu\) 与 \(\mu-X\) 具有相同的分布,我们称随机变量 \(X\) 关于 \(\mu\) 具有对称分布。我们也称 \(X\) 是对称的,或者称 \(X\) 的分布是对称的;这些表达含义相同。

上述定义中的数值 \(\mu\) 在均值存在的情况下必须等于 \(E(X)\),因为将 \(E(X)-\mu = E(X-\mu) = E(\mu-X) = \mu-E(X)\) 简化可得 \(E(X) = \mu\)。因此,通常将“\(X\) 关于其均值对称”(如果均值存在)简称为“\(X\) 是对称的”。数值 \(\mu\) 也是该分布的中位数,因为如果 \(X-\mu\) 与 \(\mu-X\) 同分布,则: \[ P(X-\mu \leq 0) = P(\mu-X \leq 0) \]

因此 \[ P(X \leq \mu) = P(X \geq \mu) \]

这意味着 \[ P(X \leq \mu) = 1 - P(X > \mu) \geq 1 - P(X \geq \mu) = 1 - P(X \leq \mu) \]

从而证明 \(P(X \leq \mu) \geq 1/2\) 且 \(P(X \geq \mu) \geq 1/2\)。

6.2.4。有时人们说“\(X\) 是对称的”是指“\(X\) 关于 0 对称”。注意,如果 \(X\) 关于 \(\mu\) 对称,那么 \(X-\mu\) 就关于 0 对称。关于 0 对称特别方便,因为此时 \(-X\) 和 \(X\) 具有相同的分布,且 \(X\) 的 PDF(如果 \(X\) 是连续的)是一个偶函数,如下所示。直观地说,对称意味着对于连续型 \(X\),\(\mu\) 左侧的 PDF 是其右侧 PDF 的镜像(对于离散型 \(X\),其 PMF 也是如此)。例如,我们之前已经看到 \(X \sim N(\mu, \sigma^2)\) 是对称的;根据定义,这是因为 \(X-\mu\) 和 \(\mu-X\) 都是 \(N(0, \sigma^2)\)。我们还从推论 3.3.8 中看到,当 \(p=1/2\) 时,\(X \sim Bin(n, p)\) 是对称的。

我们也可以对对称连续随机变量的 PDF 形式给出代数描述。

命题 6.2.5(用 PDF 表达对称性)。令 \(X\) 为具有 PDF \(f\) 的连续随机变量。那么 \(X\) 关于 \(\mu\) 对称当且仅当对于所有 \(x\),\(f(x) = f(2\mu - x)\)。

证明。令 \(F\) 为 \(X\) 的 CDF。如果对称性成立,我们有: \[ F(x) = P(X-\mu \leq x-\mu) = P(\mu-X \leq x-\mu) = P(X \geq 2\mu - x) = 1 - F(2\mu - x) \]

对两边求导得 \(f(x) = f(2\mu - x)\)。反之,假设对于所有 \(x\),\(f(x) = f(2\mu - x)\) 成立。对两边积分,我们有: \[ P(X-\mu \leq t) = P(X \leq \mu+t) = \int_{-\infty}^{\mu+t} f(x) dx = \int_{-\infty}^{\mu+t} f(2\mu-x) dx \]

通过代换 \(w = 2\mu-x\),上式变为: \[ \int_{\mu-t}^{\infty} f(w) dw = P(X \geq \mu-t) = P(\mu-X \leq t) \]

奇阶中心矩提供了一些关于对称性的信息。

命题 6.2.6(对称分布的奇阶中心矩)。令 \(X\) 关于其均值 \(\mu\) 对称。那么对于任何奇数 \(m\),\(X\) 的第 \(m\) 阶中心矩 \(E(X-\mu)^m\)(如果存在)为 0。

证明。由于 \(X-\mu\) 与 \(\mu-X\) 具有相同的分布,它们具有相同的第 \(m\) 阶矩(如果存在): \[ E(X-\mu)^m = E(\mu-X)^m \]

令 \(Y = (X-\mu)^m\)。那么 \((\mu-X)^m = (-(X-\mu))^m = (-1)^m Y = -Y\),所以上述等式即为 \(E(Y) = -E(Y)\)。因此 \(E(Y) = 0\)。

这引导我们考虑使用奇阶标准化矩作为分布偏斜程度的度量。一阶标准化矩总是 0,因此三阶标准化矩被用作偏度的定义。正偏度表示相对于左尾具有较长的右尾,负偏度则表示相反的情况。(然而,上述命题的逆命题是错误的:存在一些奇阶中心矩全为 0 的不对称分布。)

为什么不使用五阶标准化矩来代替三阶呢?原因之一是三阶标准化矩通常更容易计算。另一个原因是,我们可能需要从数据集估计偏度。通常情况下,稳定地估计低阶矩比高阶矩更容易,因为例如一个巨大的、带有噪声的观测值在进行五次方运算后会产生极大且噪声极大的结果。尽管如此,正如均值不是唯一的平均值概念,方差也不是唯一的离散度概念一样,三阶标准化矩也不是偏度的唯一有用概念。

分布的另一个重要描述性特征是其尾部的厚度(heavy tails)。对于给定的方差,变异性更多是由少数罕见(极端)事件解释,还是由中等数量的中等偏差解释?这是金融风险管理中的一个重要考量:对于许多金融资产,收益率分布由于罕见但严重的危机事件而具有深厚的左尾,如果不考虑这些罕见事件,可能会产生灾难性的后果,2008 年的金融危机就证明了这一点。

与衡量偏度一样,没有单一的度量可以完美地捕捉尾部行为,但有一种基于四阶标准化矩的广泛使用的总结指标。

定义 6.2.7(峰度)。均值为 \(\mu\)、方差为 \(\sigma^2\) 的随机变量 \(X\) 的峰度是 \(X\) 的四阶标准化矩的平移版本: \[ \text{Kurt}(X) = E\left[\left(\frac{X-\mu}{\sigma}\right)^4\right] - 3 \]

6.2.8。减去 3 的原因是为了使任何正态分布的峰度都为 0(如 6.5 节所示)。这提供了一个方便的比较基准。然而,某些来源在定义峰度时不减去 3,在这种情况下,他们将我们的版本称为“超额峰度”(excess kurtosis)。

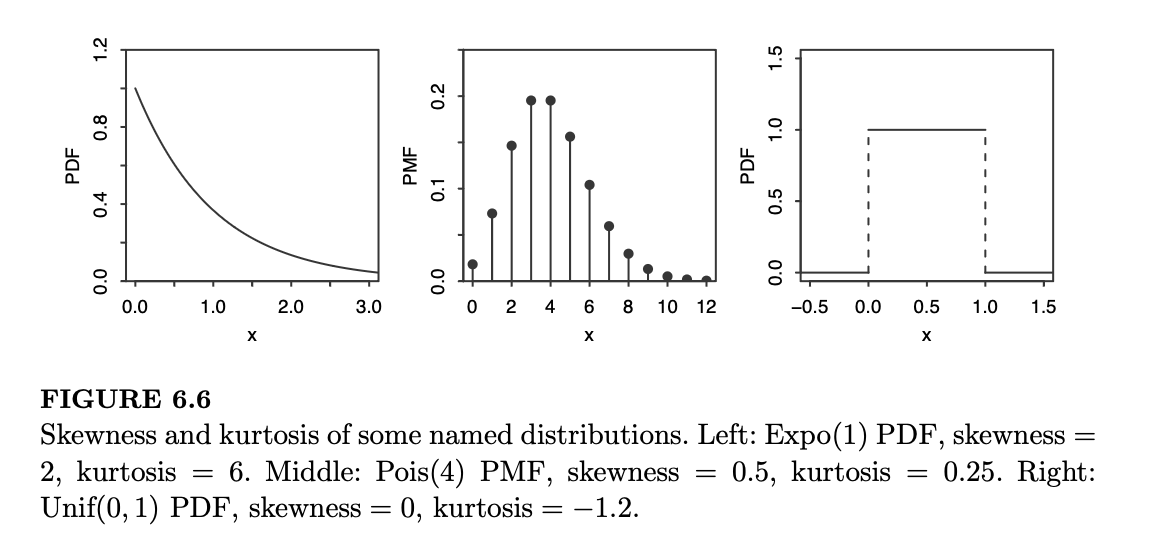

图 6.6 显示了三个已命名的分布,并列出了每个分布的偏度和峰度。\(Expo(1)\) 和 \(Pois(4)\) 分布(左侧和中间)都具有正偏度和正峰度,表明它们是右偏的,且它们的尾部比正态分布的尾部更厚。\(Unif(0, 1)\) 分布(右侧)具有零偏度和负峰度:零偏度是因为该分布关于其均值对称,而负峰度是因为它没有尾部!

6.3 样本矩

Sample moments

在统计推断中,一个核心问题是如何利用数据来估计分布的未知参数或未知参数的函数。想要估计一个分布的均值和方差尤为常见。如果数据是独立同分布(i.i.d.)的随机变量 \(X_1, \dots, X_n\),且其均值 \(E(X_j)\) 未知,那么估计均值最显而易见的方法就是简单地对 \(X_j\) 求平均,即计算算术平均值。

例如,如果观测到的数据是 \(3, 1, 1, 5\),那么估计生成这些数据的分布均值的一种简单且自然的方法是使用 \((3+1+1+5)/4 = 2.5\)。这被称为样本均值。类似地,如果我们想估计生成数据 \(3, 1, 1, 5\) 的分布的二阶矩,一种简单自然的方法是使用 \((3^2 + 1^2 + 1^2 + 5^2)/4 = 9\)。这被称为样本二阶矩。通常情况下,样本矩的定义如下。

定义 6.3.1(样本矩)。令 \(X_1, \dots, X_n\) 为独立同分布的随机变量。第 \(k\) 阶样本矩是随机变量 \[ M_k = \frac{1}{n} \sum_{j=1}^n X_j^k \]

样本均值 \(\bar{X}_n\) 是第一阶样本矩: \[ \bar{X}_n = \frac{1}{n} \sum_{j=1}^n X_j \]

相比之下,总体均值(population mean)或真实均值是 \(E(X_j)\),即抽取 \(X_j\) 的分布的均值。

个人注:在统计学中,“样本”通常指代你抽取的整组观察对象(即 \(\{X_1, X_2, \dots, X_n\}\) 这个序列)

我们在第 10 章证明的大数定律表明,当 \(n \to \infty\) 时,独立同分布随机变量 \(X_1, \dots, X_n\) 的第 \(k\) 阶样本矩收敛于第 \(k\) 阶矩 \(E(X_1^k)\)。此外,第 \(k\) 阶样本矩的期望值就是第 \(k\) 阶矩。用统计学术语来说,我们称第 \(k\) 阶样本矩是估计第 \(k\) 阶矩的无偏估计量。通过线性性质可以很容易地验证这一点: \[ E\left( \frac{1}{n} \sum_{j=1}^n X_j^k \right) = \frac{1}{n} [E(X_1^k) + \dots + E(X_n^k)] = E(X_1^k) \]

样本均值的均值和方差经常被用到,并且在统计学中有着非常重要的优美表达式。

定理 6.3.2(样本均值的均值和方差)。令 \(X_1, \dots, X_n\) 为独立同分布随机变量,其均值为 \(\mu\),方差为 \(\sigma^2\)。那么样本均值 \(\bar{X}_n\) 是 \(\mu\) 的无偏估计量。即: \[ E(\bar{X}_n) = \mu \]

\(\bar{X}_n\) 的方差由下式给出: \[ \text{Var}(\bar{X}_n) = \frac{\sigma^2}{n} \]

证明。我们有 \(E(\bar{X}_n) = \mu\),因为我们上面已经证明了第 \(k\) 阶样本矩是第 \(k\) 阶矩的无偏估计量。对于方差,我们将利用独立随机变量之和的方差等于方差之和这一事实(将在下一章证明): \[ \text{Var}(\bar{X}_n) = \frac{1}{n^2} \text{Var}(X_1 + \dots + X_n) = \frac{n}{n^2} \text{Var}(X_1) = \frac{\sigma^2}{n} \]

对于估计独立同分布随机变量 \(X_1, \dots, X_n\) 分布的方差,基于上述概念的一种自然方法是模仿公式 \(\text{Var}(X) = E(X^2) - (EX)^2\),即通过取样本二阶矩并减去样本均值的平方来进行估计。这种方法有其优点,但更常用的方法如下。

定义 6.3.3(样本方差与样本标准差)。令 \(X_1, \dots, X_n\) 为独立同分布随机变量。样本方差是随机变量 \[ S_n^2 = \frac{1}{n-1} \sum_{j=1}^n (X_j - \bar{X}_n)^2 \]

样本标准差是样本方差的平方根。

上述定义的思路是模仿公式 \(\text{Var}(X) = E(X - E(X))^2\),通过计算各 \(X_j\) 到样本均值的平方距离的平均值来实现,区别在于分母使用的是 \(n-1\) 而不是 \(n\)。使用 \(n-1\) 的动机在于这使得样本方差 \(S_n^2\) 成为估计 \(\sigma^2\) 的无偏估计量,即它在平均意义上是正确的。然而,样本标准差 \(S_n\) 并不是 \(\sigma\) 的无偏估计量;我们将在第 10 章看到不等式的方向。无论如何,无偏性只是评判估计程序的几个准则之一。例如,在某些问题中,我们可以通过允许一点偏误来换取更低的均方误差,而这种权衡可能是值得的。

定理 6.3.4(样本方差的无偏性)。令 \(X_1, \dots, X_n\) 为独立同分布随机变量,其均值为 \(\mu\),方差为 \(\sigma^2\)。那么样本方差 \(S_n^2\) 是 \(\sigma^2\) 的无偏估计量,即: \[ E(S_n^2) = \sigma^2 \]

个人注:无偏估计的定义!

证明。证明的关键在于一个简便的恒等式: \[ \sum_{j=1}^n (X_j - c)^2 = \sum_{j=1}^n (X_j - \bar{X}_n)^2 + n(\bar{X}_n - c)^2 \]

该式对所有的 \(c\) 都成立。为了验证这个恒等式,在左侧求和项中加上并减去 \(\bar{X}_n\): \[ \sum_{j=1}^n (X_j - c)^2 = \sum_{j=1}^n ((X_j - \bar{X}_n) + (\bar{X}_n - c))^2 \]

\[ = \sum_{j=1}^n (X_j - \bar{X}_n)^2 + 2(\bar{X}_n - c) \sum_{j=1}^n (X_j - \bar{X}_n) + \sum_{j=1}^n (\bar{X}_n - c)^2 \]

\[ = \sum_{j=1}^n (X_j - \bar{X}_n)^2 + n(\bar{X}_n - c)^2 \]

在最后一步中,我们利用了 \(\bar{X}_n - c\) 与 \(j\) 无关的事实,以及: \[ \sum_{j=1}^n (X_j - \bar{X}_n) = \sum_{j=1}^n X_j - \sum_{j=1}^n \bar{X}_n = n\bar{X}_n - n\bar{X}_n = 0 \]

现在让我们应用该恒等式,选择 \(c = \mu\)。对等式两边取期望: \[ n E(X_1 - \mu)^2 = E\left( \sum_{j=1}^n (X_j - \bar{X}_n)^2 \right) + n E(\bar{X}_n - \mu)^2 \]

根据方差的定义,\(E(X_1 - \mu)^2 = \text{Var}(X_1) = \sigma^2\),且 \(E(\bar{X}_n - \mu)^2 = \text{Var}(\bar{X}_n) = \sigma^2/n\)。将这些结果代入上式并化简,我们得到 \(E(S_n^2) = \sigma^2\)。

类似地,我们可以将样本偏度定义为 \[ \frac{\frac{1}{n} \sum_{j=1}^n (X_j - \bar{X}_n)^3}{S_n^3} \]

将样本峰度定义为 \[ \frac{\frac{1}{n} \sum_{j=1}^n (X_j - \bar{X}_n)^4}{S_n^4} - 3 \]

超过四阶矩后,想要通过图形化方式解释矩以及在矩未知的情况下从数据中对其进行良好估计都会迅速变得更加困难。然而,在本章的剩余部分中,我们将看到了解一个分布的所有矩仍然是有用的。我们还将学习一种通常比无意识统计学家法则(LOTUS)更简单的矩计算方法。矩的效用和计算都与一个被称为矩生成函数(生成函数)的蓝图密切相关,本章接下来的大部分内容都将致力于讨论这一主题。

6.4 矩生成函数

Moment generating functions

生成函数是一根晾衣绳,我们将一列数字挂在上面展示。—— 赫伯特·威尔夫(Herbert Wilf)[28]

生成函数是组合数学和概率论中的强大工具,它在数列与微积分世界之间架起了一座桥梁。在概率论中,它们对于研究离散型和连续型分布都非常有用。生成函数背后的总体思路如下:从一个数列开始,创建一个编码该数列的连续函数——即生成函数。这样我们就可以利用微积分的所有工具来处理这个生成函数。

顾名思义,矩生成函数(MGF)是编码分布各阶矩的生成函数。以下是其定义及几个示例。

定义 6.4.1(矩生成函数)。随机变量 \(X\) 的矩生成函数(MGF)定义为关于 \(t\) 的函数 \(M(t) = E(e^{tX})\),前提是该期望在包含 0 的某个开区间 \((-a, a)\) 上是有限的。否则,我们称 \(X\) 的矩生成函数不存在。

此时一个自然的问题是:“\(t\) 的含义是什么?”答案是 \(t\) 并没有特定的含义;它只是一个记账工具,我们引入它是为了能够使用微积分,而不是处理离散的矩序列。

请注意,对于任何有效的 MGF \(M\),都有 \(M(0) = 1\);每当你计算出一个 MGF 时,代入 0 看看是否得到 1,这是一个快速检查的方法!

示例 6.4.2(伯努利分布的 MGF)。对于 \(X \sim Bern(p)\),\(e^{tX}\) 以概率 \(p\) 取值 \(e^t\),以概率 \(q\) 取值 1,因此 \(M(t) = E(e^{tX}) = pe^t + q\)。由于这对于所有 \(t\) 值都是有限的,该 MGF 在整个实数轴上都有定义。

个人注:如果 \(X\) 是离散型,利用无意识统计学家法则(LOTUS):\[M_X(t) = \sum_{x} e^{tx} P(X=x)\]

如果 \(X\) 是连续型:\[M_X(t) = \int_{-\infty}^{\infty} e^{tx} f(x) dx\]

之所以叫“矩生成函数”,是因为对 \(M_X(t)\) 求 \(k\) 阶导数并令 \(t=0\),就能得到 \(X\) 的 \(k\) 阶矩 \(E(X^k)\)。

伯努利分布 \(X \sim \text{Bern}(p)\) 的取值非常简单:

- \(X = 1\) 的概率为 \(p\)

- \(X = 0\) 的概率为 \(q = 1-p\)

根据离散型的定义公式进行求和:

\[M_X(t) = E(e^{tX})\]

\[M_X(t) = e^{t \cdot 1} P(X=1) + e^{t \cdot 0} P(X=0)\]

\[M_X(t) = e^t \cdot p + 1 \cdot (1-p)\]

因此,伯努利分布的 MGF 为:

\[M_X(t) = pe^t + q\]

示例 6.4.3(几何分布的 MGF)。对于 \(X \sim Geom(p)\), \[ M(t) = E(e^{tX}) = \sum_{k=0}^{\infty} e^{tk} q^k p = p \sum_{k=0}^{\infty} (qe^t)^k = \frac{p}{1 - qe^t} \]

当 \(qe^t < 1\) 时(即 \(t \in (-\infty, \log(1/q))\))成立,这是一个包含 0 的开区间。

示例 6.4.4(均匀分布的 MGF)。令 \(U \sim Unif(a, b)\)。那么 \(U\) 的 MGF 为 \[ M(t) = E(e^{tU}) = \frac{1}{b-a} \int_{a}^{b} e^{tu} du = \frac{e^{tb} - e^{ta}}{t(b-a)} \]

对于 \(t \neq 0\) 成立,且 \(M(0) = 1\)。

接下来的三个定理给出了矩生成函数(MGF)之所以重要的三个原因。首先,MGF 编码了随机变量的各阶矩。其次,随机变量的 MGF 决定了其分布,就像 CDF 和 PMF/PDF 一样。第三,MGF 使得寻找独立随机变量之和的分布变得容易。让我们逐一来看。

定理 6.4.5(通过 MGF 的导数求矩)。给定 \(X\) 的 MGF,我们可以通过在 0 处评估 MGF 的 \(n\) 阶导数来获得 \(X\) 的 \(n\) 阶矩: \[ E(X^n) = M^{(n)}(0) \]

证明。通过观察 \(M(t)\) 关于 0 的泰勒展开式可以得出: \[ M(t) = \sum_{n=0}^{\infty} \frac{M^{(n)}(0)t^n}{n!} \]

而另一方面,我们也有: \[ M(t) = E(e^{tX}) = E\left( \sum_{n=0}^{\infty} \frac{X^n t^n}{n!} \right) \]

由于满足某些技术条件(此处我们调用了 \(E(e^{tX})\) 在 0 附近的区间内是有限的这一条件),我们被允许交换期望和无限求和的顺序,因此: \[ M(t) = \sum_{n=0}^{\infty} \frac{E(X^n) t^n}{n!} \]

对比这两个展开式的系数,我们得到 \(E(X^n) = M^{(n)}(0)\)。

上述定理令人惊讶之处在于,对于连续随机变量 \(X\),计算矩似乎需要使用 LOTUS 进行积分,但有了 MGF,通过求导而不是积分就可以找到矩!

定理 6.4.6(MGF 决定分布)。随机变量的 MGF 决定了其分布:如果两个随机变量具有相同的 MGF,它们必须具有相同的分布。事实上,如果即使在包含 0 的微小区间 \((-a, a)\) 上 MGF 相等,那么这些随机变量也必须具有相同的分布。

上述定理是分析学中一个困难的结论,因此我们在此不予证明。

定理 6.4.7(独立随机变量之和的 MGF)。如果 \(X\) 和 \(Y\) 相互独立,那么 \(X+Y\) 的 MGF 是各自 MGF 的乘积: \[ M_{X+Y}(t) = M_X(t)M_Y(t) \]

这是因为如果 \(X\) 和 \(Y\) 独立,则 \(E(e^{t(X+Y)}) = E(e^{tX})E(e^{tY})\)(这源于第 7 章讨论的结论)。利用这一事实,我们可以得到二项分布和负二项分布的 MGF,它们分别是独立伯努利随机变量之和以及独立几何随机变量之和。

示例 6.4.8(二项分布的 MGF)。\(Bern(p)\) 随机变量的 MGF 是 \(pe^t + q\),因此 \(Bin(n, p)\) 随机变量的 MGF 是 \[ M(t) = (pe^t + q)^n \]

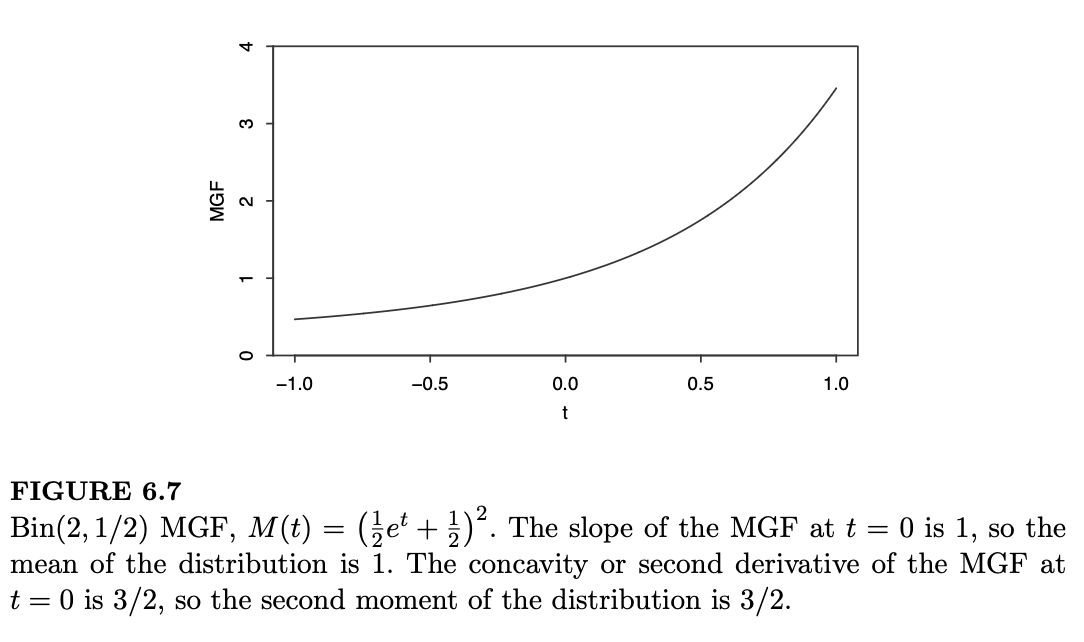

图 6.7 绘制了 \(Bin(2, 1/2)\) 分布的 MGF,\(M(t) = (\frac{1}{2} e^t + \frac{1}{2})^2\),范围在 \(t = -1\) 到 \(t = 1\) 之间。与所有 MGF 一样,在 \(t = 0\) 处的值为 1。该分布的一阶矩和二阶矩是 MGF 在 \(t = 0\) 处评估的一阶和二阶导数;它们对应于所绘曲线在 \(t = 0\) 处的斜率和凹凸性。这两个导数分别为 1 和 \(3/2\),对应于 \(Bin(2, 1/2)\) 分布的均值为 1 且方差为 \(3/2 - 1^2 = 1/2\) 这一事实。

示例 6.4.9(负二项分布的 MGF)。我们已知 \(Geom(p)\) 随机变量的 MGF 在 \(qe^t < 1\) 时为 \(\frac{p}{1 - qe^t}\),因此 \(X \sim NBin(r, p)\) 的 MGF 为 \[ M(t) = \left( \frac{p}{1 - qe^t} \right)^r,\text{对于 } qe^t < 1 \]

6.4.10。并非所有随机变量都具有 MGF。对于某些随机变量 \(X\),其 \(E(X)\) 甚至不存在,或者对于某些 \(n > 1\),\(E(X^n)\) 不存在,在这种情况下,MGF 显然也不存在。但即使 \(X\) 的所有矩都存在,如果矩增长得太快,MGF 也可能不存在。幸运的是,有一种方法可以解决这个问题:插入一个虚数!函数 \(\psi(t) = E(e^{itX})\)(其中 \(i = \sqrt{-1}\))被统计学家称为特征函数,被其他人称为傅里叶变换。事实证明,特征函数总是存在的。在本书中,我们将侧重于 MGF 而不是特征函数,以避免处理虚数。

正如我们在上一章所看到的,位置和尺度变换是从初始分布构建分布族的根本方法。例如,从 \(Z \sim N(0, 1)\) 开始,我们可以通过 \(\sigma\) 进行缩放并移动 \(\mu\) 来获得 \(X = \mu + \sigma Z \sim N(\mu, \sigma^2)\)。通常,如果我们有一个均值为 \(\mu\)、标准差为 \(\sigma > 0\) 的随机变量 \(X\),我们可以创建标准化版本 \((X - \mu)/\sigma\),反之亦然。方便的是,通过这种变换连接的两个随机变量的 MGF 很容易建立联系。

命题 6.4.11(位置-尺度变换的 MGF)。如果 \(X\) 具有 MGF \(M(t)\),那么 \(a + bX\) 的 MGF 为 \[ E(e^{t(a+bX)}) = e^{at} E(e^{btX}) = e^{at} M(bt) \]

例如,让我们利用这个命题来协助获取正态分布和指数分布的 MGF。

示例 6.4.12(正态分布的 MGF)。标准正态随机变量 \(Z\) 的 MGF 是 \[ M_Z(t) = E(e^{tZ}) = \int_{-\infty}^{\infty} e^{tz} \frac{1}{\sqrt{2\pi}} e^{-z^2/2} dz \]

配方后,我们得到 \[ M_Z(t) = e^{t^2/2} \int_{-\infty}^{\infty} \frac{1}{\sqrt{2\pi}} e^{-(z-t)^2/2} dz = e^{t^2/2} \]

因为 \(N(t, 1)\) 的 PDF 积分等于 1。因此,\(X = \mu + \sigma Z \sim N(\mu, \sigma^2)\) 的 MGF 是 \[ M_X(t) = e^{\mu t} M_Z(\sigma t) = e^{\mu t} e^{(\sigma t)^2/2} = e^{\mu t + \frac{1}{2} \sigma^2 t^2} \]

示例 6.4.13(指数分布的 MGF)。\(X \sim Expo(1)\) 的 MGF 是 \[ M(t) = E(e^{tX}) = \int_{0}^{\infty} e^{tx} e^{-x} dx = \int_{0}^{\infty} e^{-x(1-t)} dx = \frac{1}{1-t} \]

对于 \(t < 1\) 成立。

所以 \(Y = X/\lambda \sim Expo(\lambda)\) 的 MGF 是 \[ M_Y(t) = M_X\left( \frac{t}{\lambda} \right) = \frac{1}{1 - t/\lambda} = \frac{\lambda}{\lambda - t} \]

对于 \(t < \lambda\) 成立。

6.5 通过 MGF 生成矩

Generating moments with MGFs

我们现在给出一些利用 MGF 寻找矩的示例。定理 6.4.5 表明,我们可以通过对 MGF 求导并代入 0 来获得各阶矩,而不需要通过 LOTUS 进行复杂的求和或积分。更有甚者,在某些情况下,我们可以通过泰勒展开同时找到分布的所有矩,而不需要一遍又一遍地求导。

示例 6.5.1(指数分布的矩)。在这个例子中,我们将展示如何利用指数分布的 MGF 同时获得该分布的所有矩!令 \(X \sim Expo(1)\)。\(X\) 的 MGF 为 \(M(t) = 1/(1-t)\),对于 \(t < 1\) 成立。

正如定理 6.4.5 所示,我们可以通过对 MGF 求导并代入 0 来获得矩。然而在这种情况下,我们可以认出 \(1/(1-t)\) 是一个几何级数,在 0 附近的区间内有效。对于 \(|t| < 1\): \[ M(t) = \frac{1}{1-t} = \sum_{n=0}^{\infty} t^n = \sum_{n=0}^{\infty} \frac{n! t^n}{n!} \]

另一方面,我们知道 \(E(X^n)\) 是 \(M(t)\) 泰勒展开式中 \(t^n\) 项的系数: \[ M(t) = \sum_{n=0}^{\infty} \frac{E(X^n) t^n}{n!} \]

因此,我们可以通过对比系数得出:对于所有的 \(n\),\(E(X^n) = n!\)。我们不仅不需要进行 LOTUS 积分,而且也不需要为了得到第 10 阶矩而去求 10 次导——我们一次性得到了所有的矩。

要找到 \(Y \sim Expo(\lambda)\) 的矩,可以使用尺度变换:我们可以将 \(Y\) 表示为 \(Y = X/\lambda\),其中 \(X \sim Expo(1)\)。因此 \(Y^n = X^n / \lambda^n\),并且: \[ E(Y^n) = \frac{n!}{\lambda^n} \]

特别地,我们找到了 \(Y\) 的均值和方差,兑现了我们在第 5 章中许下的承诺: \[ E(Y) = \frac{1}{\lambda} \]

\[ \text{Var}(Y) = E(Y^2) - (EY)^2 = \frac{2}{\lambda^2} - \left(\frac{1}{\lambda}\right)^2 = \frac{1}{\lambda^2} \]

示例 6.5.2(标准正态分布的矩)。在这个例子中,我们将求出标准正态分布的所有矩。令 \(Z \sim N(0, 1)\)。我们可以使用相同的技巧,即对比泰勒展开式的系数。 \[ M(t) = e^{t^2/2} = \sum_{n=0}^{\infty} \frac{(t^2/2)^n}{n!} = \sum_{n=0}^{\infty} \frac{t^{2n}}{2^n \cdot n!} = \sum_{n=0}^{\infty} \frac{(2n)!}{2^n \cdot n!} \frac{t^{2n}}{(2n)!} \]

因此, \[ E(Z^{2n}) = \frac{(2n)!}{2^n \cdot n!} \]

且 \(Z\) 的奇阶矩都等于 0,这由于标准正态分布的对称性必然成立。根据示例 1.5.4 中关于合伙关系的组合证明(story proof),我们知道 \(\frac{(2n)!}{2^n \cdot n!}\) 是从 1 到 \(2n-1\) 所有奇数的乘积,所以: \[ E(Z^2) = 1, \quad E(Z^4) = 1 \cdot 3, \quad E(Z^6) = 1 \cdot 3 \cdot 5, \dots \]

这一结果也表明正态随机变量的峰度为 0。对于 \(X \sim N(\mu, \sigma^2)\): \[ \text{Kurt}(X) = E\left[ \left( \frac{X-\mu}{\sigma} \right)^4 \right] - 3 = E(Z^4) - 3 = 3 - 3 = 0 \]

示例 6.5.3(对数正态分布的矩)。现在让我们考虑对数正态分布。如果 \(Y = e^X\),其中 \(X \sim N(\mu, \sigma^2)\),我们称 \(Y\) 服从参数为 \(\mu\) 和 \(\sigma^2\) 的对数正态分布,记作 \(Y \sim LN(\mu, \sigma^2)\)。

6.5.4。对数正态并不意味着“正态分布的对数”,因为正态随机变量可以取负值。相反,对数正态的意思是“其对数服从正态分布”。区分对数正态分布自身的均值、方差与底层正态分布的均值、方差是非常重要的。在这里,我们将 \(\mu\) 和 \(\sigma^2\) 定义为底层正态分布的均值和方差,这是最通用的惯例。

有趣的是,对数正态分布的 MGF 并不存在,因为对于所有 \(t > 0\),\(E(e^{tY})\) 都是无穷大。考虑 \(Y = e^Z\) 且 \(Z \sim N(0, 1)\) 的情况;根据 LOTUS: \[ E(e^{tY}) = E(e^{te^Z}) = \int_{-\infty}^{\infty} e^{te^z} \frac{1}{\sqrt{2\pi}} e^{-z^2/2} dz = \int_{-\infty}^{\infty} \frac{1}{\sqrt{2\pi}} e^{te^z - z^2/2} dz \]

对于任何 \(t > 0\),随着 \(z\) 的增大,\(te^z - z^2/2\) 会趋于无穷大,因此上述积分发散。由于 \(E(e^{tY})\) 在包含 0 的开区间内不是有限的,所以 \(Y\) 的 MGF 不存在。同样的推导也适用于一般的对数正态分布。

然而,尽管对数正态分布的 MGF 不存在,我们仍然可以利用正态分布的 MGF 获得对数正态分布的所有矩。对于 \(Y = e^X\) 且 \(X \sim N(\mu, \sigma^2)\): \[ E(Y^n) = E(e^{nX}) = M_X(n) = e^{n\mu + \frac{1}{2} n^2 \sigma^2} \]

换句话说,对数正态分布的第 \(n\) 阶矩就是在 \(t = n\) 处评估的正态分布的 MGF。令 \[ m = E(Y) = e^{\mu + \frac{1}{2} \sigma^2} \]

经过一些代数运算,我们得到: \[ \text{Var}(Y) = E(Y^2) - m^2 = m^2(e^{\sigma^2} - 1) \]

所有对数正态分布都是右偏的。例如,图 6.2 中深色曲线显示的对数正态 PDF,均值为 2,方差为 12。这是 \(X \sim N(0, 2\log 2)\) 时 \(e^X\) 的分布,它显然是右偏的。为了量化这一点,让我们计算 \(X \sim N(0, \sigma^2)\) 时对数正态随机变量 \(Y = e^X\) 的偏度。令 \(m = E(Y) = e^{\frac{1}{2}\sigma^2}\),我们有 \(E(Y^n) = m^{n^2}\) 且 \(\text{Var}(Y) = m^2(m^2 - 1)\),三阶中心矩为: \[ E(Y-m)^3 = E(Y^3 - 3mY^2 + 3m^2Y - m^3) \]

\[ = E(Y^3) - 3mE(Y^2) + 2m^3 \]

\[ = m^9 - 3m^5 + 2m^3 \]

因此,偏度为: \[ \text{Skew}(Y) = \frac{E(Y-m)^3}{SD^3(Y)} = \frac{m^9 - 3m^5 + 2m^3}{m^3(m^2 - 1)^{3/2}} = (m^2 + 2)\sqrt{m^2 - 1} \]

在最后一步中,我们对 \(m^6 - 3m^2 + 2 = (m^2 + 2)(m^2 - 1)^2\) 进行了因式分解。由于 \(m > 1\),偏度为正,且随着 \(\sigma\) 的增大,偏度增加得非常快。

在下一个示例中,我们介绍 Weibull 分布(韦伯分布),它是生存分析(研究事件发生前的持续时间,例如对患有特定疾病的人能存活多久进行建模)中最广泛使用的分布之一。

示例 6.5.5(Weibull 分布)。正如你可能从前一章中记得的那样,指数分布具有无记忆性,这使得它在为人类寿命等建模时显得不切实际。值得注意的是,仅仅将一个指数随机变量提升到某个幂次,就能极大地提高该分布的灵活性和适用性。

令 \(T = X^{1/\gamma}\),其中 \(X \sim Expo(\lambda)\) 且 \(\lambda, \gamma > 0\)。\(T\) 的分布被称为 Weibull 分布,我们记作 \(T \sim Wei(\lambda, \gamma)\)。这推广了指数分布,当 \(\gamma = 1\) 时退化回指数分布。

Weibull 分布在生物统计学、流行病学和工程学中应用广泛;甚至有一本 800 页的专著专门讨论此分布:Horst Rinne 所著的《The Weibull Distribution: A Handbook》[21]。

\(T\) 的概率密度函数(PDF)为: \[ f(t) = \gamma \lambda e^{-\lambda t^\gamma} t^{\gamma-1} \]

对于 \(t > 0\) 成立,这可以通过将 \(T\) 的 CDF 与 \(X\) 的 CDF 联系起来,或使用第 8 章中的变换结论来证明。其 PDF 看起来有些复杂,但在处理 Weibull 随机变量时,我们通常可以采用先将其转换回指数分布的策略。

为了简单和具体起见,让我们看一个特定的 Weibull 分布,令 \(\lambda = 1\) 且 \(\gamma = 1/3\)。

求 \(P(T > s+t | T > s)\),其中 \(s, t > 0\)。\(T\) 是否具有无记忆性?

求 \(T\) 的均值和方差,以及 \(n\) 阶矩 \(E(T^n)\),\(n = 1, 2, \dots\)。

确定 \(T\) 的矩生成函数(MGF)是否存在。

解:

- \(T\) 的累积分布函数(CDF)为: \[ P(T \leq t) = P(X^3 \leq t) = P(X \leq t^{1/3}) = 1 - e^{-t^{1/3}} \]

对于 \(t > 0\) 成立。因此 \[ P(T > s+t | T > s) = \frac{P(T > s+t)}{P(T > s)} = \frac{e^{-(s+t)^{1/3}}}{e^{-s^{1/3}}} \]

这与 \(P(T > t) = e^{-t^{1/3}}\) 不同。因此,\(T\) 不具有无记忆性。它也不可能具有,因为它不是指数分布。

- 示例 6.5.1 显示 \(X\) 的矩由 \(E(X^n) = n!\) 给出。这使我们无需进行任何额外工作就能找到 \(T\) 的矩!具体而言: \[ E(T^n) = E(X^{3n}) = (3n)! \]

\(T\) 的均值和方差为: \[ E(T) = 3! = 6, \quad \text{Var}(T) = 6! - 6^2 = 684 \]

- 根据 LOTUS: \[ E(e^{tT}) = E(e^{tX^3}) = \int_{0}^{\infty} e^{tx^3} e^{-x} dx \]

对于 \(t > 0\),此积分发散,因为 \(tx^3\) 项主导了 \(x\);更准确地说,对于所有足够大的 \(x\)(具体而言,当 \(x > \sqrt{2/t}\) 时),我们有 \(tx^3 - x > x\),因此该积分通过与发散积分 \(\int_{0}^{\infty} e^x dx\) 比较而发散。因此,尽管 \(T\) 的所有阶矩都存在,但 \(T\) 的 MGF 并不存在。

6.5.6。Weibull 分布有几种不同的常用参数化方法,例如,我们是先对指数分布给定一个尺度参数(\(\lambda\))然后再取幂,但先对 \(Expo(1)\) 取幂然后再重新调整尺度也很常见。因此,在阅读各种参考文献时需要留意:务必检查使用的是哪种惯例。我们这里的参数化方法在医学统计中被广泛使用,且由于只是对 \(Expo(\lambda)\) 随机变量进行幂运算,处理起来非常方便。

6.6 通过 MGF 求独立随机变量之和

Sums of independent r.v.s via MGFs

由于独立随机变量之和的 MGF 恰好是各分量 MGF 的乘积,我们现在有了一种寻找独立随机变量之和分布的新策略:将各分量的 MGF 相乘,观察乘积是否可以识别为某个已知分布的 MGF。接下来的两个示例说明了这一策略。

示例 6.6.1(独立泊松分布之和)。利用 MGF,我们可以轻松证明独立泊松随机变量之和仍服从泊松分布。首先,让我们求出 \(X \sim Pois(\lambda)\) 的 MGF: \[ E(e^{tX}) = \sum_{k=0}^{\infty} \frac{e^{tk} e^{-\lambda} \lambda^k}{k!} = e^{-\lambda} \sum_{k=0}^{\infty} \frac{(\lambda e^t)^k}{k!} = e^{-\lambda} e^{\lambda e^t} = e^{\lambda(e^t - 1)} \]

现在令 \(Y \sim Pois(\mu)\) 且与 \(X\) 独立。\(X + Y\) 的 MGF 为: \[ E(e^{tX})E(e^{tY}) = e^{\lambda(e^t - 1)} e^{\mu(e^t - 1)} = e^{(\lambda + \mu)(e^t - 1)} \]

这就是 \(Pois(\lambda + \mu)\) 的 MGF。由于 MGF 决定了分布,我们证明了 \(X + Y \sim Pois(\lambda + \mu)\)。将其与第 4 章(定理 4.8.1)的证明进行对比,后者需要使用全概率公式并对 \(X\) 的所有可能值求和。使用 MGF 的证明要简便得多。

6.6.2。在上述示例中,\(X\) 和 \(Y\) 必须相互独立,这一点非常重要。为了理解原因,考虑一种极端的依赖形式:\(X = Y\)。在这种情况下,\(X + Y = 2X\),它不可能是泊松分布,因为它的值总是偶数!

示例 6.6.3(独立正态分布之和)。如果我们有相互独立的 \(X_1 \sim N(\mu_1, \sigma_1^2)\) 和 \(X_2 \sim N(\mu_2, \sigma_2^2)\),那么 \(X_1 + X_2\) 的 MGF 为: \[ M_{X_1+X_2}(t) = M_{X_1}(t) M_{X_2}(t) = e^{\mu_1 t + \frac{1}{2} \sigma_1^2 t^2} \cdot e^{\mu_2 t + \frac{1}{2} \sigma_2^2 t^2} = e^{(\mu_1 + \mu_2)t + \frac{1}{2}(\sigma_1^2 + \sigma_2^2)t^2} \]

这就是 \(N(\mu_1 + \mu_2, \sigma_1^2 + \sigma_2^2)\) 的 MGF。同样地,因为 MGF 决定分布,必然有 \(X_1 + X_2 \sim N(\mu_1 + \mu_2, \sigma_1^2 + \sigma_2^2)\)。因此,独立正态变量之和仍为正态变量,且均值和方差直接相加。

示例 6.6.4(和为正态分布)。前一个示例的逆命题也成立:如果 \(X_1\) 和 \(X_2\) 独立且 \(X_1 + X_2\) 是正态分布,那么 \(X_1\) 和 \(X_2\) 必须都是正态分布!这被称为克拉美定理(Cramér's theorem)。在完全一般的情况下证明这一点很困难,但如果 \(X_1\) 和 \(X_2\) 是具有 MGF \(M(t)\) 的独立同分布变量,证明就会容易得多。不失一般性,我们可以假设 \(X_1 + X_2 \sim N(0, 1)\),那么它的 MGF 为: \[ e^{t^2/2} = E(e^{t(X_1 + X_2)}) = E(e^{tX_1}) E(e^{tX_2}) = (M(t))^2 \]

因此 \(M(t) = e^{t^2/4}\),这是 \(N(0, 1/2)\) 的 MGF。从而 \(X_1, X_2 \sim N(0, 1/2)\)。

在第 8 章中,我们将讨论一种寻找随机变量之和分布的更通用的技术,该技术适用于各分量 MGF 不存在,或者各分量 MGF 的乘积无法识别且我们希望直接获得 PMF/PDF 的情况。

6.7 *概率生成函数

*Probability generating functions

在本节中,我们将讨论概率生成函数(PGF),它与 MGF 类似,但能确保在非负整数值随机变量中存在。首先,我们将使用 PGF 来攻克一个看似棘手的计数问题。接着,我们将证明非负整数值随机变量的 PGF 决定了它的分布,而这一点在更一般的 MGF 讨论中我们略过了。

定义 6.7.1(概率生成函数)。一个具有 PMF \(p_k = P(X = k)\) 的非负整数值随机变量 \(X\) 的概率生成函数(PGF)是该 PMF 的生成函数。根据 LOTUS,其定义为: \[ E(t^X) = \sum_{k=0}^{\infty} p_k t^k \]

对于所有的 \(t \in [-1, 1]\),该 PGF 都会收敛到 \([-1, 1]\) 范围内的一个值,因为 \(\sum_{k=0}^{\infty} p_k = 1\),且当 \(|t| \leq 1\) 时,\(|p_k t^k| \leq p_k\)。

当两者都存在时,MGF 与 PGF 密切相关:对于 \(t > 0\), \[ E(t^X) = E(e^{X \log t}) \]

即为在 \(\log t\) 处评估的 MGF。

示例 6.7.2(生成骰子概率)。哈佛大学统计系创始人弗雷德里克·莫斯特勒(Frederick Mosteller)曾讲述过一段改变他人生的时刻:

我生命中的一个关键时刻发生在大二的一门课上。我们遇到了这样一个问题:掷三枚骰子,点数之和为 10 的概率是多少?这门课的学生都很优秀,但我们基本上都是靠数手指头算出的答案。上课时我对老师说:“算出来固然很好,但如果问的是掷六枚骰子点数之和为 18 的概率,我们现在恐怕还在家里数呢。这种题目该怎么做?”他说:“我不知道,但我认识一个人可能知道,我去问问他。”

有一天我在图书馆,数学系的埃德温·G·奥尔兹(Edwin G. Olds)教授走了进来。他冲我喊道:“我听说你对三枚骰子的问题感兴趣。”他的嗓门极大,你知道图书馆是什么样的地方。我感到很尴尬。他说:“那好,来我办公室,我给你演示一下。”我说:“好的。”但我心里想的是:“我才不去呢。”然后他问:“你在忙什么?”我给他看了看。他说:“那不重要。我们现在就走吧。”

于是我们去了他的办公室,他向我展示了一个生成函数。那是我在数学中见过的最奇妙的东西。它所运用的数学知识,在我内心深处,曾一直被我认为是数学家为了给高中和大学里无辜的学生出作业题而编造出来的。我不知道自己怎么会对数学产生那样的看法。总之,当我看到奥尔兹如何运用这些我不曾相信的数学时,我惊呆了。他以一种极其不可思议的方式运用了它。这完全是对数字含义的一次重新翻译。[1]

令 \(X\) 为掷 6 枚公平骰子得到的点数总和,令 \(X_1, \dots, X_6\) 为单次掷骰子的点数。\(P(X = 18)\) 是多少?事实证明,得到总和 18 的方法共有 3431 种,因此概率为 \(3431/6^6 \approx 0.0735\)。列出所有可能性是极其枯燥的,而且这种枯燥还会伴随着漏掉某种情况的担忧。如果我们费尽心力列出了所有 3431 种情况,接着又被要求计算 \(P(X = 19)\) 怎么办?

\(X\) 的概率生成函数(PGF)可以让我们系统地计算这些情况。\(X_1\) 的 PGF 为: \[ E(t^{X_1}) = \frac{1}{6}(t + t^2 + \dots + t^6) \]

由于 \(X_j\) 是独立同分布的,\(X\) 的 PGF 为: \[ E(t^X) = E(t^{X_1} \dots t^{X_6}) = E(t^{X_1}) \dots E(t^{X_6}) = \frac{t^6}{6^6} (1 + t + \dots + t^5)^6 \]

根据定义,PGF 中 \(t^{18}\) 的系数就是 \(P(X = 18)\)。因此,得到总和 18 的方法数就是 \(t^6(1 + t + \dots + t^5)^6\) 中 \(t^{18}\) 的系数,也就是 \((1 + t + \dots + t^5)^6\) 中 \(t^{12}\) 的系数。虽然手动展开这个多项式也很麻烦,但它比列出 3431 种情况要容易得多,而且可以在计算机上轻松完成,无需编写专门的程序。

更妙的是,我们可以利用 \(1 + t + \dots + t^5\) 是等比级数这一事实,将其写成: \[ (1 + t + \dots + t^5)^6 = \frac{(1 - t^6)^6}{(1 - t)^6} \]

(假设 \(|t| < 1\),我们可以这样做是因为就像处理 MGF 一样,我们只需要知道 PGF 在包含 0 的开区间内的性质即可。)由于我们引入了 \(t\) 这个记账工具,上述等式仅仅是代数运算,但如果一切仍以数列符号表示,将很难理解。根据二项式定理,分子部分为: \[ (1 - t^6)^6 = \sum_{j=0}^6 \binom{6}{j} (-1)^j t^{6j} \]

对于分母部分,写成: \[ \frac{1}{(1 - t)^6} = (1 + t + t^2 + \dots)^6 = \sum_{k=0}^{\infty} a_k t^k \]

这里的 \(a_k\) 是从六个 \((1 + t + t^2 + \dots)\) 因子中各选出一项,使得它们的次数之和等于 \(k\) 的方法数。例如,当 \(k = 20\) 时,一种可能性是分别选择 \(t^3, 1, t^2, t^{10}, 1, t^5\) 项,因为这些选择在乘积展开时会贡献一个 \(t^{20}\) 项。因此,\(a_k\) 是方程 \(y_1 + y_2 + \dots + y_6 = k\) 的非负整数解的个数。我们在第 1 章中已经学过如何计算这个解的数量:\(a_k\) 是玻色-爱因斯坦(Bose-Einstein)值 \(\binom{6+k-1}{k} = \binom{k+5}{5}\)。所以: \[ \frac{1}{(1 - t)^6} = \sum_{k=0}^{\infty} \binom{k+5}{5} t^k \]

对于 \(0 < t < 1\),观察该等式成立的另一种方法是将其写为: \[ \sum_{k=0}^{\infty} \binom{k+5}{5} (1 - t)^6 t^k = 1 \]

我们已知这是成立的,因为 \(NBin(6, 1-t)\) 的 PMF 之和必须为 1。(\((1-t)^{-6}\) 的恒等式是将二项式定理推广到负整数幂的一个例子;这有助于解释为什么负二项分布虽然既不是负的也不是二项分布,却被冠以这个名字!)

综合以上结果,我们只需要求出下式中 \(t^{12}\) 的系数: \[ \left( \sum_{j=0}^{2} \binom{6}{j} (-1)^j t^{6j} \right) \left( \sum_{k=0}^{12} \binom{k+5}{5} t^k \right) \]

在两个因子中,我们分别只求和到 \(j=2\) 和 \(k=12\),因为后续的任何项都不会对 \(t^{12}\) 的系数产生贡献。这让我们将 3431 种情况简化为仅三种情况:\((j, k)\) 分别为 \((0, 12)\)、\((1, 6)\) 或 \((2, 0)\)。\(t^{12}\) 的系数为: \[ \binom{17}{5} - 6\binom{11}{5} + \binom{6}{2} = 3431 \]

例如,当 \(j=1\) 且 \(k=6\) 时,我们得到项: \[ - \binom{6}{1} t^6 \cdot \binom{6+5}{5} t^6 = -6 \binom{11}{5} t^{12} \]

因此, \[ P(X = 18) = \frac{3431}{6^6} \]

由于概率生成函数(PGF)仅仅是概率质量函数(PMF)的一个便捷记账工具,它完全决定了(任何非负整数值随机变量的)分布。下面的定理展示了如何从 PGF 这根“晾衣绳”上取下 PMF 的各个值。

定理 6.7.3。令 \(X\) 和 \(Y\) 为非负整数值随机变量,其 PGF 分别为 \(g_X\) 和 \(g_Y\)。假设对于所有 \(t \in (-a, a)\)(其中 \(0 < a < 1\)),都有 \(g_X(t) = g_Y(t)\)。那么 \(X\) 和 \(Y\) 具有相同的分布,且它们的 PMF 可以通过对 \(g_X\) 求导来还原: \[ P(X=k) = P(Y=k) = \frac{g_X^{(k)}(0)}{k!} \]

证明。写出展开式: \[ g_X(t) = \sum_{k=0}^{\infty} p_k t^k \]

那么 \(g_X(0) = p_0\),因此 \(P(X = 0)\) 已经还原了——通过已知函数 \(g_X\),我们可以提取出 \(P(X = 0)\) 的值。其导数为: \[ g_X'(t) = \sum_{k=1}^{\infty} k p_k t^{k-1} \]

故 \(g_X'(0) = p_1\)(实分析中的结论证明了交换求导和无限求和次序的合理性)。于是 \(P(X = 1)\) 也被还原了。以此类推,我们可以通过求导还原整个 PMF。

示例 6.7.4。令 \(X \sim Bin(n, p)\)。\(Bern(p)\) 随机变量的 PGF 是 \(pt + q\)(其中 \(q = 1-p\)),因此 \(X\) 的 PGF 是 \(g(t) = (pt + q)^n\)。上述定理指出,任何具有此 PGF 的随机变量实际上必然服从二项分布。此外,我们可以通过计算以下各项来还原 PMF: \[ g(0) = q^n, \quad g'(0) = npq^{n-1}, \quad g''(0)/2! = \binom{n}{2} p^2 q^{n-2}, \dots \]

我们可以通过利用二项式定理展开来避免求导: \[ g(t) = (pt + q)^n = \sum_{k=0}^n \binom{n}{k} p^k q^{n-k} t^k \]

由此我们可以直接读出二项分布的 PMF。

既然我们在处理二项分布的 PGF,让我们看看如何用它来获取二项分布的矩。令 \(p_k = P(X = k)\),我们有: \[ g'(t) = np(pt + q)^{n-1} = \sum_{k=1}^n k p_k t^{k-1} \]

因此, \[ g'(1) = np = \sum_{k=1}^n k p_k = E(X) \]

再次求导: \[ g''(t) = n(n-1)p^2(pt + q)^{n-2} = \sum_{k=2}^n k(k-1) p_k t^{k-2} \]

所以, \[ E(X(X-1)) = g''(1) = n(n-1)p^2 \]

整理这些结果可以得到 \(\text{Var}(X) = npq\) 的另一种证明。以此类推,我们计算出了所谓的二项分布的阶乘矩(factorial moments): \[ E(X(X-1)\dots(X-k+1)) = k! \binom{n}{k} p^k \]

等式两边同时除以 \(k!\),这意味着 \(E\binom{X}{k} = \binom{n}{k} p^k\),这也可以通过组合证明(story proof)看出:\(\binom{X}{k}\) 是从 \(X\) 次成功的伯努利试验中选择 \(k\) 次的方法数,这等于从原始的 \(n\) 次试验中选择 \(k\) 次且这 \(k\) 次全部成功的方法数。为 \(n\) 个大小为 \(k\) 的子集中的每一个创建一个指示随机变量并利用线性性质,即可得出结论。

6.8 本章小结

研究分布的一种有效方式是通过其矩。前四阶矩被广泛用作定量描述分布形态的基础,尽管还有许多其他描述方式。具体而言,一阶矩是均值,二阶中心矩是方差,三阶标准化矩衡量偏度(对称性),四阶标准化矩减去 3 则是衡量尾部厚度的指标。

矩的用途远不止于研究分布的位置和形状,尤其是当矩生成函数(MGF)存在时(这比“所有矩都存在”这一条件更强)。随机变量 \(X\) 的 MGF 是定义如下的函数 \(M\): \[ M(t) = E(e^{tX}) \]

前提是该期望在包含 0 的某个开区间内的所有 \(t\) 值上都是有限的。如果 MGF 存在,那么: \[ M(0) = 1, \quad M'(0) = E(X), \quad M''(0) = E(X^2), \quad M'''(0) = E(X^3), \dots \]

MGF 之所以有用,主要有三个原因:用于计算矩(作为 LOTUS 的替代方案)、用于研究独立随机变量之和,以及因为它们完全决定了分布,从而可以作为分布的另一种“蓝图”。

在本章中,我们还介绍了对数正态分布和 Weibull 分布,这两者在实践中都被广泛应用。对数正态分布和 Weibull 分布分别通过简单的变换与正态分布和指数分布相联系。对数正态随机变量的对数是正态的,而将 \(Wei(\lambda, \gamma)\) 随机变量提升到 \(\gamma\) 次幂则得到 \(Expo(\lambda)\) 随机变量。通常,研究对数正态分布的最佳方法是将其转换回正态分布,对于 Weibull 和指数分布也是如此。第 8 章将更详细地探讨如何处理这些变换。

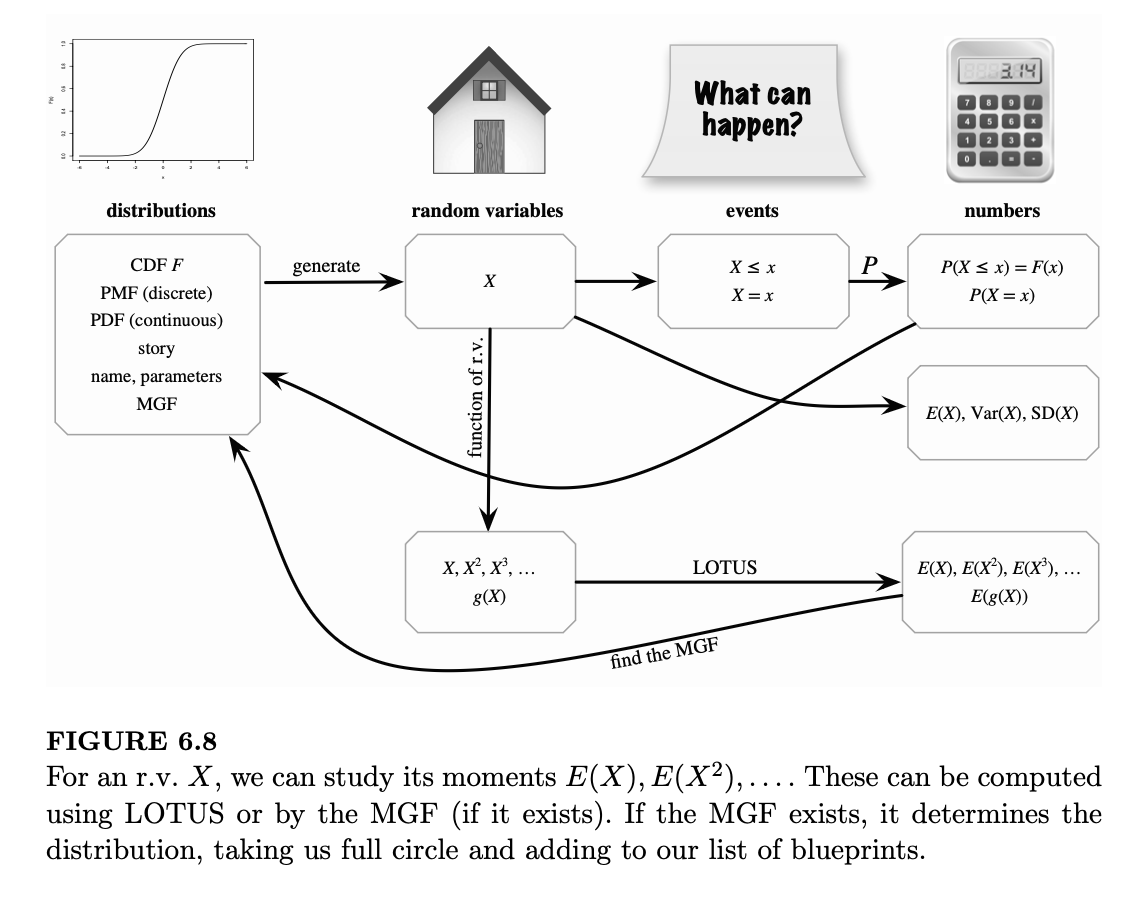

图 6.8 扩充了我们关于概率论中基本对象之间联系的版图。如果 \(X\) 的 MGF 存在,那么矩序列 \(E(X), E(X^2), E(X^3), \dots\) 提供了足够的信息(至少在原理上)来确定 \(X\) 的分布。

6.9 R 语言实现

函数 (Functions)

在 R 中,随机变量的矩生成函数(MGF)被定义为一个函数。以标准正态分布 \(N(0,1)\) 的 MGF 为例,其公式为 \(M(t) = e^{t^2/2}\)。以下代码将其定义为 R 函数:

R

1 | M <- function(t) {exp(t^2/2)} |

function(t) 表示我们正在定义一个以 \(t\) 为变量(称为参数)的函数。随后,M(0) 会计算函数在 0 处的值;M(1:10) 会计算在 \(1, 2, \dots, 10\) 处的值;curve(M, from=-3, to=3) 则会绘制该函数在 \(-3\) 到 \(3\) 之间的图像。

给参数命名对于多变量函数非常有帮助,这样我们就无需死记硬背参数的顺序,并可以分配默认值。例如,\(N(\mu, \sigma^2)\) 的 MGF 为 \(g(t) = \exp(\mu t + \sigma^2 t^2/2)\),它取决于 \(t, \mu\) 和 \(\sigma\)。在 R 中可以这样定义:

R

1 | g <- function(t, mean=0, sd=1) {exp(mean*t + sd^2*t^2/2)} |

通过命名参数,你可以使用 g(t=1, mean=2, sd=3) 或任何顺序的组合。此外,由于定义了默认值,如果你想计算 \(N(0, 5^2)\) 在 \(t=3\) 处的值,只需简写为 g(t=3, sd=5)。

矩 (Moments)

利用 LOTUS(无意识统计学家法则),连续随机变量的任何阶矩都可以写成积分形式。R 可以使用 integrate 命令进行数值积分。

例如,估算 \(N(0,1)\) 的六阶矩:

R

1 | g <- function(x) x^6 * dnorm(x) |

R 会计算 \(\int_{-\infty}^{\infty} x^6 \phi(x) dx\),其中 \(\phi\) 是 \(N(0,1)\) 的 PDF。运行结果为 15(与本章理论计算值一致),且误差极小。

同样,验证 \(Unif(-1, 1)\) 的二阶矩(即方差)为 \(1/3\):

R

1 | h <- function(x) x^2 * dunif(x, -1, 1) |

6.9.1 注意事项:数值积分对某些函数可能会遇到困难,因此多重验证是明智的。在计算到无穷大时,建议直接使用

upper = Inf而非一个很大的数字。例如,在许多系统中,integrate(dnorm, 0, 10^6)可能错误地报告 0,而integrate(dnorm, 0, Inf)则能正确返回 0.5。

对于离散随机变量,我们可以结合 LOTUS 和 sum 命令。例如,求 \(X \sim Pois(7)\) 的二阶矩:

R

1 | g <- function(k) k^2 * dpois(k, 7) |

这里我们求和到 100,因为 100 之后的项对总体的贡献微乎其微。结果非常接近 56,这符合 \(E(X^2) = \text{Var}(X) + (EX)^2 = 7 + 49 = 56\)。

在 R 中,计算样本矩通常只需要一行代码。如果 x 是一个包含数据的向量,那么 mean(x) 给出其样本均值;更一般地,对于任何正整数 \(n\),mean(x^n) 给出第 \(n\) 阶样本矩。

例如:

R

1 | x <- rnorm(100) |

这段代码计算了 100 个独立同分布的 \(N(0,1)\) 随机变量的六阶样本矩。它与真实值(我们在 6.5.2 节中算出的 15)有多接近?其他样本矩又表现如何?

根据大数定律(Law of Large Numbers),随着样本量 \(n\) 的增加,样本矩会趋于真实的总体矩。不过,高阶矩的波动性通常比低阶矩更大,因此需要更大的样本量才能获得精确的估计。

样本方差与标准差

在 R 中,var(x) 直接给出样本方差。

- 如果

x的长度为 1,var(x)会返回NA(不可用)。 - 这是合理的,因为样本方差的分母是 \(n-1\),当 \(n=1\) 时分母为 0。此外,仅凭一个观测值就试图估计总体的变异性也是不现实的。

我们可以进行简单的模拟:

R

1 | z <- rnorm(1000) |

提醒:在 R 的

rnorm函数中,输入的是标准差 \(\sigma\),而不是方差 \(\sigma^2\)。

样本标准差可以使用 sd(x) 计算,其结果与 sqrt(var(x)) 完全一致。

自定义样本偏度与峰度

虽然 R 没有内置计算样本偏度和样本峰度的函数,但我们可以根据定义轻松自定义:

R

1 | # 样本偏度函数 |

这些自定义函数通过计算三阶和四阶中心矩,并用标准差进行归一化(峰度还需减去 3),从而量化分布的非对称性和尾部厚度。

中位数与众数

连续分布的中位数

对于具有累积分布函数(CDF)\(F\) 的连续随机变量,求中位数意味着解方程 \(F(x) = 1/2\),即寻找函数 \(g(x) = F(x) - 1/2\) 的根(零点)。在 R 中可以使用 uniroot 函数。

例如,寻找 \(Expo(1)\) 分布的中位数:

R

1 | g <- function(x) pexp(x) - 1/2 |

R 会在 0 到 1 之间寻找根,得到的结果非常接近理论值 \(\ln(2) \approx 0.693\)。当然,对于指数分布,我们可以通过 \(1 - e^{-x} = 1/2\) 直接求出解析解。

6.9.2 注意事项:

uniroot命令仅尝试寻找一个根,且不能保证一定能找到。在 R 中寻找中位数更简单的方法是使用分位数函数(Quantile function)。例如

qexp(1/2)会直接给出 \(P(X \leq x) = 0.5\) 时的 \(x\) 值。

连续分布的众数

对于连续分布,我们可以使用 optimize 函数。例如,寻找 \(Gamma(6,1)\) 分布的众数(我们将在下一章介绍此分布),其 PDF 与 \(x^5 e^{-x}\) 成正比。通过微积分可知众数在 \(x=5\) 处。在 R 中验证如下:

R

1 | h <- function(x) x^5 * exp(-x) |

如果要寻找最小值而非最大值,只需设置 maximum=FALSE。

离散分布的示例

关于 \(Bin(n,p)\) 分布的一个有趣事实是:如果均值 \(np\) 是整数,那么中位数和众数也都是 \(np\)(即使分布非常偏斜)。

验证 \(Bin(50, 0.2)\) 的中位数:

R

1 | n <- 50; p <- 0.2 |

which.max 函数寻找向量中最大值出现的第一处位置。由于 TRUE 编码为 1,FALSE 编码为 0,这将返回 CDF 首次大于或等于 0.5 的索引。返回值为 11,但由于我们是从 0 开始评估的,索引 11 对应的中位数其实是 10。

同样地,which.max(dbinom(0:n, n, p)) 返回 11,表明众数也是 10。

样本中位数与众数

- 样本中位数:使用

median(x)。 - 样本众数:注意 R 中的

mode(x)函数返回的是对象的类型(如 "numeric"),而不是统计学上的众数。要找到样本众数(包括存在多个众数的情况),可以自定义如下函数:

R

1 | datamode <- function(x) { |

对数正态分布与 Weibull 分布

对数正态分布 (Log-Normal)

类似于正态分布的 dnorm、pnorm 和 rnorm 函数,R 提供了 dlnorm(PDF)、plnorm(CDF)和 rlnorm(随机生成)来处理对数正态分布。这些函数使用的参数是其底层正态分布的均值(mean)和标准差(sd)。

例如,dlnorm(x, 1, 2) 给出的是 \(LN(1, 4)\) 分布的 PDF(注意:方差是 \(2^2=4\),而不是均值为 1 的分布)。由于正态分布与对数正态分布之间的指数关系,代码 rlnorm(n, mu, sigma) 等同于 exp(rnorm(n, mu, sigma))。

Weibull 分布

对于 Weibull 分布,我们可以分别使用 dweibull、pweibull 和 rweibull 函数。R 中的参数化方法与本章教材略有不同,但转换非常简单:对于 \(Wei(\lambda, \gamma)\) 分布,令 R 中的形状参数(shape)\(a = \gamma\),尺度参数(scale)\(b = \lambda^{-1/\gamma}\)。

那么 dweibull(x, a, b) 即给出 \(Wei(\lambda, \gamma)\) 的 PDF。由于指数分布与 Weibull 分布的联系,生成 \(Wei(\lambda, \gamma)\) 随机变量的另一种方法是:先生成 \(Expo(\lambda)\) 变量,然后将其提升到 \(1/\gamma\) 次幂。

骰子模拟 (Dice Simulation)

在带星号的 6.7 节中,我们通过复杂的概率生成函数证明了:掷 6 枚公平骰子,点数总和为 18 的概率是 \(3431/6^6 \approx 0.07354\)。

如果我们只需要一个近似解,模拟(Simulation)是一种简单得多的方法。以下是进行一百万次实验的代码:

R

1 | # 模拟掷 6 枚骰子 10^6 次并计算总和 |

在我们的模拟中,得到的结果是 0.07346,这与理论值 0.07354 非常接近。

书籍各章的机翻md文件:

《Introduction to Probability》前言

《Introduction to Probability》第1章 概率与计数

《Introduction to Probability》第 2 章 条件概率

《Introduction to Probability》第3章 随机变量及其分布

《Introduction to Probability》第4章 期望

《Introduction to Probability》第5章 连续随机变量

《Introduction to Probability》第 6 章 矩

《Introduction to Probability》第7 章 联合分布

《Introduction to Probability》第8章 变换

《Introduction to Probability》第9章 条件期望

《Introduction to Probability》第10章 不等式与极限理论

《Introduction to Probability》第11章 马尔可夫链

《Introduction to Probability》第12章 马尔可夫链蒙特卡罗

《Introduction to Probability》第13章 泊松过程