《Introduction to Probability》第5章 连续随机变量

第5章 连续随机变量

Continuous random variables

到目前为止,我们一直在研究离散随机变量,其可能的值可以列成一张清单。在本章中,我们将讨论连续随机变量,它们可以取区间内的任何实数值(区间长度可能是无限的,例如 \((0, \infty)\) 或整个实数轴)。首先,我们将考察连续随机变量的普遍性质。然后,我们将介绍三种著名的连续分布——均匀分布(Uniform)、正态分布(Normal)和指数分布(Exponential)——它们除了拥有各自重要的背景故事外,还作为许多其他有用的连续分布的构建基石。

5.1 概率密度函数

Probability density functions

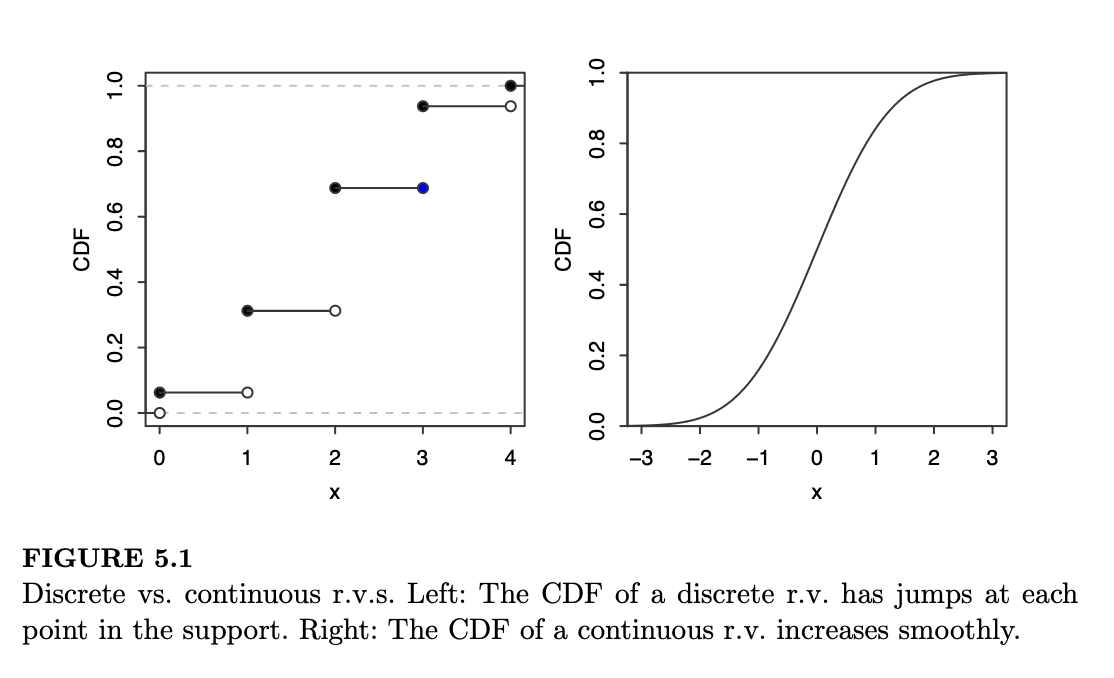

回想一下,对于离散随机变量,其累积分布函数(CDF)在支撑集(support)的每个点处都会发生跳跃,而在其他地方则是平坦的。相比之下,连续随机变量的 CDF 是平滑增长的;离散与连续 CDF 的对比见图 5.1。

定义 5.1.1(连续随机变量)。如果一个随机变量的 CDF 是可微的,则称该随机变量服从连续分布。我们也允许在端点(或有限个点)处 CDF 连续但不可微,只要 CDF 在其他地方都是可微的即可。连续随机变量是指服从连续分布的随机变量。

对于离散随机变量,CDF 处理起来很麻烦,因为它具有跳跃性,而且它的导数几乎毫无用处,因为导数在跳跃点处无定义,在其他地方则为 0。但对于连续随机变量,CDF 通常处理起来很方便,并且它的导数是一个非常有用的函数,称为概率密度函数。

定义 5.1.2(概率密度函数)。对于一个 CDF 为 \(F\) 的连续随机变量 \(X\),\(X\) 的概率密度函数(PDF)是 CDF 的导数 \(f\),由 \(f(x) = F'(x)\) 给出。\(X\) 及其分布的支撑集是所有使得 \(f(x) > 0\) 的 \(x\) 的集合。

连续随机变量与离散随机变量的一个重要区别在于,对于连续随机变量 \(X\),对所有的 \(x\) 都有 \(P(X = x) = 0\)。这是因为 \(P(X = x)\) 是 CDF 在 \(x\) 处跳跃的高度,而 \(X\) 的 CDF 没有跳跃!由于连续随机变量的 PMF 在任何地方都只是 0,因此我们改用 PDF。

PDF 在许多方面与 PMF 类似,但有一个关键区别:对于 PDF \(f\),数值 \(f(x)\) 并不是概率,事实上,在某些 \(x\) 值处 \(f(x) > 1\) 是可能的。为了获得概率,我们需要对 PDF 进行积分。微积分基本定理告诉我们如何从 PDF 回到 CDF。

命题 5.1.3(PDF 到 CDF)。设 \(X\) 是一个 PDF 为 \(f\) 的连续随机变量。则 \(X\) 的 CDF 由下式给出: \[ F(x) = \int_{-\infty}^{x} f(t) dt \]

证明: 根据 PDF 的定义,\(F\) 是 \(f\) 的一个原函数。因此根据微积分基本定理: \[ \int_{-\infty}^{x} f(t) dt = F(x) - F(-\infty) = F(x) \]

上述结果类比于我们如何通过对所有小于或等于 \(x\) 的值求 PMF 之和来获得离散 CDF 在 \(x\) 处的值;在这里,我们是对 PDF 在截至 \(x\) 的所有值上进行积分,因此 CDF 就是 PDF 下方的累积面积。由于我们可以使用积分和微分这对逆运算在 PDF 和 CDF 之间自由转换,因此 PDF 和 CDF 都包含了关于连续随机变量分布的完整信息。

由于 PDF 决定了分布,我们应该能够利用它来求出 \(X\) 落入区间 \((a, b)\) 的概率。一个便利的事实是,我们可以根据意愿包含或排除端点,而不会改变概率,因为端点的概率为 0: \[ P(a < X < b) = P(a < X \le b) = P(a \le X < b) = P(a \le X \le b) \]

5.1.4(包含或排除端点)。对于连续随机变量,我们可以像上面那样不拘泥于包含或排除端点,但对于离散随机变量,我们绝不能对此掉以轻心。

根据 CDF 的定义和微积分基本定理: \[ P(a < X \le b) = F(b) - F(a) = \int_{a}^{b} f(x) dx \]

因此,要利用 PDF 求 \(X\) 落入区间 \((a, b]\)(或 \((a, b)\)、\([a, b)\)、\([a, b]\))的概率,我们只需对 PDF 从 \(a\) 到 \(b\) 进行积分。一般而言,对于任意区域 \(A \subseteq \mathbb{R}\): \[ P(X \in A) = \int_{A} f(x) dx \]

总结:

若要得到所需的概率,请在相应的范围内对 PDF 进行积分。

正如一个有效的 PMF 必须非负且总和为 1,一个有效的 PDF 也必须非负且积分值为 1。

定理 5.1.5(有效 PDF)。连续随机变量的 PDF \(f\) 必须满足以下两个标准:

- 非负性:\(f(x) \ge 0\);

- 积分为 1:\(\int_{-\infty}^{\infty} f(x) dx = 1\)。

证明: 第一个标准成立是因为概率是非负的;如果 \(f(x_0)\) 为负,那么我们可以对 \(x_0\) 周围的一个微小区域进行积分,从而得到一个负概率。或者,注意到 \(x_0\) 处的 PDF 是 CDF 在 \(x_0\) 处的斜率,因此 \(f(x_0) < 0\) 将意味着 CDF 在 \(x_0\) 处递减,这是不允许的。第二个标准成立是因为 \(\int_{-\infty}^{\infty} f(x) dx\) 是 \(X\) 落在实数轴上某处的概率,即 1。

反之,任何满足此类条件的函数 \(f\) 都是某个随机变量的 PDF。这是因为如果 \(f\) 满足这些性质,我们可以按照命题 5.1.3 对其进行积分,从而得到一个满足 CDF 性质的函数 \(F\)。然后,利用第 5.3 节的核心概念——均匀分布的普适性(Universality of the Uniform)的一个版本,即可构造出一个以 \(F\) 为 CDF 的随机变量。

现在让我们来看一些具体的 PDF 例子。以下示例中的两种分布分别命名为逻辑斯谛分布(Logistic)和瑞利分布(Rayleigh),但我们在这里不讨论它们的背景故事;引入它们主要是为了让大家熟悉 PDF。

例 5.1.6(逻辑斯谛分布)。逻辑斯谛分布的 CDF 为: \[ F(x) = \frac{e^x}{1 + e^x}, \quad x \in \mathbb{R} \]

为了得到 PDF,我们对 CDF 求导,得出: \[ f(x) = \frac{e^x}{(1 + e^x)^2}, \quad x \in \mathbb{R} \]

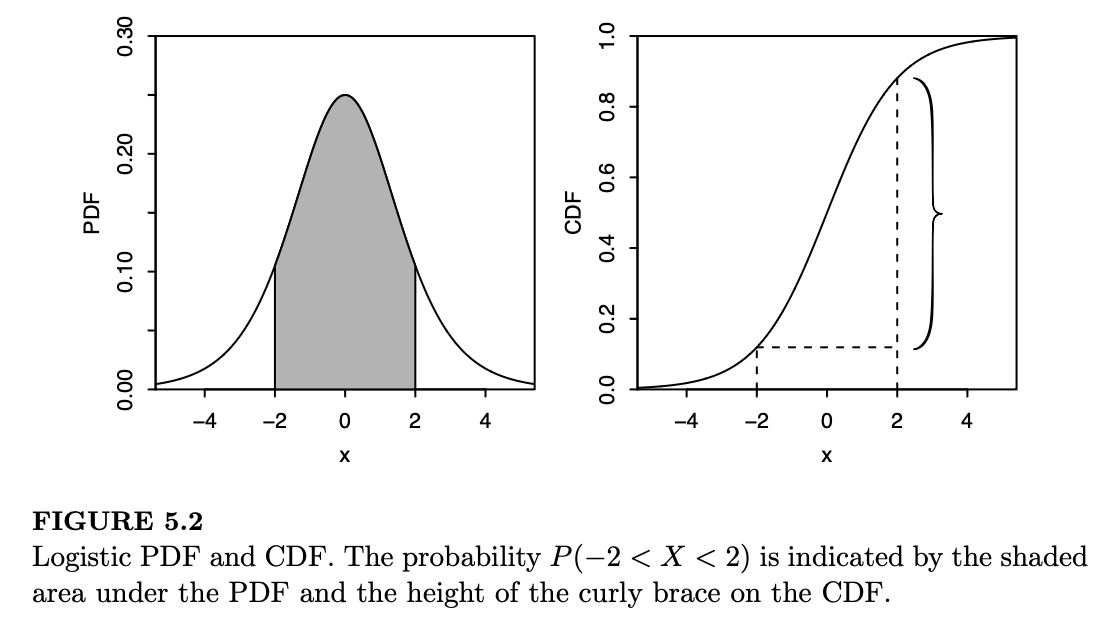

设 \(X \sim \text{Logistic}\)。要求 \(P(-2 < X < 2)\),需对 PDF 从 \(-2\) 到 \(2\) 进行积分: \[ P(-2 < X < 2) = \int_{-2}^{2} \frac{e^x}{(1 + e^x)^2} dx = F(2) - F(-2) \approx 0.76 \]

由于我们已经知道 \(F\) 是 \(f\) 的一个原函数,并且 \(F\) 的表达式非常简洁,所以这个积分很容易求值。否则,我们可以通过代换 \(u = 1 + e^x\),则 \(du = e^x dx\),得出: \[ \int_{-2}^{2} \frac{e^x}{(1 + e^x)^2} dx = \int_{1+e^{-2}}^{1+e^2} \frac{1}{u^2} du = -\frac{1}{u} \bigg|_{1+e^{-2}}^{1+e^2} \approx 0.76 \]

图 5.2 展示了逻辑斯谛分布的 PDF(左)和 CDF(右)。在 PDF 图中,概率 \(P(-2 < X < 2)\) 由阴影区域表示;在 CDF 图中,它由花括号的高度表示。你可以验证有效的 PDF 和 CDF 的性质是否均得到满足。

例 5.1.7(瑞利分布)。瑞利分布的 CDF 为: \[ F(x) = 1 - e^{-x^2/2}, \quad x > 0 \]

为了得到 PDF,我们对 CDF 求导,得出: \[ f(x) = x e^{-x^2/2}, \quad x > 0 \]

对于 \(x \le 0\),CDF 和 PDF 均等于 0。

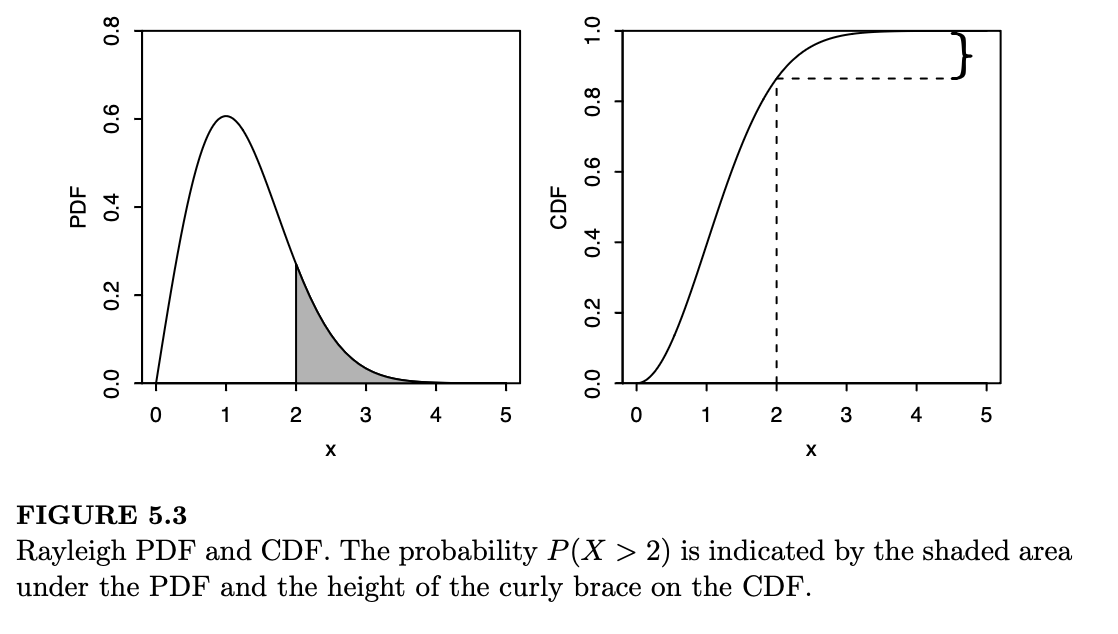

设 \(X \sim \text{Rayleigh}\)。要求 \(P(X > 2)\),我们需要对 PDF 从 \(2\) 到 \(\infty\) 进行积分。我们可以通过代换 \(u = -x^2/2\) 来完成,但既然我们已经有了形式简洁的 CDF,我们知道积分结果就是 \(F(\infty) - F(2) = 1 - F(2)\): \[ P(X > 2) = \int_{2}^{\infty} x e^{-x^2/2} dx = 1 - F(2) \approx 0.14 \]

瑞利分布的 PDF 和 CDF 绘制在图 5.3 中。同样,概率在 PDF 上表现为阴影区域面积,在 CDF 上表现为垂直高度。

虽然 PDF 在 \(x\) 处的高度并不代表概率,但它与落在 \(x\) 周围微小区间内的概率密切相关,正如以下直觉所解释的。

直觉 5.1.8(单位)。令 \(F\) 为连续随机变量 \(X\) 的 CDF,\(f\) 为其 PDF。如前所述,\(f(x)\) 不是概率;例如,我们可能得到 \(f(3) > 1\),而我们知道 \(P(X = 3) = 0\)。但思考 \(X\) 非常接近 3 的概率可以让我们找到一种解释 \(f(3)\) 的方式。具体而言,\(X\) 落在以 3 为中心、长度为 \(\epsilon\) 的微小区间内的概率本质上将是 \(f(3)\epsilon\)。这是因为: \[ P(3 - \epsilon/2 < X < 3 + \epsilon/2) = \int_{3-\epsilon/2}^{3+\epsilon/2} f(x) dx \approx f(3)\epsilon \]

前提是该区间非常微小,以至于 \(f\) 在该区间上近似为常数 \(f(3)\)。一般而言,我们可以将 \(f(x)dx\) 视为 \(X\) 落在包含 \(x\) 且长度为 \(dx\) 的极小区间内的概率。

在实践中,\(X\) 通常在某些测量系统中具有单位,例如距离、时间、面积或质量的单位。思考单位不仅在应用问题中很重要,而且通常有助于检查答案是否合理。具体而言,假设 \(X\) 是长度,以厘米(cm)为单位。那么 \(f(x) = dF(x)/dx\) 是 \(x\) 处单位厘米对应的概率,这解释了为什么 \(f(x)\) 是概率密度。概率是一个无量纲量(没有物理单位的数字),因此 \(f(x)\) 的单位是 \(\text{cm}^{-1}\)。因此,为了再次获得概率,我们需要将 \(f(x)\) 乘以一个长度。当我们进行如 \(\int_{0}^{5} f(x) dx\) 这样的积分时,这是通过经常被忽略的 \(dx\) 来实现的。

个人注:思考单位不仅在应用问题中很重要,而且通常有助于检查答案是否合理。

这句话很有用!在问题的处理中,通过答案的单位来检查结果的合理性。

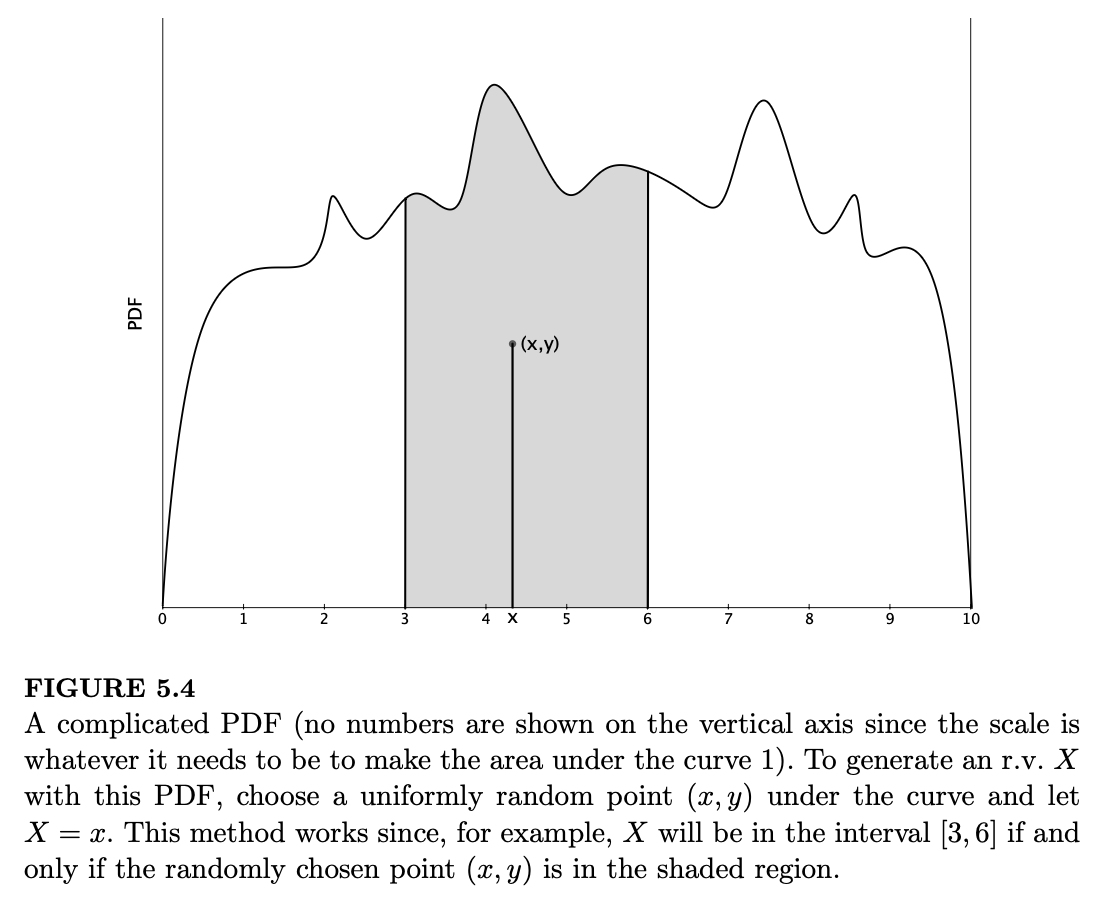

直觉 5.1.9(模拟)。关于 PDF 的另一种直观思考方式是,考虑以下基于观察 PDF 图形来模拟从连续分布中抽取 \(X\) 的图形化方法。要生成 \(X\),在 PDF 曲线下方的区域内随机均匀地选择一个点;这意味着曲线下方任何区域被选中的概率就是该区域的面积。然后令 \(X\) 为该随机点的 \(x\) 坐标。如图 5.4 所示。

那么 \(X\) 就具有所需的分布,因为根据构造,\(P(a \le X \le b)\) 是 \(x=a\) 和 \(x=b\) 两条直线之间 PDF 曲线下方的面积。思考这种方法有助于建立对 PDF 的直观理解,让我们对根据特定 PDF 曲线采样的随机变量有感性认识。

连续随机变量期望的定义与离散随机变量的定义类似:将求和替换为积分,将 PMF 替换为 PDF。

定义 5.1.10(连续随机变量的期望)。一个 PDF 为 \(f\) 的连续随机变量 \(X\) 的期望值(也称为期望或均值)为: \[ E(X) = \int_{-\infty}^{\infty} xf(x)dx \]

与离散情况一样,连续随机变量的期望可能存在,也可能不存在。在讨论期望时,如果每提到一个尚未证明存在的期望都要在后面加上“(如果存在)”,那将非常繁琐,因此我们通常会省略这一点。

积分是在整个实数轴上进行的,但如果 \(X\) 的支撑集不是整个实数轴,我们只需对支撑集进行积分。这个定义中的单位是合理的:如果 \(X\) 以厘米为单位测量,那么 \(E(X)\) 也是如此,因为 \(xf(x)dx\) 的单位是 \(\text{cm} \cdot \text{cm}^{-1} \cdot \text{cm} = \text{cm}\)。

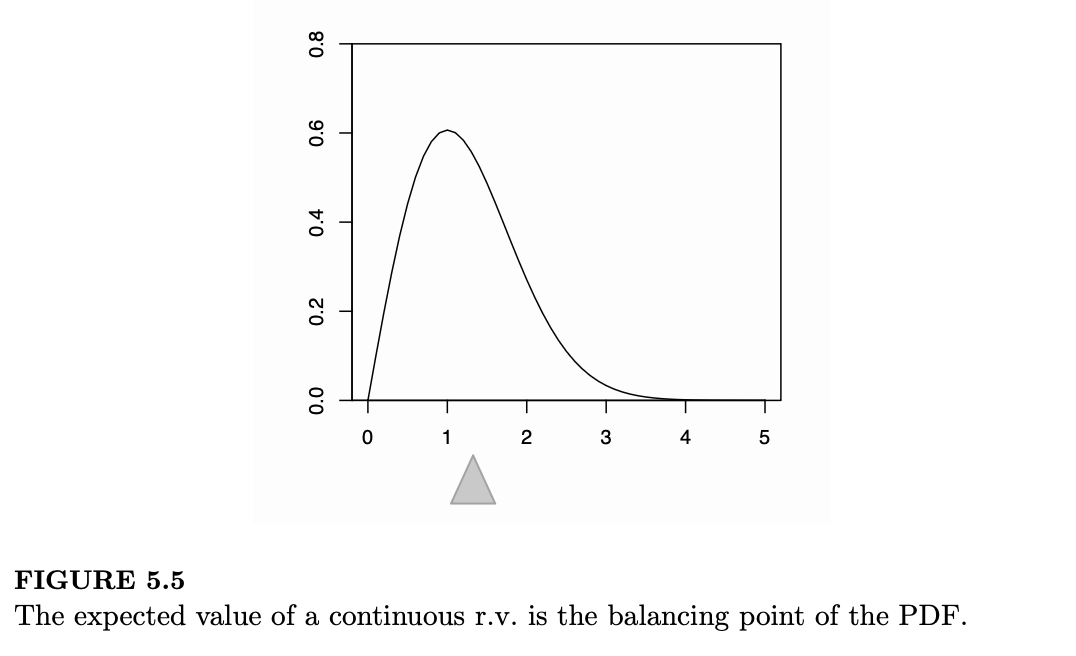

根据这个定义,期望值保留了其作为质量中心的解释。如图 5.5 所示(以瑞利分布的 PDF 为例进行说明),期望值是 PDF 的平衡点,就像离散情况中它是 PMF 的平衡点一样。

期望的线性性质对连续随机变量同样成立,就像对离散随机变量一样(我们稍后将在例 7.2.4 中证明这一点)。LOTUS(无意识统计学家法则)对连续随机变量也成立,只需将求和替换为积分,并将 PMF 替换为 PDF:

定理 5.1.11(LOTUS,连续型)。如果 \(X\) 是一个 PDF 为 \(f\) 的连续随机变量,且 \(g\) 是一个从 \(\mathbb{R}\) 到 \(\mathbb{R}\) 的函数,则: \[ E(g(X)) = \int_{-\infty}^{\infty} g(x)f(x)dx \]

我们现在已经掌握了处理本章命名分布所需的所有工具,从均匀分布开始。

5.2 均匀分布

Uniform

直观地说,区间 \((a, b)\) 上的均匀随机变量是 \(a\) 到 \(b\) 之间的完全随机数。我们通过规定 PDF 在该区间上为常数,将区间上“完全随机”的概念正式化。

定义 5.2.1(均匀分布)。如果连续随机变量 \(U\) 的 PDF 为: \[ f(x) = \begin{cases} \frac{1}{b-a} & \text{若 } a < x < b, \\ 0 & \text{其他.} \end{cases} \]

则称 \(U\) 服从区间 \((a, b)\) 上的均匀分布。我们记作 \(U \sim \text{Unif}(a, b)\)。

这是一个有效的 PDF,因为曲线下方的面积就是一个宽为 \(b-a\)、高为 \(1/(b-a)\) 的矩形的面积。CDF 是 PDF 下方的累积面积: \[ F(x) = \begin{cases} 0 & \text{若 } x \le a, \\ \frac{x-a}{b-a} & \text{若 } a < x < b, \\ 1 & \text{若 } x \ge b. \end{cases} \]

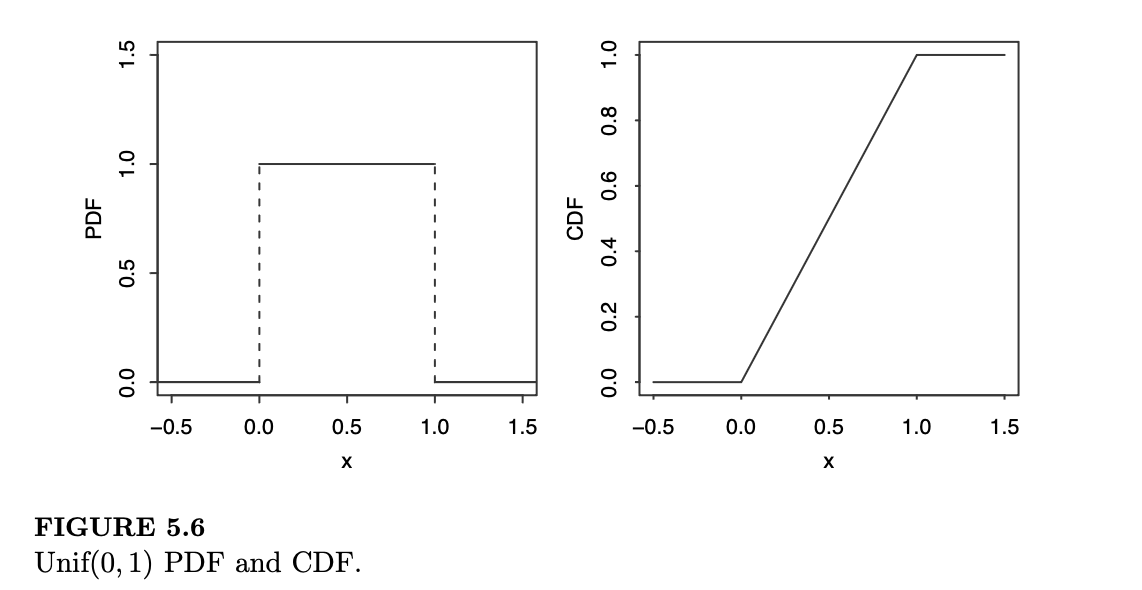

我们最常用的均匀分布是 \(\text{Unif}(0, 1)\) 分布,也称为标准均匀分布。\(\text{Unif}(0, 1)\) 的 PDF 和 CDF 特别简单:在 \(0 < x < 1\) 时,\(f(x) = 1\) 且 \(F(x) = x\)。图 5.6 并列展示了 \(\text{Unif}(0, 1)\) 的 PDF 和 CDF。

对于一般的 \(\text{Unif}(a, b)\) 分布,PDF 在 \((a, b)\) 上是常数,而 CDF 呈斜坡状,随着 \(x\) 从 \(a\) 到 \(b\) 变化,CDF 从 0 线性增加到 1。

对于均匀分布,概率与长度成正比。

命题 5.2.2。令 \(U \sim \text{Unif}(a, b)\),并令 \((c, d)\) 为 \((a, b)\) 的子区间,长度为 \(l\)(即 \(l = d - c\))。那么 \(U\) 落在 \((c, d)\) 内的概率与 \(l\) 成正比。例如,长度为两倍的子区间,其包含 \(U\) 的概率也是两倍;长度相同的子区间,其概率也相同。

证明: 由于 \(U\) 的 PDF 在 \((a, b)\) 上是常数 \(\frac{1}{b-a}\),因此从 \(c\) 到 \(d\) 曲线下的面积为 \(\frac{l}{b-a}\),这是一个常数乘以 \(l\)。

上述命题是均匀分布的一个非常特殊的性质;对于任何其他分布,都存在长度相同但概率不同的区间。即使在给定均匀随机变量落在某个子区间的条件下,我们仍然得到一个均匀分布,因此(在该子区间内)概率仍然与长度成正比;我们在下面证明这一点。

命题 5.2.3。令 \(U \sim \text{Unif}(a, b)\),并令 \((c, d)\) 为 \((a, b)\) 的一个子区间。那么在给定 \(U \in (c, d)\) 的条件下,\(U\) 的条件分布为 \(\text{Unif}(c, d)\)。

证明: 对于 \((c, d)\) 中的 \(u\),条件 CDF 在 \(u\) 处为: \[ P(U \le u | U \in (c, d)) = \frac{P(U \le u, c < U < d)}{P(U \in (c, d))} = \frac{P(c < U \le u)}{P(c < U < d)} = \frac{\frac{u-c}{b-a}}{\frac{d-c}{b-a}} = \frac{u-c}{d-c} \]

对于 \(u \le c\),条件 CDF 为 0;对于 \(u \ge d\),条件 CDF 为 1。因此 \(U\) 的条件分布如前所述。

例 5.2.4。让我们以 \(U \sim \text{Unif}(0,1)\) 为例说明上述命题。在这种特殊情况下,支撑集的长度为 1,因此概率即长度:\(U\) 落在区间 \((0, 0.3)\) 的概率是 0.3,落在 \((0.3, 0.6)\)、\((0.4, 0.7)\) 或 \((0, 1)\) 内任何其他长度为 0.3 的区间的概率也是 0.3。

现在假设我们得知 \(U \in (0.4, 0.7)\)。在这个信息下,\(U\) 的条件分布为 \(\text{Unif}(0.4, 0.7)\)。那么 \(U \in (0.4, 0.6)\) 的条件概率为 \(2/3\),因为 \((0.4, 0.6)\) 占据了 \((0.4, 0.7)\) 长度的 \(2/3\)。\(U \in (0, 0.6)\) 的条件概率同样是 \(2/3\),因为在以 \(U \in (0.4, 0.7)\) 为条件时,我们排除了 0.4 左侧的点。

接下来,让我们推导 \(U \sim \text{Unif}(a, b)\) 的均值和方差。期望是非常直观的:PDF(概率密度函数)是常数,所以其平衡点应该是 \((a, b)\) 的中点。这正是我们通过连续随机变量期望的定义所得到的结果: \[ E(U) = \int_{a}^{b} x \cdot \frac{1}{b-a} dx = \frac{1}{b-a} \left[ \frac{b^2}{2} - \frac{a^2}{2} \right] = \frac{a+b}{2} \]

对于方差,我们首先利用连续版本的 LOTUS(无意识统计学家法则)求出 \(E(U^2)\): \[ E(U^2) = \int_{a}^{b} x^2 \frac{1}{b-a} dx = \frac{1}{b-a} \cdot \frac{1}{3} (b^3 - a^3) \]

那么 \[ \text{Var}(U) = E(U^2) - (EU)^2 = \frac{1}{3} \cdot \frac{b^3 - a^3}{b-a} - \left( \frac{a+b}{2} \right)^2 \]

通过因式分解 \(b^3 - a^3 = (b-a)(a^2 + ab + b^2)\) 并化简后,可得: \[ \text{Var}(U) = \frac{(b-a)^2}{12} \]

上述推导并不算太痛苦,但还有一条更简单的路径,即使用一种在处理连续分布时非常有用的技巧。该技术被称为位置-尺度变换(location-scale transformation),它基于这样一个观察:对一个均匀分布随机变量进行平移和缩放会产生另一个均匀分布随机变量。平移被视为位置的改变,缩放被视为尺度的改变,因此称为“位置-尺度”。例如,如果 \(X\) 在区间 \((1, 2)\) 上服从均匀分布,那么 \(X+5\) 在区间 \((6, 7)\) 上服从均匀分布,\(2X\) 在区间 \((2, 4)\) 上服从均匀分布,而 \(2X+5\) 在 \((7, 9)\) 上服从均匀分布。

定义 5.2.5(位置-尺度变换)。设 \(X\) 为一个随机变量,\(Y = \sigma X + \mu\),其中 \(\sigma\) 和 \(\mu\) 是常数且 \(\sigma > 0\)。那么我们说 \(Y\) 是通过 \(X\) 的位置-尺度变换得到的。这里 \(\mu\) 控制位置如何改变,\(\sigma\) 控制尺度如何改变。

5.2.6。在位置-尺度变换中,从 \(X \sim \text{Unif}(a, b)\) 开始并将其转换为 \(Y = cX + d\)(其中 \(c\) 和 \(d\) 是常数且 \(c > 0\)),\(Y\) 是 \(X\) 的线性函数,且均匀性得以保持:\(Y \sim \text{Unif}(ca+d, cb+d)\)。但如果 \(Y\) 被定义为 \(X\) 的非线性变换,那么 \(Y\) 通常不再服从均匀分布。例如,对于 \(0 \le a < b\) 的 \(X \sim \text{Unif}(a, b)\),变换后的随机变量 \(Y = X^2\) 的支撑集为 \((a^2, b^2)\),但在该区间上并不服从均匀分布。第 8 章将详细探讨随机变量的变换。

在研究均匀分布时,一种有用的策略是从具有最简单均匀分布的随机变量开始,在这个友好的简单案例中解决问题,然后利用位置-尺度变换来处理一般情况。

让我们看看这种方法是如何用于寻找 \(\text{Unif}(a,b)\) 分布的期望和方差的。位置-尺度策略建议从 \(U \sim \text{Unif}(0,1)\) 开始。由于 \(U\) 的 PDF 在区间 \((0,1)\) 上仅为 1,因此很容易看出: \[ E(U) = \int_{0}^{1} x \, dx = \frac{1}{2} \]

\[ E(U^2) = \int_{0}^{1} x^2 \, dx = \frac{1}{3} \]

\[ \text{Var}(U) = \frac{1}{3} - \frac{1}{4} = \frac{1}{12} \]

既然我们已经知道了 \(U\) 的答案,将 \(U\) 转换为一般的 \(\text{Unif}(a,b)\) 随机变量只需两步。首先,我们将支撑集从长度为 1 的区间更改为长度为 \(b-a\) 的区间,因此我们将 \(U\) 乘以缩放因子 \(b-a\),从而得到一个 \(\text{Unif}(0, b-a)\) 随机变量。然后,我们平移所有内容,直到支撑集的左端点位于 \(a\)。因此,如果 \(U \sim \text{Unif}(0,1)\),则随机变量 \[ \tilde{U} = a + (b-a)U \]

服从 \(\text{Unif}(a,b)\) 分布。现在 \(\tilde{U}\) 的均值和方差可以直接从期望和方差的性质推导出来。根据期望的线性性质: \[ E(\tilde{U}) = E(a + (b-a)U) = a + (b-a)E(U) = a + \frac{b-a}{2} = \frac{a+b}{2} \]

根据“加法常数不影响方差,而乘法常数以平方形式提出”的事实: \[ \text{Var}(\tilde{U}) = \text{Var}(a + (b-a)U) = \text{Var}((b-a)U) = (b-a)^2 \text{Var}(U) = \frac{(b-a)^2}{12} \]

这些结果与我们之前的答案一致。

位置-尺度变换技术适用于任何满足以下条件的分布族:对该族中的随机变量进行平移和缩放,产生的另一个随机变量的分布仍在该族中。该技术不适用于(具有固定支撑集的)离散分布族,因为例如,平移或缩放 \(X \sim \text{Bin}(n,p)\) 会改变其支撑集,并产生一个不再服从二项分布的随机变量。二项随机变量必须能够取 0 到某个上界之间的所有整数值,但 \(X+4\) 无法取 \(\{0,1,2,3\}\) 中的任何值,而 \(2X\) 只能取偶数值,因此这两个随机变量都不具有二项分布。

5.2.7(提防交感巫术)。在使用位置-尺度变换时,平移和缩放应应用于随机变量本身,而不是它们的 PDF。将这两者混淆将是“交感巫术”(见 3.7.7)的一个实例,并会导致无效的 PDF。例如,设 \(U \sim \text{Unif}(0,1)\),其 PDF \(f\) 在 \((0,1)\) 上满足 \(f(x)=1\)(在其他地方为 0)。那么 \(3U+1 \sim \text{Unif}(1,4)\),但 \(3f+1\) 是一个在 \((0,1)\) 上等于 4、在其他地方等于 1 的函数,这不是一个有效的 PDF,因为它的积分不等于 1。

5.3 均匀分布的普适性

Universality of the Uniform

在本节中,我们将讨论均匀分布的一个卓越性质:给定一个 \(U \sim \text{Unif}(0,1)\) 随机变量,我们可以构造出具有任何我们想要的连续分布的随机变量。反之,给定一个具有任意连续分布的随机变量,我们也可以创建一个 \(\text{Unif}(0,1)\) 随机变量。我们称之为均匀分布的普适性(universality of the Uniform),因为它告诉我们均匀分布是构建其他分布随机变量的通用起点。

均匀分布的普适性还有许多其他名称,例如概率积分变换(probability integral transform)、逆变换采样(inverse transform sampling)、分位数变换(quantile transformation),甚至被称为模拟基本定理(fundamental theorem of simulation)。

为了保持证明的简洁,我们将针对已知所需累积分布函数(CDF)的逆函数存在的情况来阐述均匀分布的普适性。类似的思想可以用于模拟任何所需 CDF 的随机抽取,将其作为 \(Unif(0,1)\) 随机变量的函数。

定理 5.3.1(均匀分布的普适性)。设 \(F\) 为一个 CDF,它是连续函数且在分布的支撑集上严格递增。这确保了逆函数 \(F^{-1}\) 存在,作为从 \((0,1)\) 到 \(\mathbb{R}\) 的函数。那么我们有以下结果:

- 设 \(U \sim \text{Unif}(0,1)\) 且 \(X = F^{-1}(U)\)。那么 \(X\) 是一个 CDF 为 \(F\) 的随机变量。

- 设 \(X\) 是一个 CDF 为 \(F\) 的随机变量。那么 \(F(X) \sim \text{Unif}(0,1)\)。

让我们确保理解定理各部分的含义。第一部分指出,如果我们从 \(U \sim \text{Unif}(0,1)\) 和一个 CDF \(F\) 开始,那么我们可以通过将 \(U\) 代入逆 CDF \(F^{-1}\) 来创建一个 CDF 为 \(F\) 的随机变量。由于 \(F^{-1}\) 是一个函数(称为分位数函数),\(U\) 是一个随机变量,且随机变量的函数也是随机变量,因此 \(F^{-1}(U)\) 是一个随机变量;均匀分布的普适性说明它的 CDF 就是 \(F\)。

定理的第二部分方向相反,从一个 CDF 为 \(F\) 的随机变量 \(X\) 开始,然后创建一个 \(\text{Unif}(0,1)\) 随机变量。同样,\(F\) 是一个函数,\(X\) 是一个随机变量,随机变量的函数也是随机变量,所以 \(F(X)\) 是一个随机变量。由于任何 CDF 在各处的取值都在 0 到 1 之间,因此 \(F(X)\) 必须取 0 到 1 之间的值。均匀分布的普适性说明 \(F(X)\) 的分布在 \((0,1)\) 上是均匀的。

5.3.2。均匀分布普适性的第二部分涉及将随机变量 \(X\) 代入其自身的 CDF \(F\) 中。这看起来似乎是奇怪的自我引用,但它是有意义的,因为 \(F\) 只是一个函数(满足有效 CDF 的性质),而随机变量的函数仍是随机变量。然而,存在潜在的符号混淆:根据定义 \(F(x) = P(X \le x)\),但如果说 “\(F(X) = P(X \le X) = 1\)” 是错误的。相反,我们应该先找到作为 \(x\) 的函数的 CDF 表达式,然后将 \(x\) 替换为 \(X\) 以获得一个随机变量。例如,如果 \(X\) 的 CDF 为 \(F(x) = 1 - e^{-x}\) (\(x > 0\)),那么 \(F(X) = 1 - e^{-X}\)。

理解定理的陈述是困难的部分;每个方向的证明只需寥寥几行。

证明:

- 设 \(U \sim \text{Unif}(0,1)\) 且 \(X = F^{-1}(U)\)。对于所有实数 \(x\),

\[ P(X \le x) = P(F^{-1}(U) \le x) = P(U \le F(x)) = F(x) \]

因此 \(X\) 的 CDF 是 \(F\),正如所言。在最后一个等号中,我们利用了当 \(u \in (0,1)\) 时 \(P(U \le u) = u\) 的事实。

- 设 \(X\) 的 CDF 为 \(F\),求 \(Y = F(X)\) 的 CDF。由于 \(Y\) 的取值在 \((0,1)\) 中,当 \(y \le 0\) 时 \(P(Y \le y)\) 等于 0,当 \(y \ge 1\) 时等于 1。对于 \(y \in (0,1)\),

\[ P(Y \le y) = P(F(X) \le y) = P(X \le F^{-1}(y)) = F(F^{-1}(y)) = y \]

因此 \(Y\) 具有 \(\text{Unif}(0,1)\) 的 CDF。

为了更深入地理解分位数函数 \(F^{-1}\) 以及均匀分布普适性的含义,让我们来看一个数百万学生都熟悉的例子:考试成绩的百分位数。

例 5.3.3(百分位数)。大量学生参加某场考试,评分范围为 0 到 100 分。设 \(X\) 为一名随机抽取的学生的成绩。在这里,连续分布更易于处理,因此我们使用连续分布来近似成绩的离散分布。假设 \(X\) 是连续的,其 CDF \(F\) 在 \((0, 100)\) 上严格递增。在现实中,学生人数和可能的得分都是有限的,但连续分布可能是一个很好的近似。

假设考试成绩的中位数是 60 分,即一半的学生得分高于 60,另一半低于 60(假设连续分布的一个便利之处在于,我们不需要担心有多少学生的得分恰好等于 60)。也就是说,\(F(60) = 1/2\),或者等价地,\(F^{-1}(1/2) = 60\)。

如果弗雷德(Fred)在考试中得了 72 分,那么他的百分位数就是得分低于 72 分的学生比例。这就是 \(F(72)\),由于 72 高于中位数,所以这个数值在 \((1/2, 1)\) 之间。通常情况下,成绩为 \(x\) 的学生的百分位数为 \(F(x)\)。反之,如果我们从百分位数开始,比如 0.95,那么 \(F^{-1}(0.95)\) 就是对应于该百分位数的成绩。百分位数也被称为分位数(quantile),这就是为什么 \(F^{-1}\) 被称为分位数函数。函数 \(F\) 将成绩转换为分位数,而函数 \(F^{-1}\) 将分位数转换为成绩。

将 \(X\) 代入其自身 CDF 这一奇怪的操作现在有了一个自然的解释:\(F(X)\) 是随机抽取的一名学生所达到的百分位数。通常情况下,考试成绩的分布看起来非常不均匀。例如,没有理由认为有 10% 的成绩分布在 70 到 80 分之间,尽管 \((70, 80)\) 占据了可能成绩范围的 10%。

个人注:

“百分位”的本质就是累积占比。

\[F(x) = P(X \le x)\]

想象把所有学生的成绩从低到高排成一排。如果总共有 100 个人:

- 如果你排在第 85 名(前面有 84 个人比你低,加上你自己是 85 个),那么你的成绩就高于或等于 85% 的人。

- 在概率模型中,这个“85%”就是 \(P(X \le 72) = 0.85\)。

另一方面,学生的百分位数分布是均匀的:普适性性质指出 \(F(X) \sim \text{Unif}(0,1)\)。例如,50% 的学生百分位数至少为 0.5。均匀分布的普适性表达了这样一个事实:10% 的学生百分位数在 0 到 0.1 之间,10% 的学生在 0.1 到 0.2 之间,10% 的学生在 0.2 到 0.3 之间,依此类推——从百分位数的定义来看,这一事实显而易见。

为了说明均匀分布的普适性(Universality of the Uniform),我们将把它应用到前一节中遇到的两个分布:Logistic 分布和 Rayleigh 分布。

例 5.3.4(Logistic 分布的普适性)。Logistic 累积分布函数(CDF)为: \[ F(x) = \frac{e^x}{1 + e^x}, x \in \mathbb{R} \]

假设我们有 \(U \sim \text{Unif}(0,1)\) 并希望生成一个 Logistic 随机变量。普适性的第一部分指出 \(F^{-1}(U) \sim \text{Logistic}\),因此我们首先反转 CDF 以求得 \(F^{-1}\): \[ F^{-1}(u) = \log \frac{u}{1-u} \]

然后我们将 \(U\) 代入 \(u\): \[ F^{-1}(U) = \log \frac{U}{1-U} \]

因此 \(\log \frac{U}{1-U} \sim \text{Logistic}\)。

我们可以直接验证 \(\log \frac{U}{1-U}\) 是否具有所需的 CDF:从 CDF 的定义出发,通过代数运算将 \(U\) 隔离在不等式的一侧,然后使用均匀分布的 CDF。为了练习,让我们进行一次计算: \[ P\left(\log \frac{U}{1-U} \leq x\right) = P\left(\frac{U}{1-U} \leq e^x\right) \]

\[ = P(U \leq e^x(1-U)) \]

\[ = P\left(U \leq \frac{e^x}{1 + e^x}\right) \]

\[ = \frac{e^x}{1 + e^x} \]

这确实是 Logistic 的 CDF。

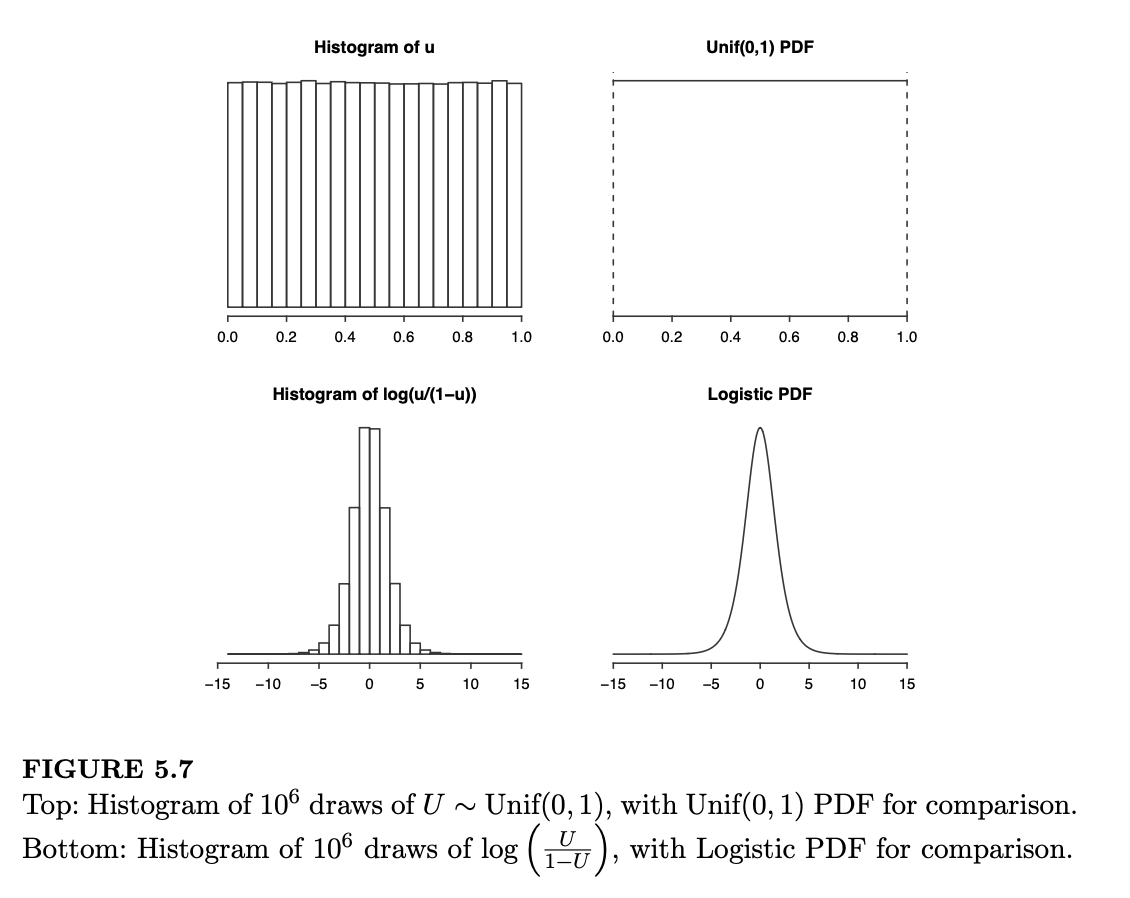

我们还可以通过模拟来直观地观察均匀分布的普适性是如何运作的。为此,我们生成了 100 万个 \(\text{Unif}(0,1)\) 随机变量。然后,我们将这些值中的每一个 \(u\) 转换为 \(\log \frac{u}{1-u}\);如果均匀分布的普适性是正确的,转换后的数字应当服从 Logistic 分布。

图 5.7 展示了 \(U\) 的观测值直方图以及 \(\text{Unif}(0,1)\) 的概率密度函数(PDF);在其下方,是 \(\log \frac{U}{1-U}\) 的观测值直方图以及 Logistic 的 PDF。正如我们所见,第二个直方图看起来非常像 Logistic PDF。因此,通过应用 \(F^{-1}\),我们能够将均匀分布的抽取值转换为 Logistic 抽取值,正如均匀分布的普适性所断言的那样。

反之,普适性的第二部分指出,如果 \(X \sim \text{Logistic}\),那么: \[ F(X) = \frac{e^X}{1 + e^X} \sim \text{Unif}(0,1) \]

例 5.3.5(Rayleigh 分布的普适性)。Rayleigh 分布的累积分布函数(CDF)为: \[ F(x) = 1 - e^{-x^2/2}, x > 0 \]

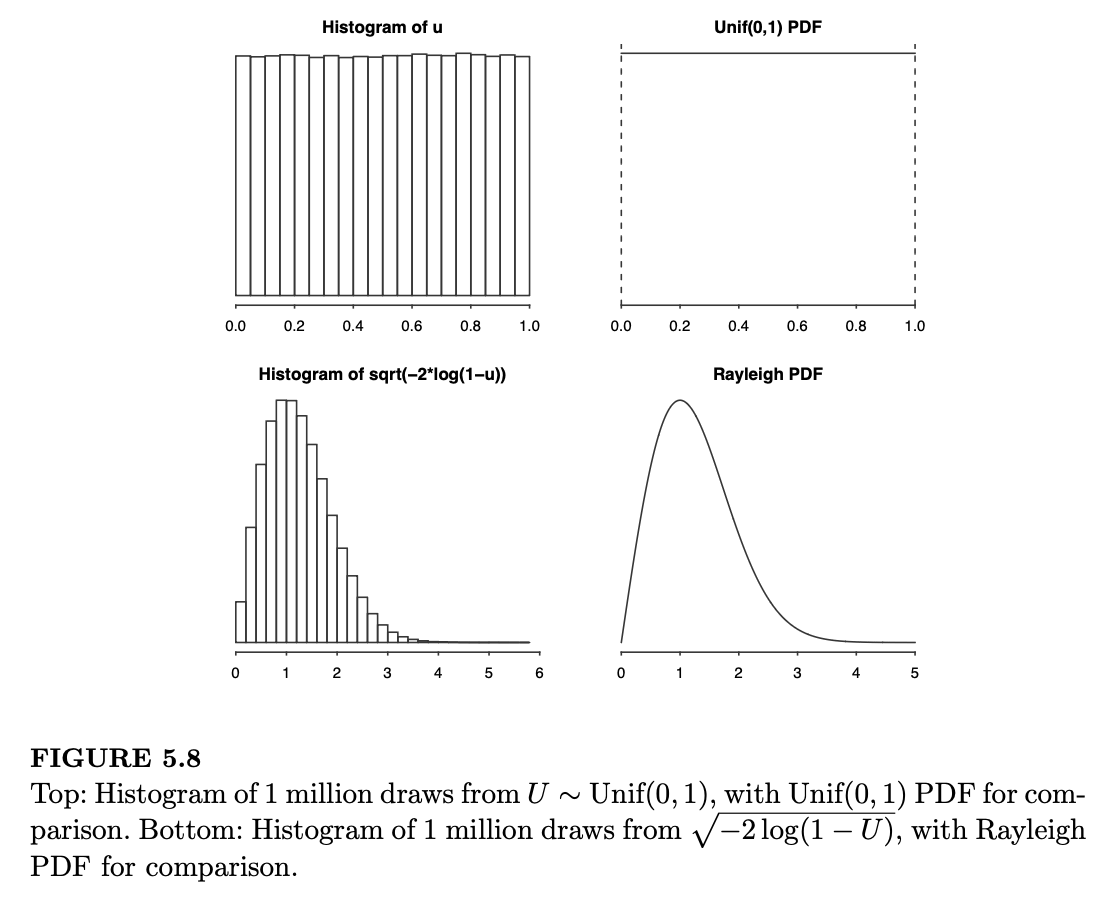

分位数函数(即 CDF 的反函数)为: \[ F^{-1}(u) = \sqrt{-2 \log(1-u)} \]

因此,若 \(U \sim \text{Unif}(0,1)\),则 \(F^{-1}(U) = \sqrt{-2 \log(1-U)} \sim \text{Rayleigh}\)。

我们再次生成了 100 万个 \(U \sim \text{Unif}(0,1)\) 的观测值,并将其转换以产生 100 万个 \(\sqrt{-2 \log(1-U)}\) 的观测值。如图 5.8 所示,正如均匀分布普适性所预测的那样,\(\sqrt{-2 \log(1-U)}\) 的观测值看起来与 Rayleigh 分布的概率密度函数(PDF)非常相似。

反之,若 \(X \sim \text{Rayleigh}\),则 \(F(X) = 1 - e^{-X^2/2} \sim \text{Unif}(0,1)\)。

接下来,让我们考虑均匀分布的普适性在多大程度上适用于离散随机变量。离散随机变量的 CDF \(F\) 具有跳变点和水平区域,因此 \(F^{-1}\)(在通常意义上)并不存在。但第一部分仍然成立,即给定一个均匀分布随机变量,我们可以构造一个具有任何我们想要的离散分布的随机变量。不同之处在于,与其处理不可逆的 CDF,不如直接处理概率质量函数(PMF)更直接。

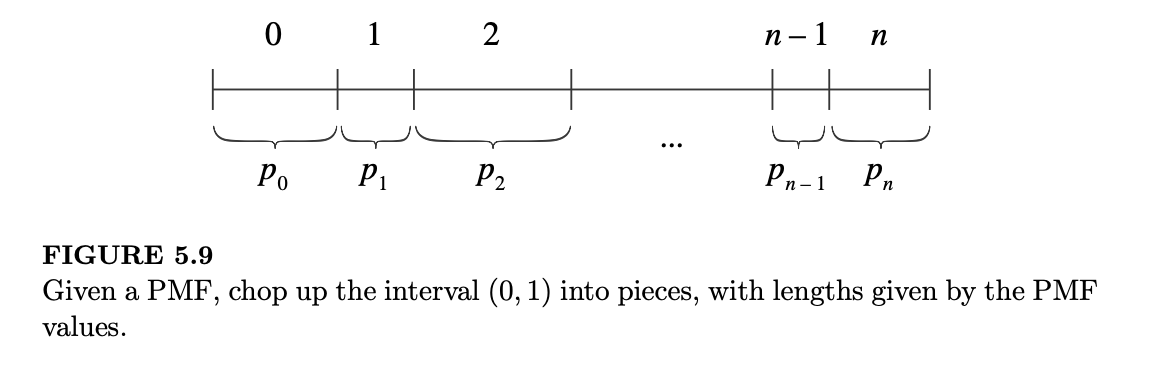

假设我们要使用 \(U \sim \text{Unif}(0,1)\) 来构造一个离散随机变量 \(X\),其 PMF 为 \(p_j = P(X=j)\),其中 \(j = 0, 1, 2, \dots, n\)。如图 5.9 所示,我们可以将区间 \((0,1)\) 切割成长度分别为 \(p_0, p_1, \dots, p_n\) 的片段。根据有效 PMF 的性质,\(p_j\) 的总和为 1,因此这可以完美地划分区间,既不会超出也不会不足。

现在定义随机变量 \(X\):若 \(U\) 落在长度为 \(p_0\) 的区间,则 \(X=0\);若 \(U\) 落在长度为 \(p_1\) 的区间,则 \(X=1\);若 \(U\) 落在长度为 \(p_2\) 的区间,则 \(X=2\),依此类推。那么 \(X\) 就是一个取值为 \(0\) 到 \(n\) 的离散随机变量。\(X=j\) 的概率就是 \(U\) 落在长度为 \(p_j\) 的区间内的概率。但对于 \(\text{Unif}(0,1)\) 随机变量,概率即长度,因此 \(P(X=j)\) 恰好是 \(p_j\),符合要求!

同样的技巧也适用于可以取无限多个值的离散随机变量,例如泊松分布;我们需要将 \((0,1)\) 切割成无限多个片段,但这些片段的总长度仍然为 1。

我们现在知道了如何利用任意 PMF 并创建一个具有该 PMF 的随机变量。这履行了我们在第 3 章中的承诺,即任何具有定理 3.2.7 所给定性质的函数都是某个随机变量的 PMF。

5.3.6. 另一方面,均匀分布普适性的第二部分对于离散随机变量并不成立。离散随机变量的函数仍然是离散的,因此如果 \(X\) 是离散的,那么 \(F(X)\) 仍然是离散的。所以 \(F(X)\) 不具有均匀分布。例如,若 \(X \sim \text{Bern}(p)\),则 \(F(X)\) 只有两个可能的取值:\(F(0) = 1-p\) 和 \(F(1) = 1\)。

均匀分布普适性的结果是,我们可以使用均匀随机变量 \(U\) 来生成连续和离散分布的随机变量:在连续情况下,我们可以将 \(U\) 代入反累积分布函数(inverse CDF);在离散情况下,我们可以根据所需的概率质量函数(PMF)对单位区间进行切割。均匀分布普适性的第一部分在运行模拟时非常有用(因为所使用的软件可能知道如何生成均匀随机变量,但不知道如何生成目标分布的随机变量),尽管其有用程度取决于计算反累积分布函数的难易程度。第二部分对于统计推断中某些广泛使用的技术非常重要,因为它提供了一种转换,可以将具有未知分布的随机变量转换为具有已知且简单分布(即均匀分布)的随机变量。

如果把分布比作蓝图,把随机变量比作房子,那么普适性的美妙之处在于:均匀分布是一个非常简单的蓝图,根据这个蓝图建造房子很容易;而均匀分布的普适性为我们提供了一个简单的规则,可以将“均匀分布房子”改造成任何其他蓝图的房子,无论那个蓝图有多么复杂!

在本节的最后,我们给出一个优雅的等式,它通常用于寻找非负随机变量的期望。该等式还有一个巧妙的视觉解释,与均匀分布的普适性、无意识统计学家法则(LOTUS)以及累积分布函数(CDF)与分位数函数之间的关系有关。

定义 5.3.7。具有累积分布函数 \(F\) 的随机变量 \(X\) 的生存函数(survival function)是函数 \(G\),定义为 \(G(x) = 1 - F(x) = P(X > x)\)。

定理 5.3.8(通过积分生存函数求期望)。设 \(X\) 为非负随机变量。其期望可以通过对其生存函数进行积分来求得: \[ E(X) = \int_{0}^{\infty} P(X > x) dx \]

这一结果是定理 4.4.8 的连续模拟(但请注意,它适用于任何非负随机变量,而不仅仅是连续非负随机变量)。出于某些晦涩的原因,精算师有时将其称为 Darth Vader 法则;统计学家则更倾向于称之为通过生存函数积分求期望。

证明。对于任何数字 \(x \geq 0\),我们可以写成: \[ x = \int_{0}^{x} dt = \int_{0}^{\infty} I(x > t) dt \]

其中 \(I(x > t)\) 在 \(x \geq t\) 时为 1,否则为 0。因此,对于样本空间中的每一个 \(s\): \[ X(s) = \int_{0}^{\infty} I(X(s) > t) dt \]

我们可以更紧凑地写成: \[ X = \int_{0}^{\infty} I(X > t) dt \]

对等式两边取期望,并将期望符号 \(E\) 与积分符号互换(这可以通过实分析中的结论证明),我们得到: \[ E(X) = E \left[ \int_{0}^{\infty} I(X > t) dt \right] = \int_{0}^{\infty} E(I(X > t)) dt = \int_{0}^{\infty} P(X > t) dt \]

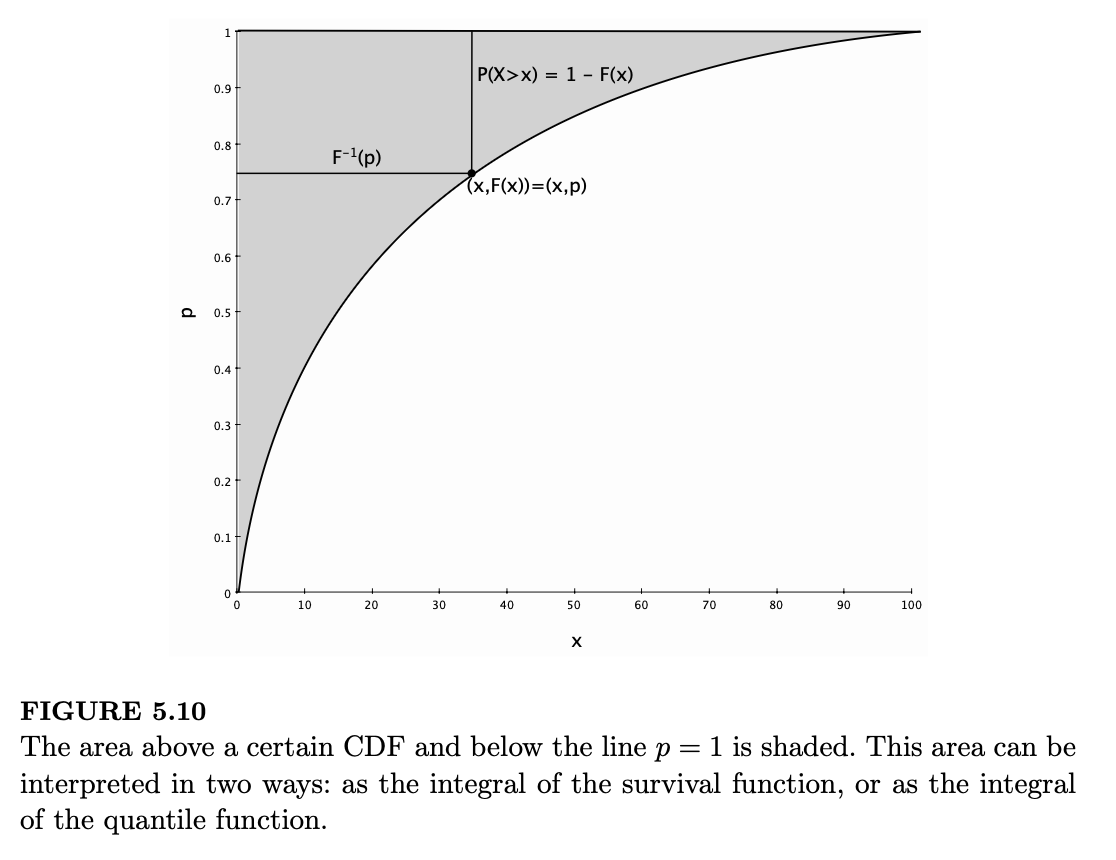

为了对这一等式进行视觉解释,我们可以绘制一张 CDF 图表,并以两种不同的方式来解读某个特定区域:将其视为生存函数的积分,以及将其视为分位数函数的积分。

图 5.10 展示了一个非负连续随机变量 \(X\)(其 CDF 为 \(F\))的典型 CDF 图像,图中阴影部分为 CDF 曲线与水平线 \(p=1\) 之间的面积。这个面积可以通过对 \(1-F(x)\)(即该直线与曲线之差)在 \(0\) 到 \(\infty\) 之间进行积分来求得。

但是,寻找这个面积的另一种方法是将你的头侧过来,相对于垂直轴变量 \(p\) 而不是水平轴变量 \(x\) 进行积分。根据无意识统计学家法则(LOTUS)和均匀分布的普适性,令 \(U \sim \text{Unif}(0,1)\),这给出了分位数函数的积分: \[ \int_{0}^{1} F^{-1}(p)dp = E(F^{-1}(U)) = E(X) \]

因此我们再次得到: \[ \int_{0}^{\infty} (1-F(x))dx = \int_{0}^{1} F^{-1}(p)dp = E(X) \]

5.4 正态分布

Normal

正态分布(Normal distribution)是一种著名的具有钟形概率密度函数(PDF)的连续分布。由于中心极限定理(central limit theorem)的存在,它在统计学中被极其广泛地应用。该定理指出:在非常弱的假设下,大量独立同分布(i.i.d.)随机变量之和近似服从正态分布,无论单个随机变量本身的分布如何。这意味着我们可以从几乎任何分布(离散或连续)的独立随机变量开始,但只要将大量这类变量相加,所得随机变量的分布看起来就会像正态分布。

中心极限定理是第 10 章的主题,但在此期间,我们将介绍正态分布的 PDF 和 CDF 的性质,并推导其期望和方差。为此,我们将再次使用位置-尺度变换(location-scale transformation)策略:先从最简单的正态分布——即以 0 为中心且方差为 1 的标准正态分布开始。在推导出标准正态分布的性质后,我们就能通过平移和缩放得到任何我们想要的正态分布。

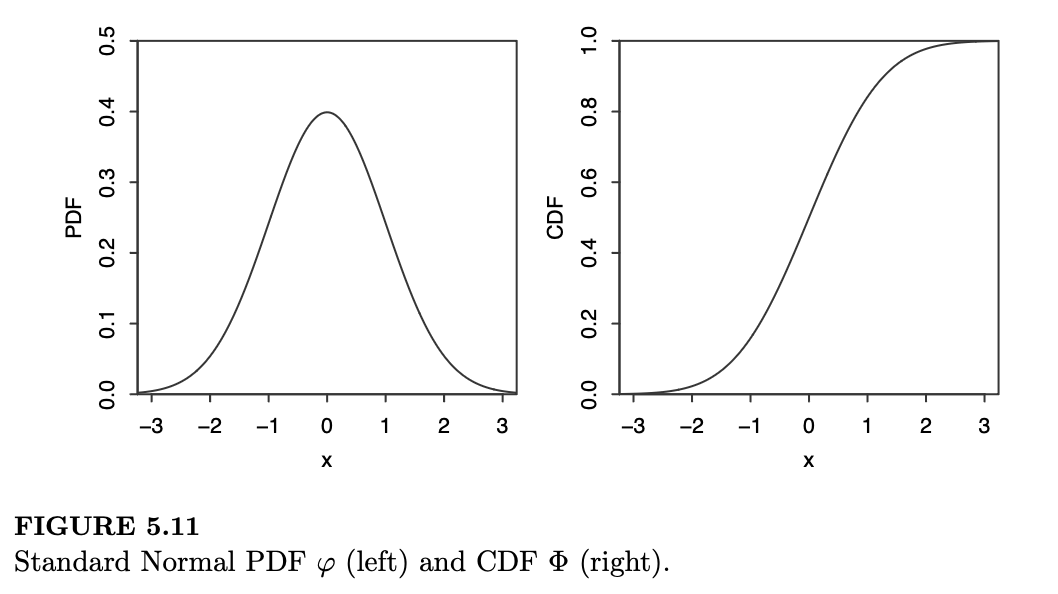

定义 5.4.1(标准正态分布)。如果连续随机变量 \(Z\) 的概率密度函数 \(\varphi\) 为: \[ \varphi(z) = \frac{1}{\sqrt{2\pi}} e^{-z^2/2}, -\infty < z < \infty \]

则称其服从标准正态分布。我们记作 \(Z \sim N(0,1)\),因为正如我们将要证明的,\(Z\) 的均值为 0,方差为 1。

PDF 前面的常数 \(\frac{1}{\sqrt{2\pi}}\) 可能看起来令人惊讶(在没有圆出现的情况下,为什么含有 \(e\) 的项前面需要含 \(\pi\) 的项?),但这正是使 PDF 的积分为 1 所必需的。这类常数被称为归一化常数(normalizing constants),因为它们将 PDF 下的总面积归一化为 1。我们很快就会验证这是一个有效的 PDF。

标准正态分布的累积分布函数 \(\Phi\) 是 PDF 下的累积面积: \[ \Phi(z) = \int_{-\infty}^{z} \varphi(t)dt = \int_{-\infty}^{z} \frac{1}{\sqrt{2\pi}} e^{-t^2/2}dt \]

有些人第一次看到函数 \(\Phi\) 时,会对它以积分形式表示感到沮丧。遗憾的是,在此问题上我们别无选择:事实证明,要在数学上找到 \(\varphi\) 的原函数的闭式表达式(closed-form expression)是不可能的。这意味着我们无法将 \(\Phi\) 表示为更熟悉的函数(如多项式或指数函数)的有限次求和。但无论是否有闭式表达式,它仍然是一个定义明确的函数:如果我们给 \(\Phi\) 一个输入值 \(z\),它就会返回 PDF 从 \(-\infty\) 到 \(z\) 的累积面积。

符号说明 5.4.2。我们可以看出正态分布一定非常特殊,因为标准正态分布的 PDF 和 CDF 拥有专属的希腊字母。按照惯例,我们使用 \(\varphi\) 表示标准正态 PDF,使用 \(\Phi\) 表示其 CDF。我们通常使用 \(Z\) 来表示标准正态随机变量。

图 5.11 绘制了标准正态 PDF 和 CDF。PDF 呈钟形且关于 0 对称,CDF 呈 S 形。它们与我们在例 5.1.6 中看到的 Logistic PDF 和 CDF 的总轮廓相似,但正态 PDF 衰减到 0 的速度要快得多。

从标准正态 PDF 和 CDF 中可以推导出几个重要的对称性质:

PDF 的对称性:\(\varphi\) 满足 \(\varphi(z) = \varphi(-z)\),即 \(\varphi\) 是一个偶函数。

尾部面积的对称性:根据定义,PDF 曲线左侧 -2 处的面积为 \(P(Z \leq -2) = \Phi(-2)\),它等于右侧 2 处的面积 \(P(Z \geq 2) = 1 - \Phi(2)\)。一般而言,对于所有 \(z\),都有:

\[ \Phi(z) = 1 - \Phi(-z) \]

这可以通过观察 PDF 曲线直观看出,也可以通过代入 \(u = -t\) 并利用 PDF 积分为 1 的性质在数学上得到证明:

\[ \Phi(-z) = \int_{-\infty}^{-z} \varphi(t)dt = \int_{z}^{\infty} \varphi(u)du = 1 - \int_{-\infty}^{z} \varphi(u)du = 1 - \Phi(z) \]

- \(Z\) 与 \(-Z\) 的对称性:若 \(Z \sim N(0,1)\),则 \(-Z \sim N(0,1)\)。为了证明这一点,注意 \(-Z\) 的 CDF 为:

\[ P(-Z \leq z) = P(Z \geq -z) = 1 - \Phi(-z) \]

根据上述论证,这正是 \(\Phi(z)\)。因此 \(-Z\) 的 CDF 也是 \(\Phi\)。

我们需要证明关于标准正态分布的三个关键事实,然后才能处理一般的正态分布:我们需要证明 \(\varphi\) 是一个有效的 PDF,且 \(E(Z) = 0\) 以及 \(\text{Var}(Z) = 1\)。

为了验证 \(\varphi\) 的有效性,我们将证明 \(e^{-z^2/2}\) 下的总面积为 \(\sqrt{2\pi}\)。然而,我们无法直接找到 \(e^{-z^2/2}\) 的原函数,这再次是因为原函数无法表示为闭式表达式。但这并不意味着我们不能运用一些灵巧的方法来计算定积分。

这里有一个神奇的技巧可以解决问题:将积分写两遍。通常,反复写同一个问题更多是由于挫败感而非解题策略。但在这种情况下,它允许我们巧妙地转换为极坐标: \[ \left( \int_{-\infty}^{\infty} e^{-z^2/2} dz \right) \left( \int_{-\infty}^{\infty} e^{-z^2/2} dz \right) = \int_{-\infty}^{\infty} e^{-x^2/2} dx \int_{-\infty}^{\infty} e^{-y^2/2} dy \]

\[ = \int_{-\infty}^{\infty} \int_{-\infty}^{\infty} e^{-\frac{x^2+y^2}{2}} dx dy \]

\[ = \int_{0}^{2\pi} \int_{0}^{\infty} e^{-r^2/2} r dr d\theta \]

在第一步中,我们利用了 \(z\) 在每个积分中仅仅是一个虚拟变量(dummy variable)这一事实,因此我们可以给它起不同的名字(或者两个不同的名字,每个积分一个)。最后一步中多出的 \(r\) 来自极坐标变换的雅可比行列式(Jacobian),正如数学附录 A.7.2 节中所解释的那样。正是这个 \(r\) 将我们从原积分的“不可能任务”中解救了出来,因为我们现在可以使用代换 \(u = r^2/2, du = rdr\)。这得出: \[ \int_{0}^{2\pi} \int_{0}^{\infty} e^{-r^2/2} r dr d\theta = \int_{0}^{2\pi} \int_{0}^{\infty} e^{-u} du d\theta \]

\[ = \int_{0}^{2\pi} 1 d\theta = 2\pi \]

因此,\(\int_{-\infty}^{\infty} e^{-z^2/2} dz = \sqrt{2\pi}\),正如我们所要证明的。

由于 PDF 的对称性,标准正态分布的期望必定为 0;除了这一点,任何其他的平衡点都没有意义。我们也可以通过观察 \(E(Z)\) 的定义来看到这种对称性: \[ E(Z) = \frac{1}{\sqrt{2\pi}} \int_{-\infty}^{\infty} ze^{-z^2/2} dz \]

由于 \(g(z) = ze^{-z^2/2}\) 是一个奇函数(关于偶函数和奇函数的更多内容见数学附录 A.2.3 节),\(g\) 在 \(-\infty\) 到 \(0\) 之间的面积与 \(g\) 在 \(0\) 到 \(\infty\) 之间的面积相互抵消。因此 \(E(Z) = 0\)。事实上,同样的论据可以证明,对于任何正奇整数 \(n\),\(E(Z^n) = 0\)。

求均值很容易(甚至有人会说这是“EZ”),但方差的计算要稍微复杂一些。根据无意识统计学家法则(LOTUS): \[ \text{Var}(Z) = E(Z^2) - (E(Z))^2 = E(Z^2) \]

\[ = \frac{1}{\sqrt{2\pi}} \int_{-\infty}^{\infty} z^2 e^{-z^2/2} dz \]

\[ = \frac{2}{\sqrt{2\pi}} \int_{0}^{\infty} z^2 e^{-z^2/2} dz \]

最后一步利用了 \(z^2 e^{-z^2/2}\) 是偶函数这一事实。现在我们使用分部积分法,令 \(u = z, dv = ze^{-z^2/2} dz\),则 \(du = dz, v = -e^{-z^2/2}\): \[ \text{Var}(Z) = \frac{2}{\sqrt{2\pi}} \left( -ze^{-z^2/2} \bigg|_{0}^{\infty} + \int_{0}^{\infty} e^{-z^2/2} dz \right) \]

\[ = \frac{2}{\sqrt{2\pi}} \left( 0 + \frac{\sqrt{2\pi}}{2} \right) = 1 \]

分部积分的第一项等于 0,是因为 \(e^{-z^2/2}\) 的衰减速度远快于 \(z\) 的增长速度;第二项等于 \(\sqrt{2\pi}/2\),是因为它是 \(e^{-z^2/2}\) 下总面积(我们已证明为 \(\sqrt{2\pi}\))的一半。所以,标准正态分布的均值确实为 0,方差为 1。

一般正态分布有两个参数,记作 \(\mu\) 和 \(\sigma^2\),它们分别对应均值和方差(因此标准正态分布是 \(\mu=0\) 且 \(\sigma^2=1\) 的特殊情况)。从标准正态随机变量 \(Z \sim N(0,1)\) 出发,我们可以通过位置-尺度变换(平移和缩放)得到具有任何均值和方差的正态随机变量。

定义 5.4.3(正态分布)。若 \(Z \sim N(0,1)\),则对于任何实数 \(\mu\) 及满足 \(\sigma > 0\) 的 \(\sigma^2\),称 \[ X = \mu + \sigma Z \]

服从均值为 \(\mu\)、方差为 \(\sigma^2\) 的正态分布。我们记作 \(X \sim N(\mu, \sigma^2)\)。

根据期望和方差的性质,显然 \(X\) 的均值确实为 \(\mu\),方差确实为 \(\sigma^2\): \[ E(\mu + \sigma Z) = E(\mu) + \sigma E(Z) = \mu \]

\[ \text{Var}(\mu + \sigma Z) = \text{Var}(\sigma Z) = \sigma^2 \text{Var}(Z) = \sigma^2 \]

注意,我们将 \(Z\) 乘以标准差 \(\sigma\) 而不是 \(\sigma^2\);否则单位将出错,且 \(X\) 的方差会变成 \(\sigma^4\)。

当然,如果我们能从 \(Z\) 得到 \(X\),那么我们也能从 \(X\) 回到 \(Z\)。将非标准正态变量转换为标准正态变量的过程被恰如其分地称为标准化(standardization)。对于 \(X \sim N(\mu, \sigma^2)\),\(X\) 的标准化版本为: \[ \frac{X - \mu}{\sigma} \sim N(0,1) \]

我们可以通过标准化,利用标准正态 CDF 和 PDF 来表示 \(X\) 的 CDF 和 PDF。

定理 5.4.4(正态分布的 CDF 和 PDF)。设 \(X \sim N(\mu, \sigma^2)\)。那么 \(X\) 的 CDF 为: \[ F(x) = \Phi\left(\frac{x - \mu}{\sigma}\right) \]

\(X\) 的 PDF 为: \[ f(x) = \varphi\left(\frac{x - \mu}{\sigma}\right) \frac{1}{\sigma} \]

证明。对于 CDF,我们从定义 \(F(x) = P(X \leq x)\) 出发,进行标准化,并使用标准正态分布的 CDF: \[ F(x) = P(X \leq x) = P\left(\frac{X - \mu}{\sigma} \leq \frac{x - \mu}{\sigma}\right) = \Phi\left(\frac{x - \mu}{\sigma}\right) \]

然后我们通过求导获得 PDF,记得应用链式法则: \[ f(x) = \frac{d}{dx} \Phi\left(\frac{x - \mu}{\sigma}\right) = \varphi\left(\frac{x - \mu}{\sigma}\right) \cdot \frac{1}{\sigma} \]

我们也可以将该 PDF 展开写成: \[ f(x) = \frac{1}{\sqrt{2\pi}\sigma} \exp\left(-\frac{(x - \mu)^2}{2\sigma^2}\right) \]

最后,正态分布有三个重要的基准,即落在均值的一个、两个和三个标准差范围内的概率。68-95-99.7% 法则告诉我们,这些概率正如其名。

定理 5.4.5(68-95-99.7% 法则)。若 \(X \sim N(\mu, \sigma^2)\),则: \[ P(|X - \mu| < \sigma) \approx 0.68 \]

\[ P(|X - \mu| < 2\sigma) \approx 0.95 \]

\[ P(|X - \mu| < 3\sigma) \approx 0.997 \]

我们可以利用这一法则快速估算正态分布的概率。通常,在标准化之后应用该法则会更容易,此时我们有: \[ P(|Z| < 1) \approx 0.68 \]

\[ P(|Z| < 2) \approx 0.95 \]

\[ P(|Z| < 3) \approx 0.997 \]

例 5.4.6(标准正态 CDF 的练习)。设 \(X \sim N(-1, 4)\)。\(P(|X| < 3)\) 的精确值(用 \(\Phi\) 表示)和近似值分别是多少?

解:

事件 \(|X| < 3\) 等同于事件 \(-3 < X < 3\)。我们通过标准化将此事件用标准正态随机变量 \(Z = (X - (-1))/2\) 来表示,然后应用 68-95-99.7% 法则得到近似值。精确答案为: \[ P(-3 < X < 3) = P\left(\frac{-3 - (-1)}{2} < \frac{X - (-1)}{2} < \frac{3 - (-1)}{2}\right) \]

\[ = P(-1 < Z < 2) \]

即 \(\Phi(2) - \Phi(-1)\)。

68-95-99.7% 法则告诉我们 \(P(-1 < Z < 1) \approx 0.68\) 且 \(P(-2 < Z < 2) \approx 0.95\)。换句话说,从 \(\pm 1\) 个标准差范围扩大到 \(\pm 2\) 个标准差范围,曲线下的面积增加了大约 \(0.95 - 0.68 = 0.27\)。根据对称性,这部分面积由 \(P(-2 < Z < -1)\) 和 \(P(1 < Z < 2)\) 平分。因此: \[ P(-1 < Z < 2) = P(-1 < Z < 1) + P(1 < Z < 2) \approx 0.68 + \frac{0.27}{2} = 0.815 \]

这与正确值 \(\Phi(2) - \Phi(-1) \approx 0.8186\) 非常接近。

正如我们稍后在书中将看到的,通过自然的方式(如平方或取指数)对正态随机变量进行变换,可以得到几种重要的分布。第 8 章将深入探讨变换,但目前仅使用无意识统计学家法则(LOTUS)和累积分布函数(CDF)的性质,我们就能完成很多工作。

例 5.4.7(折叠正态分布)。设 \(Y = |Z|\),其中 \(Z \sim N(0,1)\)。\(Y\) 的分布被称为参数为 \(\mu=0\) 和 \(\sigma^2=1\) 的折叠正态分布(Folded Normal)。在本例中,我们将推导 \(Y\) 的均值、方差和分布。乍一看,\(Y\) 似乎很难处理,因为绝对值函数在 0 处不可导(由于其尖角),但 \(Y\) 具有完全有效的连续分布。

求 \(E(Y)\)。

求 \(\text{Var}(Y)\)。

求 \(Y\) 的 CDF 和 PDF。

解:

虽然我们稍后在本例中才会推导 \(Y\) 的 PDF,但要计算 \(E(Y)\),根据 LOTUS,我们可以直接使用 \(Z\) 的 PDF: \[ E(Y) = E|Z| = \int_{-\infty}^{\infty} |z| \frac{1}{\sqrt{2\pi}} e^{-z^2/2} dz = 2 \int_{0}^{\infty} \frac{z}{\sqrt{2\pi}} e^{-z^2/2} dz = \sqrt{\frac{2}{\pi}} \]

注意 \(Y^2 = Z^2\),所以我们不需要再做一次积分!我们有: \[ E(Y^2) = E(Z^2) = \text{Var}(Z) = 1 \]

因此: \[ \text{Var}(Y) = E(Y^2) - (E(Y))^2 = 1 - \frac{2}{\pi} \]

- 对于 \(y \leq 0\),\(Y\) 的 CDF 为 \(F_Y(y) = P(Y \leq y) = 0\)。对于 \(y > 0\),CDF 为: \[ F_Y(y) = P(Y \leq y) = P(|Z| \leq y) = P(-y \leq Z \leq y) = \Phi(y) - \Phi(-y) = 2\Phi(y) - 1 \]

因此,当 \(y \geq 0\) 时,\(Y\) 的 PDF 为 \(2\varphi(y)\),否则为 0,其中 \(\varphi\) 是 \(N(0,1)\) 的 PDF。

合理性检查: 注意当 \(y \to \infty\) 时,\(2\Phi(y) - 1 \to 2 - 1 = 1\),符合 CDF 的要求。此外,\(Y\) 的 CDF 是连续函数,因为 \(\Phi\) 是连续的且在 0 处没有跳变:\(2\Phi(0) - 1 = 0\)。同时,\(Y\) 的 PDF 也是合理的,因为对 \(Z\) 取绝对值将 \(Z\) 负值范围的概率质量“折叠”到了正值一侧。例如,\(Z\) 在 -2 到 -1 之间的概率贡献给了 \(Y\) 在 1 到 2 之间的概率。这导致负值部分的密度为零,而正值部分的密度翻了一倍。

5.5 指数分布

Exponential

指数分布(Exponential distribution)是几何分布的连续版本。回想一下,几何随机变量计算的是在伯努利试验序列中第一次成功之前的失败次数。指数分布的故事与之类似,但我们现在是在连续时间内等待成功的发生,其中成功以每单位时间 \(\lambda\) 次的速率到来。在长度为 \(t\) 的时间间隔内,成功的平均次数为 \(\lambda t\),尽管实际成功次数是随机变化的。一个指数随机变量表示直到第一次成功到来之前的等待时间。

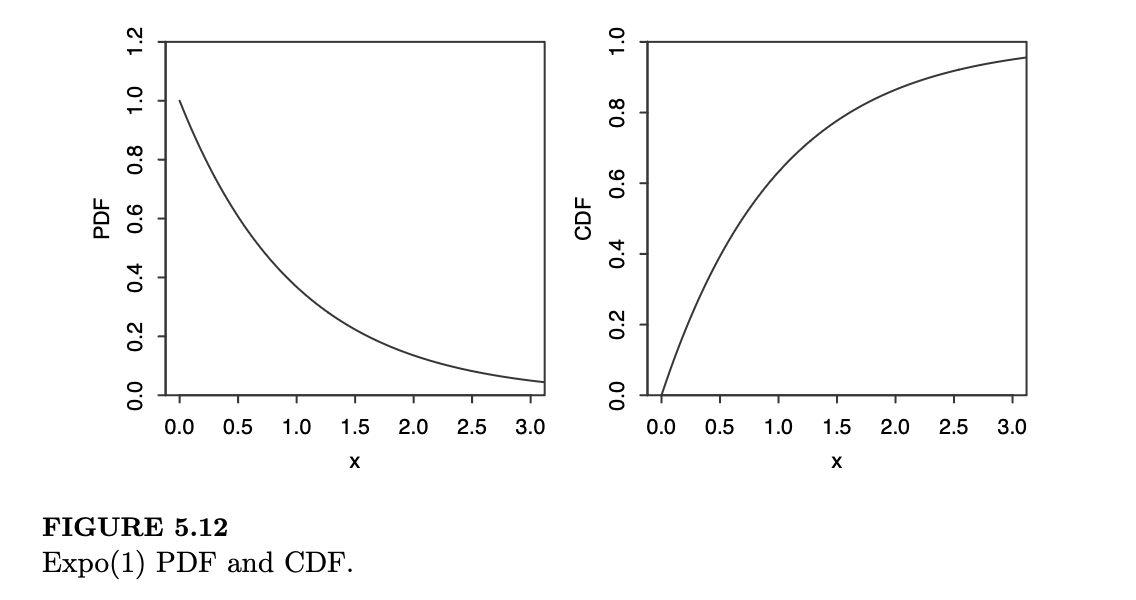

定义 5.5.1(指数分布)。如果连续随机变量 \(X\) 的概率密度函数(PDF)为: \[ f(x) = \lambda e^{-\lambda x}, x > 0 \]

则称 \(X\) 服从参数为 \(\lambda\)(其中 \(\lambda > 0\))的指数分布。我们记作 \(X \sim \text{Expo}(\lambda)\)。

相应的累积分布函数(CDF)为: \[ F(x) = 1 - e^{-\lambda x}, x > 0 \]

图 5.12 绘制了 \(\text{Expo}(1)\) 的 PDF 和 CDF。注意它们与第 4 章中展示的几何分布 PMF 和 CDF 的相似性。练习 43 探讨了在伯努利试验进行得越来越快但成功概率越来越小的极限情况下,几何分布如何收敛于指数分布。

我们已经看到所有的均匀分布和正态分布是如何通过位置-尺度变换(location-scale transformations)相互联系的,我们可能会好奇指数分布是否也支持这一点。指数随机变量被定义在支撑集 \((0, \infty)\) 上,平移会改变左端点。但尺度变换(scale transformations)效果很好,我们可以通过缩放从简单的 \(\text{Expo}(1)\) 得到一般的 \(\text{Expo}(\lambda)\):如果 \(X \sim \text{Expo}(1)\),那么 \[ Y = \frac{X}{\lambda} \sim \text{Expo}(\lambda) \]

因为 \[ P(Y \leq y) = P\left(\frac{X}{\lambda} \leq y\right) = P(X \leq \lambda y) = 1 - e^{-\lambda y}, y > 0 \]

反之,如果 \(Y \sim \text{Expo}(\lambda)\),那么 \(\lambda Y \sim \text{Expo}(1)\)。

这意味着,就像我们对均匀分布和正态分布所做的一样,我们可以通过 \(X \sim \text{Expo}(1)\) 出发来获得指数分布的均值和方差。\(E(X)\) 和 \(\text{Var}(X)\) 都是通过标准的分部积分计算得出的。结果如下: \[ E(X) = \int_{0}^{\infty} xe^{-x} dx = 1 \]

\[ E(X^2) = \int_{0}^{\infty} x^2 e^{-x} dx = 2 \]

\[ \text{Var}(X) = E(X^2) - (EX)^2 = 1 \]

在下一章中,我们将引入一种名为矩生成函数(moment generating function)的新工具,它可以让我们无需积分就能得到这些结果。

对于 \(Y = X/\lambda \sim \text{Expo}(\lambda)\),我们有: \[ E(Y) = \frac{1}{\lambda} E(X) = \frac{1}{\lambda}, \]

\[ \text{Var}(Y) = \frac{1}{\lambda^2} \text{Var}(X) = \frac{1}{\lambda^2}, \]

因此 \(\text{Expo}(\lambda)\) 分布的均值和方差分别为 \(1/\lambda\) 和 \(1/\lambda^2\)。正如我们在直觉上所预期的,成功到来的速率 \(\lambda\) 越快,平均等待时间就越短。

指数分布具有一个非常特殊的性质,称为无记忆性(memoryless property)。它指的是:即使你已经等待了数小时或数天而没有获得成功,成功也不会因此而更有可能很快到来。事实上,你大可以认为自己是在 10 秒钟前才刚刚开始等待的。其定义将这一构想正式化。

定义 5.5.2(无记忆性)。如果来自某种分布的随机变量 \(X\) 对于所有 \(s, t \geq 0\) 满足: \[ P(X \geq s + t \mid X \geq s) = P(X \geq t) \]

则称该连续分布具有无记忆性。

在这里,\(s\) 代表你已经等待的时间;该定义指出,在你已经等待了 \(s\) 分钟之后,还需要再等待 \(t\) 分钟的概率,与在没有任何前期等待的情况下需要等待 \(t\) 分钟的概率完全相同。表述无记忆性的另一种方式是:在已知 \(X \geq s\) 的条件下,额外的等待时间 \(X - s\) 仍然服从 \(\text{Expo}(\lambda)\) 分布。

特别地,这意味着: \[ E(X \mid X \geq s) = s + E(X) = s + \frac{1}{\lambda} \]

(条件期望在第 9 章中有详细解释,但其含义目前应该是清晰的:对于任何随机变量 \(X\) 和事件 \(A\),\(E(X \mid A)\) 是给定 \(A\) 时 \(X\) 的期望值;其定义可以通过将 \(E(X)\) 定义中的无条件 PMF 或 PDF 替换为给定 \(A\) 下的条件 PMF 或 PDF 来得到。)

利用条件概率的定义,我们可以直接验证指数分布具有无记忆性。设 \(X \sim \text{Expo}(\lambda)\),则: \[ \frac{P(X \geq s + t \cap X \geq s)}{P(X \geq s)} = \frac{P(X \geq s + t)}{P(X \geq s)} \]

\[ = \frac{e^{-\lambda(s+t)}}{e^{-\lambda s}} = e^{-\lambda t} = P(X \geq t) \]

无记忆性的含义是什么?如果你在公交车站等车,且距离车辆到达的时间服从指数分布,那么在你已经等待了 30 分钟的条件下,公交车并不会因此就“快到了”。分布简单地忘记了你已经等了半小时,你剩下的等待时间与你刚到车站时是一样的。如果一台机器的寿命服从指数分布,那么无论这台机器已经运行了多久,在它已经运行了这么久的条件下,这台机器都“如新的一样”:不存在磨损效应会使机器更有可能很快发生故障。如果人类的寿命是指数分布的,那么在一个人活到 80 岁的条件下,他剩余的寿命分布将与一个新生儿的寿命分布完全相同!

显然,无记忆性并不是描述人类或机器寿命的恰当方式。那我们为什么还要关注指数分布呢?

- 某些物理现象(如放射性衰变)确实展现出无记忆性,因此指数分布本身就是一个重要的模型。

- 指数分布与其他著名分布联系紧密。在下一节中,我们将看到指数分布和泊松分布如何被一个共同的故事统一起来,并在随后的章节中发现更多的联系。

- 指数分布是构建更灵活分布的基石。例如 Weibull 分布(在第 6 章中介绍),它允许存在磨损效应(旧设备更易损坏)或“优胜劣汰”效应(存活时间越长,生命力越强)。要理解这些分布,我们必须首先理解指数分布。

无记忆性是指数分布的一个非常特殊的性质:在 \((0, \infty)\) 上,没有其他连续分布具有无记忆性!让我们来证明这一点。

定理 5.5.3。如果 \(X\) 是一个具有无记忆性的正连续随机变量,那么 \(X\) 服从指数分布。

证明:假设 \(X\) 是一个具有无记忆性的正连续随机变量。设 \(F\) 为 \(X\) 的累积分布函数(CDF),\(G\) 为 \(X\) 的生存函数,即 \(G(x) = 1 - F(x)\)。我们将通过首先证明对于所有实数 \(x > 0\) 都有 \(G(xt) = G(t)^x\),从而证明 \(G(x) = e^{-\lambda x}\)(对于某个 \(\lambda\))。

无记忆性指出,对于所有 \(s, t \geq 0\): \[ G(s + t) = G(s)G(t) \]

令 \(s = t\),我们有: \[ G(2t) = G(t)^2 \]

因此: \[ G(3t) = G(2t + t) = G(2t)G(t) = G(t)^3, \quad G(4t) = G(t)^4, \dots \]

由此可得,对于正整数 \(m\): \[ G(mt) = G(t)^m \]

我们分阶段对这一结论进行扩展。在 \(G(2t) = G(t)^2\) 中用 \(t/2\) 代替 \(t\),我们得到 \(G(t/2) = G(t)^{1/2}\)。同理,对于任何正整数 \(n\): \[ G\left(\frac{t}{n}\right) = G(t)^{1/n} \]

由此推导,对于任何正整数 \(m, n\): \[ G\left(\frac{m}{n}t\right) = G\left(\frac{t}{n}\right)^m = G(t)^{m/n} \]

因此,对于所有正有理数 \(x\): \[ G(xt) = G(t)^x \]

由于任何正实数都可以写成正有理数的极限,利用 \(G\) 是连续函数这一事实,上述等式对所有正实数 \(x\) 均成立。

令 \(t = 1\),我们有: \[ G(x) = G(1)^x = e^{-\lambda x} \]

其中 \(\lambda = -\log(G(1)) > 0\)(注:因为 \(G(1) < 1\),故 \(\lambda\) 为正)。这正是我们想要的 \(G\) 的形式,因此 \(X\) 服从指数分布。

离散分布的无记忆性定义与之类似:对于一个服从该分布的离散随机变量 \(X\),如果满足 \[ P(X \geq j+k \mid X \geq j) = P(X \geq k) \]

对于所有非负整数 \(j, k\) 成立,则称该分布具有无记忆性。鉴于几何分布与指数分布故事背景之间的相似性(或者如果你已经完成了第 4 章的练习 32),你可能会猜测几何分布是无记忆的。如果是这样,你是正确的!如果我们正在等待公平硬币抛掷序列中的第一次正面,而由于运气不佳,我们恰好连续得到了十次反面,这对于我们还需要额外抛掷多少次没有影响:硬币不会因为之前没出正面就“该出正面了”,也不会为了让我们永远得到反面而密谋对付我们。硬币是无记忆的。几何分布是取值为 \(\{0, 1, 2, \dots\}\) 的唯一无记忆离散分布,而指数分布是取值为 \((0, \infty)\) 的唯一无记忆连续分布。

作为无记忆性的练习,下面的例子记录了弗雷德(Fred)的冒险经历,他在搬到一个拥有无记忆公共交通系统的城镇后,亲身体验了无记忆性带来的沮丧。

例 5.5.4(Blissville 和 Blotchville)。弗雷德住在 Blissville,那里的公交车总是准时到达,连续两班车之间的时间固定为 10 分钟。由于丢了手表,他在某天的一个均匀随机的时间到达公交车站(假设公交车每天 24 小时运行,且弗雷德到达的时间独立于公交车的到达过程)。

弗雷德等待下一班车的时间服从什么分布?弗雷德平均需要等待多长时间?

已知在等待 6 分钟后公交车仍未到达,弗雷德至少还需要再等 3 分钟的概率是多少?

弗雷德搬到了 Blotchville,这是一座城市规划较差、公交车运行更加不稳定的城市。现在,每当一班车到达时,直到下一班车到达的时间是一个均值为 10 分钟的指数随机变量。弗雷德在一个随机时间到达公交车站(假设 Blotchville 永远遵循并将永远遵循这一系统,且弗雷德到达的时间独立于公交车的到达过程)。弗雷德等待下一班车的等待时间服从什么分布?弗雷德平均需要等待多长时间?

当弗雷德向朋友抱怨 Blotchville 的交通有多糟糕时,朋友说:“别抱怨了!你是在前一班车和后一班车之间的均匀瞬间到达的。公交车之间的平均间隔时间是 10 分钟,但既然你在该间隔内的任何时间到达的可能性是相等的,你的平均等待时间只有 5 分钟。”弗雷德对此表示不同意,这既基于经验,也基于他在等车时解出的 (c) 部分。解释这位朋友的推论错在哪里。

解:

分布是 \((0, 10)\) 上的均匀分布,因此均值为 5 分钟。

令 \(T\) 为等待时间。则 \[ P(T \geq 6 + 3 \mid T > 6) = \frac{P(T \geq 9, T > 6)}{P(T > 6)} = \frac{P(T \geq 9)}{P(T > 6)} = \frac{1/10}{4/10} = \frac{1}{4} \]

特别是,弗雷德在 Blissville 的等待时间不是无记忆的;在已经等待了 6 分钟的条件下,他至少还需要再等 3 分钟的机会只有 \(1/4\),而如果他刚到车站,至少需要等待 3 分钟的概率是 \(P(T \geq 3) = 7/10\)。

根据无记忆性,无论弗雷德何时到达,分布都是参数为 \(1/10\)(均值为 10 分钟)的指数分布;下一班车还要多久到达独立于上一班车多久前到达。弗雷德平均需要等待的时间是 10 分钟。

弗雷德的朋友犯了 4.1.3 节中解释过的错误,即用随机变量(两车之间的时间)的期望(10 分钟)代替了随机变量本身,从而忽略了到达间隔时间的变异性。两班车之间的平均时间间隔长度是 10 分钟,但弗雷德到达任何一个间隔的可能性并不是相等的:弗雷德更有可能在长的时间间隔内到达,而不是在短的时间间隔内到达。例如,如果两班车之间的一个间隔是 50 分钟,而另一个间隔是 5 分钟,那么弗雷德在 50 分钟间隔内到达的可能性是 5 分钟间隔内的 10 倍。

这种现象被称为长度偏差抽样(length-biased sampling),它出现在许多现实生活中。例如,询问随机选取的母亲她们有多少个孩子,与询问随机选取的人他们(包括他们自己在内)有多少个兄弟姐妹,会产生不同的分布。询问学生他们的班级规模并对这些结果取平均值,得到的值可能远高于拿出一份班级名单并对每个班级的规模取平均值;这被称为班级规模悖论。关于班级规模悖论和长度偏差抽样的更多内容,请参见第 4 章的练习 16 和 17。

弗雷德在 Blissville 和 Blotchville 的冒险在练习中继续(更多关于弗雷德的冒险也可参见 MacKay [17])。Blotchville 的公交车到达遵循泊松过程,这是下一节的主题。

5.6 泊松过程

Poisson processes

指数分布与泊松分布紧密相连,这一点从我们对这两个分布的参数都使用 \(\lambda\) 就可以看出。在本节中,我们将看到指数分布和泊松分布通过一个共同的故事联系在一起,即泊松过程(Poisson process)的故事。泊松过程是在时间轴上不同点发生的一系列到达事件,使得在特定时间间隔内的到达次数服从泊松分布。第 13 章将更详细地讨论泊松过程,但我们现在已经具备了理解其定义和基本性质的工具。

定义 5.6.1(泊松过程)。如果满足以下两个条件,则连续时间内的到达过程称为速率为 \(\lambda\) 的泊松过程:

- 在长度为 \(t\) 的区间内发生的到达次数是一个 \(\text{Pois}(\lambda t)\) 随机变量。

- 在不相交区间内发生的到达次数相互独立。例如,在区间 \((0,10)\)、\([10,12)\) 和 \([15,\infty)\) 内的到达次数是独立的。

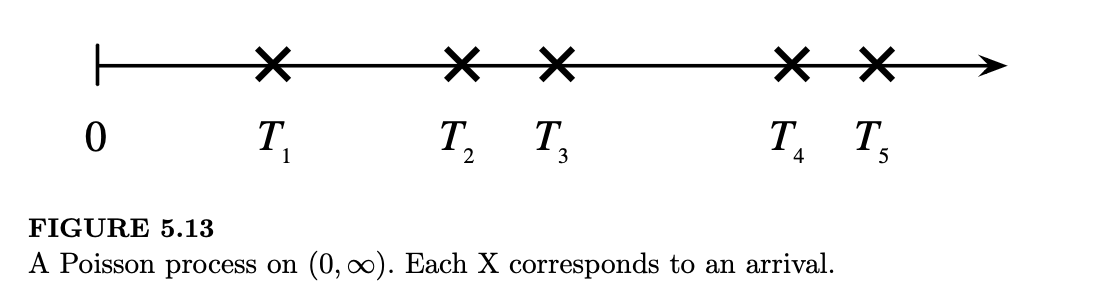

在本节中,我们将重点关注 \((0,\infty)\) 上的泊松过程,但我们也可以在 \((-\infty,\infty)\) 或其他区间上定义泊松过程。在第 13 章中,我们将介绍多维空间的泊松过程。图 5.13 描绘了 \((0,\infty)\) 上泊松过程的示意图,每个 X 标记了一次到达的位置。

具体来说,假设到达事件是按照速率为 \(\lambda\) 的泊松过程落入收件箱的电子邮件。关于这个过程,我们可能有几件想知道的事情。我们可以问的一个问题是:在一小时内,会收到多少封电子邮件?答案直接来自定义,定义告诉我们一小时内的电子邮件数量服从 \(\text{Pois}(\lambda)\) 分布。注意,电子邮件的数量是一个非负整数,因此使用离散分布是合适的。

但我们也可以反过来问:直到第一封电子邮件到达需要多长时间(相对于某个固定的起始点测量)?第一封电子邮件的等待时间是一个正实数,因此使用 \((0,\infty)\) 上的连续分布是合适的。令 \(T_1\) 为第一封电子邮件到达的时间。要找到 \(T_1\) 的分布,我们只需要理解一个关键事实:说第一封电子邮件的等待时间大于 \(t\),等同于说在 \(0\) 到 \(t\) 之间没有电子邮件到达。换句话说,如果 \(N_t\) 是在时间 \(t\) 或之前到达的电子邮件数量,那么:\(T_1 > t\) 与 \(N_t = 0\) 是同一个事件。

我们称之为计数-时间对偶性(count-time duality),因为它将一个用于计数到达次数的离散随机变量 \(N_t\) 与一个标记首次到达时间的连续随机变量 \(T_1\) 联系了起来。更一般地,计数-时间对偶性指出:\(T_n > t\) 与 \(N_t < n\) 是同一个事件。

也就是说,截至时间 \(t\) 第 \(n\) 次到达尚未发生,等同于说直到时间 \(t\) 为止,到达次数少于 \(n\) 次。

如果两个事件相同,则它们具有相同的概率。由于根据泊松过程的定义 \(N_t \sim \text{Pois}(\lambda t)\),故: \[ P(T_1 > t) = P(N_t = 0) = \frac{e^{-\lambda t}(\lambda t)^0}{0!} = e^{-\lambda t} \]

因此 \(P(T_1 \leq t) = 1 - e^{-\lambda t}\),所以 \(T_1 \sim \text{Expo}(\lambda)\)!在速率为 \(\lambda\) 的泊松过程中,到第一次到达的时间服从参数为 \(\lambda\) 的指数分布。

那么 \(T_2 - T_1\),即第一次和第二次到达之间的时间呢?由于根据定义,泊松过程中的不相交区间是独立的,因此一旦第一次到达发生,过去的情况就变得无关紧要。因此,\(T_2 - T_1\) 独立于到第一次到达的时间,且根据与之前相同的论证,\(T_2 - T_1\) 也服从速率为 \(\lambda\) 的指数分布。

同理,\(T_3 - T_2 \sim \text{Expo}(\lambda)\),且独立于 \(T_1\) 和 \(T_2 - T_1\)。以此类推,我们推导出所有的到达间隔时间(interarrival times)都是独立同分布(i.i.d.)的 \(\text{Expo}(\lambda)\) 随机变量。因此,泊松过程将两个重要的分布——一个离散分布和一个连续分布——联系在了一起,而对泊松参数和指数参数使用共同的符号 \(\lambda\) 是一种精妙的符号表示,因为 \(\lambda\) 正是联合这两个分布的过程中的到达速率。

5.6.2. 到第二次到达的总时间 \(T_2\) 是两个独立的 \(\text{Expo}(\lambda)\) 随机变量 \(T_1\) 和 \(T_2 - T_1\) 之和。这不服从指数分布,而是服从 Gamma 分布,该分布将在第 8 章中介绍。

泊松过程的故事为如下所示的事实提供了直觉:独立指数随机变量的最小值是另一个指数随机变量。

例 5.6.3(独立指数变量的最小值)。设 \(X_1, \dots, X_n\) 相互独立,且 \(X_j \sim \text{Expo}(\lambda_j)\)。令 \(L = \min(X_1, \dots, X_n)\)。证明 \(L \sim \text{Expo}(\lambda_1 + \dots + \lambda_n)\),并给出直觉解释。

解:

我们可以通过考虑 \(L\) 的生存函数 \(P(L > t)\) 来求其分布,因为生存函数等于 1 减去 CDF。 \[ P(L > t) = P(\min(X_1, \dots, X_n) > t) = P(X_1 > t, \dots, X_n > t) \]

\[ = P(X_1 > t) \dots P(X_n > t) = e^{-\lambda_1 t} \dots e^{-\lambda_n t} = e^{-(\lambda_1 + \dots + \lambda_n)t} \]

第二个等号成立是因为,\(X_j\) 的最小值大于 \(t\) 等同于所有的 \(X_j\) 都大于 \(t\)。第三个等号由 \(X_j\) 的独立性得出。因此,\(L\) 的生存函数(以及 CDF)具有参数为 \(\lambda_1 + \dots + \lambda_n\) 的指数分布的形式。

直觉上,我们可以将 \(\lambda_j\) 解释为 \(n\) 个独立泊松过程的速率。例如,我们可以想象 \(X_1\) 是等待一辆绿车经过的时间,\(X_2\) 是等待一辆蓝车经过的时间,依此类推,为每个 \(X_j\) 分配一种颜色。那么 \(L\) 就是等待任何一种颜色的车经过的时间,因此 \(L\) 具有合并速率 \(\lambda_1 + \dots + \lambda_n\) 是合理的。

5.6.4. 独立指数变量的最小值是指数分布,但独立指数变量的最大值不是指数分布。然而,关于最小值的结论在研究最大值时非常有用,如下面两个例子所示。

例 5.6.5(3 个独立指数变量的最大值)。三名学生正在独立完成概率作业。三人都在某天的下午 1 点开始,每人完成作业所需的时间都服从均值为 6 小时的指数分布。平均而言,这三名学生全部完成作业的最早时间是多少?

解: 将学生标记为 1, 2, 3,并令 \(X_j\) 为学生 \(j\) 完成作业所需的时间。令 \(\lambda = 1/6\),并令 \(T\) 为所有 3 名学生都完成作业的时间,故 \(T = \max(X_1, X_2, X_3)\),其中 \(X_i \sim \text{Expo}(\lambda)\)。\(T\) 的 CDF 为: \[ P(T \leq t) = P(X_1 \leq t, X_2 \leq t, X_3 \leq t) = (1 - e^{-\lambda t})^3 \]

因此 \(T\) 的 PDF 为: \[ f_T(t) = 3\lambda e^{-\lambda t}(1 - e^{-\lambda t})^2 \]

特别地,\(T\) 不服从指数分布。

通过对 \(t f_T(t)\) 进行积分来求 \(E(T)\) 是可能的,但并不愉快。更巧妙的方法是利用无记忆性和“独立指数变量的最小值是指数分布”这一事实。我们可以将 \(T\) 分解为: \[ T = T_1 + T_2 + T_3 \]

其中 \(T_1 = \min(X_1, X_2, X_3)\) 是第一名学生完成作业所需的时间,\(T_2\) 是第二名学生完成作业所需的额外时间,\(T_3\) 是直到所有 3 人都完成作业所需的最后一段额外时间。根据例 5.6.3 的结果,\(T_1 \sim \text{Expo}(3\lambda)\)。

根据无记忆性,在第一名学生完成作业的时刻,另外两名学生相当于“重新开始”,因此 \(T_2 \sim \text{Expo}(2\lambda)\)。再次根据无记忆性,\(T_3 \sim \text{Expo}(\lambda)\)。无记忆性还意味着 \(T_1, T_2, T_3\) 是相互独立的(如果我们要求 \(\text{Var}(T)\),这将非常有用)。根据线性性质: \[ E(T) = \frac{1}{3\lambda} + \frac{1}{2\lambda} + \frac{1}{\lambda} = 2 + 3 + 6 = 11 \]

这表明平均而言,这三名学生将在午夜(即开始 11 小时后)全部完成作业。

例 5.6.6(机器维修)。某台机器经常发生故障并需要修理。在时间 0 时,机器正在运行。它运行一段服从 \(\text{Expo}(\lambda)\) 的时间(以天为单位),然后发生故障。接着需要一段服从 \(\text{Expo}(\lambda)\) 的时间来修复它,修复后它将再次运行一段 \(\text{Expo}(\lambda)\) 的时间直到再次故障,之后再花费 \(\text{Expo}(\lambda)\) 的时间进行修复,依此类推。假设这些 \(\text{Expo}(\lambda)\) 随机变量是独立同分布(i.i.d.)的。

当机器从运行状态切换到故障状态,或者从故障状态切换到运行状态时,发生一次“转换”(transition)。求在时间间隔 \((0, t)\) 内发生的转换次数的分布。

为了降低故障频率,对机器进行了重新设计,使其即使在一个部件失效的情况下仍能继续运行。重新设计后的机器有 5 个部件,每个部件独立运行一段服从 \(\text{Expo}(\lambda)\) 的时间后失效。当且仅当最多只有一个部件失效时,机器才能正常工作。目前,所有 5 个部件都在运行(均未失效)。求机器发生故障之前的预期时间。

解:

两次转换之间的时间是独立同分布的 \(\text{Expo}(\lambda)\),因此转换发生的时刻遵循速率为 \(\lambda\) 的泊松过程。所以,所求分布为 \(\text{Pois}(\lambda t)\)。

第一个部件失效之前的时间服从 \(\text{Expo}(5\lambda)\)。根据无记忆性,从第一个部件失效到另一个部件失效的额外时间服从 \(\text{Expo}(4\lambda)\)。因此,机器(因第二个部件失效而)发生故障之前的预期时间为: \[ \frac{1}{5\lambda} + \frac{1}{4\lambda} = \frac{9}{20\lambda} \]

5.7 独立同分布连续随机变量的对称性

Symmetry of i.i.d. continuous r.v.s

独立同分布(i.i.d.)的连续随机变量具有一个重要的对称性质:所有可能的排序出现的概率都是相等的。直观上,这是因为如果只告诉我们 \(X_1, \dots, X_n\) 是独立同分布的,那么它们就是可互换的,即我们没有得到任何可以将某个 \(X_i\) 与另一个 \(X_j\) 区分开来的信息。这让人联想到,人们常说“你想先听好消息还是坏消息?”,但很少有人说“我有两条消息,你想先听哪一条?”,因为在后一种情况下,没有提供任何区分这两条消息的信息。

命题 5.7.1。设 \(X_1, \dots, X_n\) 独立同分布于某个连续分布。那么对于 \(\{1, 2, \dots, n\}\) 的任何排列 \(a_1, a_2, \dots, a_n\),都有: \[ P(X_{a_1} < X_{a_2} < \dots < X_{a_n}) = \frac{1}{n!} \]

证明:设 \(F\) 为 \(X_j\) 的累积分布函数(CDF)。由对称性可知,\(X_1, \dots, X_n\) 的所有排序概率均相等。例如,\(P(X_3 < X_2 < X_1) = P(X_1 < X_2 < X_3)\),因为两边具有完全相同的结构:它们都是从 \(F\) 中独立抽取三个样本 \(A, B, C\) 满足 \(P(A < B < C)\) 的形式。对于任何 \(i \neq j\),由于 \(X_i\) 和 \(X_j\) 是独立的连续随机变量,出现相等(结值)的概率 \(P(X_i = X_j) = 0\)。因此,\(X_1, \dots, X_n\) 中至少出现一个结值的概率也为 0,因为: \[ P\left( \bigcup_{i \neq j} \{X_i = X_j\} \right) \leq \sum_{i \neq j} P(X_i = X_j) = 0 \]

因此,\(X_1, \dots, X_n\) 以概率 1 互不相等,任何特定排序的概率均为 \(1/n!\)。

5.7.2. 如果随机变量是相关的,该命题可能会失效。设 \(n=2\),考虑 \(X_1\) 和 \(X_2\) 强相关以至于它们总是相等的极端情况,即 \(X_1 = X_2\) 的概率为 1。此时 \(P(X_1 < X_2) = P(X_2 < X_1) = 0\)。对于相关的 \(X_1, X_2\),我们也可以使 \(P(X_1 < X_2) \neq P(X_2 < X_1)\)。示例可见第 3 章练习 42。

5.7.3. 如果 \(X\) 和 \(Y\) 是独立同分布的连续随机变量,那么由对称性及相等概率为 0 可得: \[ P(X < Y) = P(Y < X) = \frac{1}{2} \]

相比之下,如果 \(X\) 和 \(Y\) 是独立同分布的离散随机变量,由对称性可知 \(P(X < Y) = P(Y < X)\) 依然成立,但由于存在相等的可能性,该数值会小于 \(1/2\)。例如,如果 \(X\) 和 \(Y\) 是独立同分布的非负整数值随机变量,且 \(P(X=j) = c_j\),那么: \[ 1 = P(X < Y) + P(X = Y) + P(Y < X) = 2P(X < Y) + P(X = Y) \]

故: \[ P(X < Y) = \frac{1}{2} (1 - P(X = Y)) = \frac{1}{2} \left( 1 - \sum_{j=0}^{\infty} c_j^2 \right) < \frac{1}{2} \]

一组互不相等的数字的秩(ranks)定义为:给最小的数字分配秩 1,第二小的分配秩 2,依此类推。例如,3.14, 2.72, 1.41, 1.62 的秩分别是 4, 3, 1, 2。命题 5.7.1 表明,独立同分布连续变量 \(X_1, \dots, X_n\) 的秩是数字 \(1, \dots, n\) 的一个均匀随机排列。

接下来的例子展示了我们如何在涉及“记录”(records,如降雨量记录或跳高纪录)的问题中,将这种对称性质与指示随机变量结合使用。

例 5.7.4(记录)。运动员们依次进行跳高比赛。令 \(X_j\) 表示第 \(j\) 名跳高运动员的成绩,其中 \(X_1, X_2, \dots\) 是独立同分布且服从连续分布的随机变量。如果 \(X_j\) 大于之前所有成绩 \(X_1, \dots, X_{j-1}\),我们称第 \(j\) 名跳高运动员创造了一项记录。

“第 110 名跳高运动员创造记录”这一事件是否独立于“第 111 名跳高运动员创造记录”这一事件?

求前 \(n\) 名跳高运动员中记录总数的期望值。当 \(n \to \infty\) 时,该均值会如何变化?

如果第 \(j\) 名和第 \(j-1\) 名跳高运动员都创造了记录,则称在时刻 \(j\) 出现了“双重记录”。求前 \(n\) 名跳高运动员中双重记录总数的期望值。当 \(n \to \infty\) 时,该均值会如何变化?

解:

- 令 \(I_j\) 为第 \(j\) 名跳高运动员创造记录的指示随机变量。根据对称性,\(P(I_j = 1) = 1/j\)(因为前 \(j\) 次跳高中的任何一次都有相等的概率成为这 \(j\) 次中的最高值)。同时, \[ P(I_{110} = 1, I_{111} = 1) = \frac{109!}{111!} = \frac{1}{110 \cdot 111} \]

因为要使第 110 次和第 111 次跳高都成为记录,我们需要前 111 次跳高中的最高值出现在第 111 位,第二高值出现在第 110 位,而其余 109 个值可以以任何顺序排列。所以 \[ P(I_{110} = 1, I_{111} = 1) = P(I_{110} = 1) P(I_{111} = 1) \]

这表明第 110 名运动员创造记录独立于第 111 名运动员创造记录。直觉上这是合理的,因为得知第 111 名运动员创造了记录,并没有为我们提供关于前 110 次跳高“内部”如何排列的任何信息。

根据线性性质,前 \(n\) 名跳高运动员中记录数量的期望值为 \(\sum_{j=1}^{n} \frac{1}{j}\)。由于调和级数发散,当 \(n \to \infty\) 时,该均值趋于 \(\infty\)。

令 \(J_j\) 为时刻 \(j\) 出现双重记录的指示随机变量,其中 \(2 \leq j \leq n\)。遵循 (a) 部分的逻辑,\(P(J_j = 1) = \frac{1}{j(j-1)}\)。因此,双重记录数量的期望值为 \[ \sum_{j=2}^{n} \frac{1}{j(j-1)} = \sum_{j=2}^{n} \left( \frac{1}{j-1} - \frac{1}{j} \right) = 1 - \frac{1}{n} \]

因为中间的所有项都相互抵消了(裂项相消)。因此,随着 \(n \to \infty\),记录数量的期望值趋于 \(\infty\),但双重记录数量的期望值趋于 1。

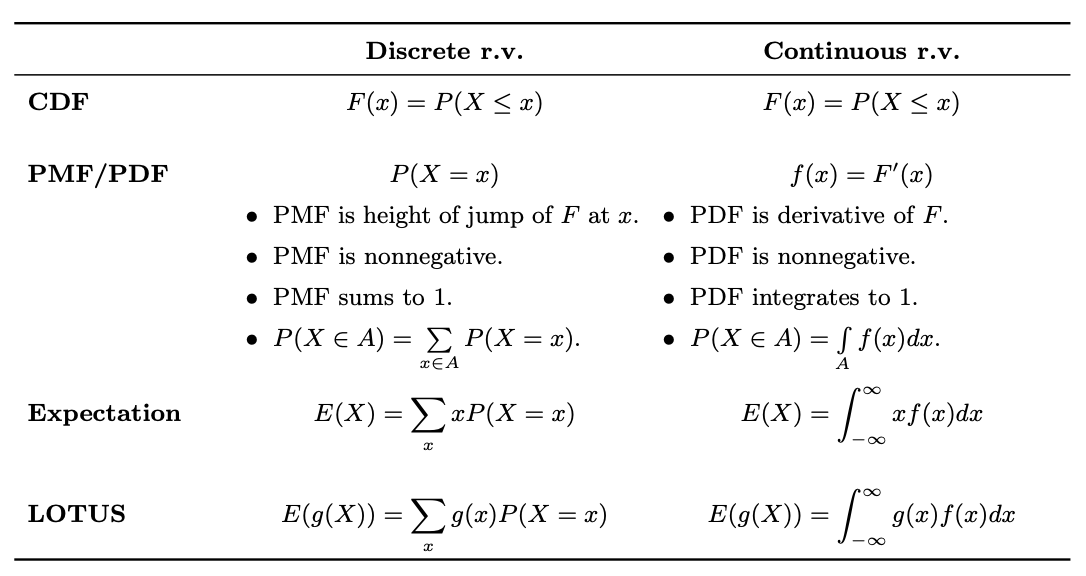

5.8 本章小结

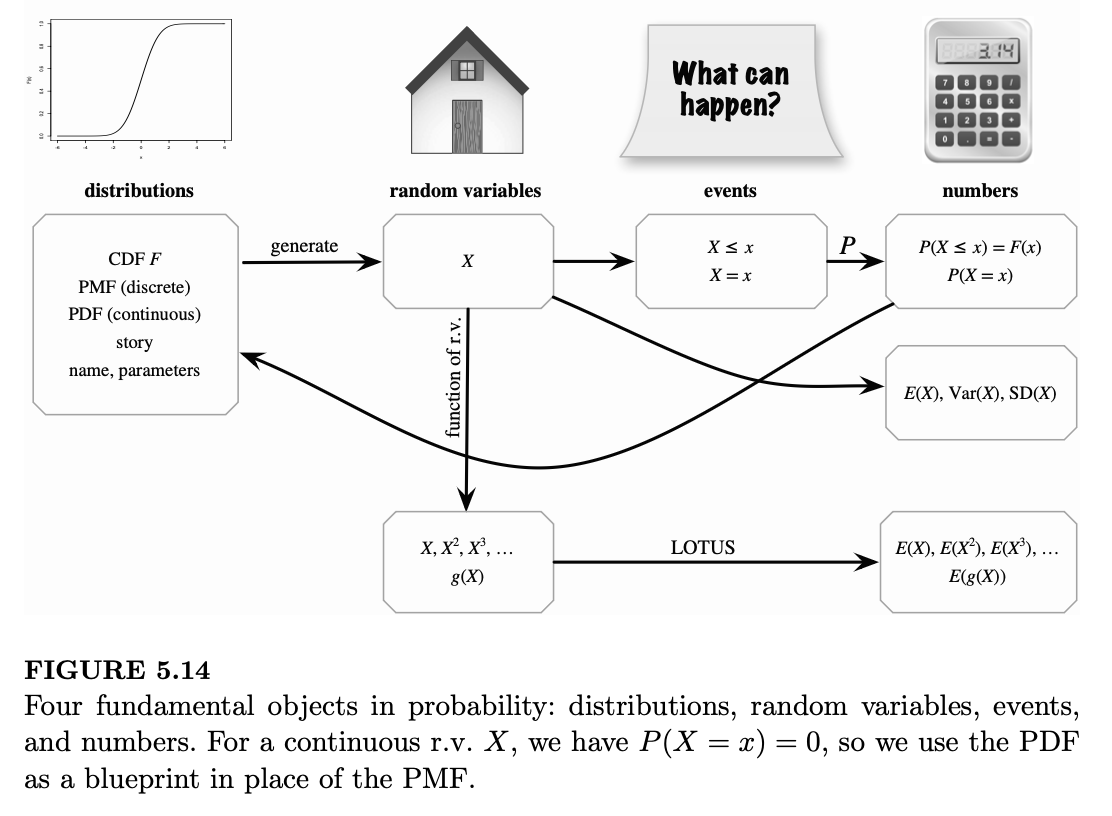

连续随机变量可以取区间内的任何值,尽管它等于任何特定值的概率为 0。连续随机变量的 CDF 是可微的,其导数称为概率密度函数(PDF)。概率由 PDF 曲线下的面积给出,而不是由 PDF 在某一点的值给出。我们必须对 PDF 进行积分才能得到概率。下表总结并比较了离散情形和连续情形中的一些重要概念。

三种重要的连续分布是均匀分布、正态分布和指数分布。\(Unif(a,b)\) 随机变量是区间 \((a,b)\) 内的一个“完全随机”的数字,它具有概率与长度成正比的性质。均匀分布的普适性(Universality)告诉我们如何使用 \(Unif(0,1)\) 随机变量来构造我们可能感兴趣的其他分布的随机变量;它还指出,如果我们把一个连续随机变量代入它自己的 CDF,所得的随机变量服从 \(Unif(0,1)\) 分布。

\(N(\mu,\sigma^2)\) 随机变量具有以 \(\mu\) 为中心的对称钟形 PDF,\(\sigma\) 控制曲线的离散程度。其均值为 \(\mu\),标准差为 \(\sigma\)。68-95-99.7% 法则为正态随机变量落在其均值 1、2 和 3 个标准差范围内的概率提供了重要的基准。

\(Expo(\lambda)\) 随机变量表示连续时间内等待第一次成功的时间,类似于离散时间中几何随机变量表示第一次成功之前的失败次数;参数 \(\lambda\) 可以解释为成功到来的速率。指数分布具有无记忆性,即在已知我们已经等待了一定时间而未获成功的条件下,剩余等待时间的分布与完全没有等待过时的分布完全相同。事实上,指数分布是唯一具有无记忆性的正连续分布。

泊松过程是连续时间中的一系列到达事件,使得一段区间内的到达次数服从泊松分布(其均值与区间长度成正比),且不相交区间内的到达次数相互独立。速率为 \(\lambda\) 的泊松过程的到达间隔时间是独立同分布的 \(Expo(\lambda)\) 随机变量。

独立同分布随机变量 \(X_1, X_2, \dots, X_n\) 的一个有用对称性质是所有排序的可能性相等。例如,\(P(X_1 < X_2 < X_3) = P(X_3 < X_2 < X_1)\)。如果这些 \(X_j\) 除独立同分布外还是连续的,那么我们还可以得出结论,例如 \(P(X_1 < X_2 < X_3) = 1/6\),而在离散情况下,我们还必须考虑出现结值(相等)的可能性。

我们在连续分布中学到的一种新策略是位置-尺度变换(location-scale transformation)。它指出,如果平移和缩放不会使我们脱离正在研究的分布族,那么我们可以从该族中最简单的成员开始,求出简单情形的答案,然后利用平移和缩放得到一般情形。对于本章的三种主要分布,这种方法如下:

- 均匀分布:若 \(U \sim Unif(0,1)\),则 \(\tilde{U} = a + (b-a)U \sim Unif(a,b)\)。

- 正态分布:若 \(Z \sim N(0,1)\),则 \(X = \mu + \sigma Z \sim N(\mu,\sigma^2)\)。

- 指数分布:若 \(X \sim Expo(1)\),则 \(Y = X/\lambda \sim Expo(\lambda)\)。这里我们不考虑平移,因为非零平移会使支撑集不再是 \((0,\infty)\)。

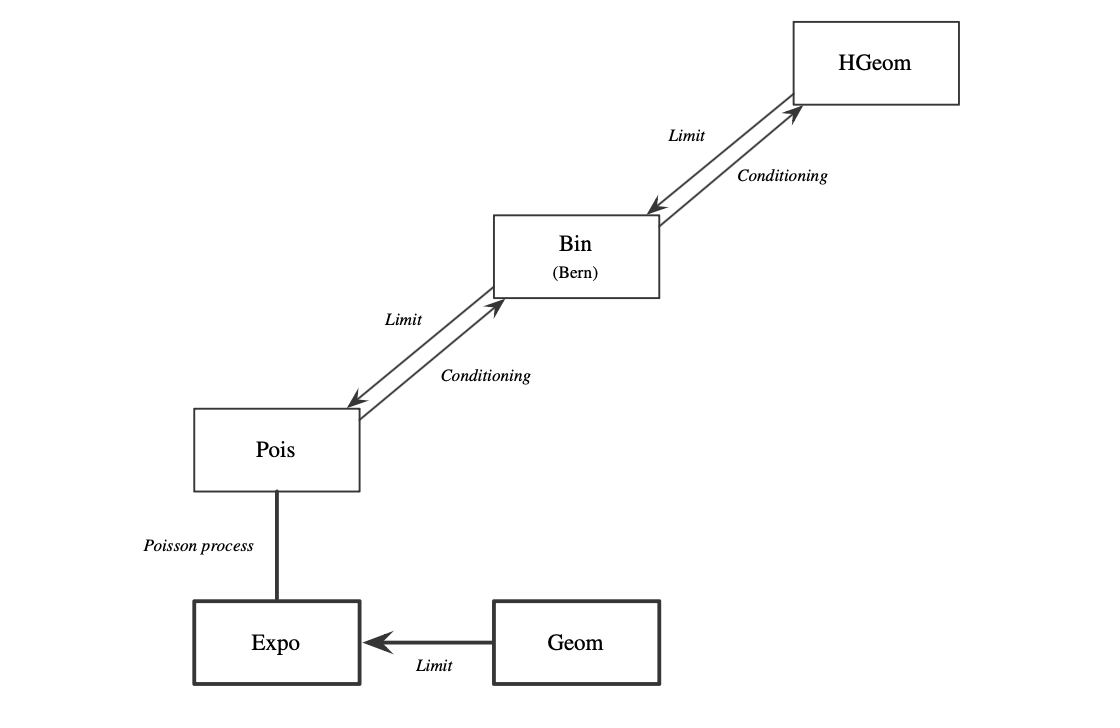

现在我们可以将指数分布和几何分布添加到我们的分布关系图中:指数分布是几何分布的连续极限,而泊松分布和指数分布通过泊松过程联系在一起。

在我们的概率四大基本对象图中,我们将 PDF 作为连续随机变量的另一个蓝图加入其中。

5.9 R 语言实现

在本节中,我们将介绍 R 中的连续分布,学习如何制作基础图表,通过模拟演示均匀分布的普适性,并模拟泊松过程中的到达时间。

均匀分布、正态分布和指数分布

对于连续分布,以 d 开头的函数是 PDF 而非 PMF。因此,我们有以下函数:

- dunif, punif, runif:计算 \(Unif(a,b)\) 在 \(x\) 处的 PDF 值,使用

dunif(x, a, b)。计算 CDF 使用punif(x, a, b)。生成 \(n\) 个来自 \(Unif(a,b)\) 分布的实现值,使用runif(n, a, b)。 - dnorm, pnorm, rnorm:计算 \(N(\mu, \sigma^2)\) 在 \(x\) 处的 PDF 值,使用

dnorm(x, mu, sigma),其中mu是均值 \(\mu\),sigma是标准差(而非方差) \(\sigma\)。计算 CDF 使用pnorm(x, mu, sigma)。生成 \(n\) 个来自 \(N(\mu, \sigma^2)\) 分布的实现值,使用rnorm(n, mu, sigma)。

5.9.1(R 中的正态参数):请注意,我们必须输入标准差而不是方差!例如,为了得到 \(N(10, 3)\) 在 12 处的 CDF 值,我们使用

pnorm(12, 10, sqrt(3))。忽略这一点是一个常见且灾难性的编码错误。

- dexp, pexp, rexp:计算 \(Expo(\lambda)\) 在 \(x\) 处的 PDF 值,使用

dexp(x, lambda)。计算 CDF 使用pexp(x, lambda)。生成 \(n\) 个来自 \(Expo(\lambda)\) 分布的实现值,使用rexp(n, lambda)。

由于位置-尺度变换对连续分布非常重要,R 为这三个分布族都设置了默认参数。均匀分布默认是 \(Unif(0,1)\),正态分布默认是 \(N(0,1)\),指数分布默认是 \(Expo(1)\)。例如,dunif(0.5) 在没有额外输入的情况下会计算 \(Unif(0,1)\) 在 0.5 处的 PDF 值,而 rnorm(10) 则会生成 10 个来自 \(N(0,1)\) 分布的实现值。这意味着在 R 中有两种方式生成 \(N(\mu, \sigma^2)\) 随机变量。在选定 \(\mu\) 和 \(\sigma\) 的值后(如 mu <- 1, sigma <- 2),我们可以执行以下任一操作:

rnorm(1, mu, sigma)mu + sigma * rnorm(1)

两种方式最终都会生成一个来自 \(N(\mu, \sigma^2)\) 分布的样本。

在 R 中绘图

在 R 中绘制函数的一个简单方法是使用 curve 命令。例如:

curve(dnorm, from=-3, to=3, n=1000)

这会创建一条从 -3 到 3 的标准正态 PDF 曲线。实际上发生的是,R 在有限数量的紧密间隔点上评估函数,并用极短的直线连接这些点,从而产生曲线的错觉。输入 n=1000 告诉 R 在 1000 个点上进行评估,使曲线看起来非常平滑;如果我们选择 n=20,分段线性就会变得非常明显。

另一个创建图表的命令是 plot。该命令有非常多的输入选项来定制图表外观。为了演示,我们再次绘制标准正态 PDF。plot 最重要的输入是用于绘图的 \(x\) 值向量和 \(y\) 值向量。seq 命令在此非常有用:

x <- seq(-3, 3, 0.01)

y <- dnorm(x)

现在我们可以直接用 plot(x, y) 绘图。默认是散点图,若要绘制线图,使用 type="l"。我们还可以通过 xlab、ylab 和 main 设置轴标签和标题。

plot(x, y, type="l", xlab="x", ylab="dnorm(x)", main="N(0,1) PDF")

轴范围可以通过 xlim 和 ylim 手动设置,颜色可以通过 col="orange" 等进行更改。

Logistic 分布的普适性

我们在例 5.3.4 中证明了对于 \(U \sim Unif(0,1)\),随机变量 \(\log(U/(1-U))\) 服从 Logistic 分布。在 R 中,我们可以简单地生成大量的 \(Unif(0,1)\) 实现值并对其进行变换:

u <- runif(10^4)

x <- log(u/(1-u))

现在 x 包含了 \(10^4\) 个来自 \(\log(U/(1-U))\) 分布的实现值。我们可以使用 hist(x) 命令通过直方图将它们可视化。直方图类似于 Logistic PDF,这令人欣慰。通过设置 breaks 参数可以控制直方图的精细程度(如 breaks=100 或 breaks=10)。

泊松过程模拟

要模拟速率为 \(\lambda\) 的泊松过程中的 \(n\) 次到达,我们首先生成独立同分布的指数随机变量作为到达间隔时间,并将其存储在向量中:

n <- 50

lambda <- 10

x <- rexp(n, lambda)

然后,我们使用 cumsum 函数(代表“累积和”,cumulative sum)将间隔时间转换为到达时刻:

t <- cumsum(x)

向量 t 现在包含了所有模拟出的到达时刻。

书籍各章的机翻md文件:

《Introduction to Probability》前言

《Introduction to Probability》第1章 概率与计数

《Introduction to Probability》第 2 章 条件概率

《Introduction to Probability》第3章 随机变量及其分布

《Introduction to Probability》第4章 期望

《Introduction to Probability》第5章 连续随机变量

《Introduction to Probability》第 6 章 矩

《Introduction to Probability》第7 章 联合分布

《Introduction to Probability》第8章 变换

《Introduction to Probability》第9章 条件期望

《Introduction to Probability》第10章 不等式与极限理论

《Introduction to Probability》第11章 马尔可夫链

《Introduction to Probability》第12章 马尔可夫链蒙特卡罗

《Introduction to Probability》第13章 泊松过程